CVPR 2022|MLP才是无监督学习比监督学习迁移性能好的关键因素

©作者 | 王逸舟

单位 | 浙江大学

研究方向 | 计算机视觉,无监督学习

在这里和大家分享一下我们被 CVPR 2022 录用的工作"Revisiting the Transferability of Supervised Pretraining: an MLP Perspective"。

论文标题:

Revisiting the Transferability of Supervised Pretraining: an MLP Perspective

作者单位:

收录会议:

论文链接:

开篇定性,作为一篇学术宣传稿,不需要受制于固定的格式,因此我们希望和大家讨论的更加自由放飞一些,分享有趣的现象和背后的洞见(insight),而不是简单的堆砌各种实验结果和“由此可得”。

迁移能力(transferability)的定义很简单,模型在相同数据下,如何在各种下游任务表现的更好。形象的来说,就是门派内有着大量的弟子(pretraining methods),基于门派内共同的修炼资源(pretraining data),修炼着不同的功法(with different supervision),以期让自己在未来在不同类型的江湖比武(various downstream tasks, various dataset)上都能拔得头筹。而我们想要讲述的是,一个资质平凡的监督学习(supervised learning method,SL),修着最普通的功法(the cross-entropy loss),通过“自我审视”(revisit)和取长补短,总结经验教训(theoretical analysis),在各种迁移任务上成功击败早已声名鹊起的后起之秀(unsupervised learning methods, USL),最终脱颖而出的故事。

相比于之前的对监督学习和无监督学习的分析,这次针对迁移性能的 revisit,从监督学习和无监督学习在训练时结构上的差异出发,指出了之前被大家忽视的 MLP projector 是其中的关键因素。

我们从“回看监督学习/无监督学习的差距分析”,“新视角下的监督学习/无监督学习迁移能力差距”,“SL-MLP:MLP 带来的有趣现象”,“对实验现象的理论分析”,“SL-MLP 的迁移性能”五个章节,讲一下如何挖掘监督学习的迁移能力,以及怎样的特征才更适应下游任务。

回看监督学习/无监督学习的差距分析

首先,明确我们的目标:找到监督学习(SL)在迁移能力上真正劣于无监督学习(USL)的原因。只有找到监督学习真正的短板,才能针对性补强,从而完成逆袭。

围绕这一目标,现有的分析和实践性质的文章,主要从两个角度出发:(1)无监督放弃了标签中的语义信息 [1,2],避免模型在训练过程中对标签的过拟合,从而更好保留了 instance-specific 的特征,使其对下游任务的适应性更好。(2)Contrastive loss 的设计让模型学到了对下游任务更友好的中低层的特征 [3,4]。

但是,监督学习方案和现有无监督学习方案在结构上的不同,却一直被大家忽视。从 SimCLR [5] 开始,在 encoder 后引入一个 multi-layer perceptron(MLP) projector 的方案,就被无监督学习广泛的用于提升当前数据集的表征能力。MLP 带来的提升是那么的简单有效,以至于我们当前在设计对比式的无监督学习方案时,都会默认的加入 MLP。从而导致在对监督学习和无监督学习迁移性比较上出现了结构上的 unfair,得到了不够准确的结论。比如,在提升监督学习迁移能力的方案中,SupContrast [4] 在把 contrastive loss 引入监督学习的同时,MLP projector 也被一并引入,但在 [3] 的进一步分析比较中,却单一地把性能提升归功于 contrastive loss 设计上的优势。

而实际上,通过这次的 revist,我们发现之前被大家忽视的 MLP projector 才是其中的关键因素。

新视角下的监督学习/无监督学习迁移能力差距

找到了一个新的视角后,要做的自然是用实验验证这个视角观察的可信度。具体来说,就是要首先从模型结构的视角上凸显出监督学习与无监督学习的迁移能力差距。

Concept generalization task [6] 给我们提供了一个值得参考的方案,并指出各种模型之间的迁移性差异随着 pretraining dataset 和 evaluation dataset 之间的语义差距(semantic gap)的变大而变大。而 ImageNet 作为一个包含多种语义的分类数据集,能被划分成语义差距较大的两类——652类(主要是生物类)的预训练集(pre-D),以及 358 类(工具类)的测试集(eval-D)。让所有的模型都在 pre-D 上预训练,再在 eval-D 上进行 linear eval 从而体现各种方案间的 transferability gap。

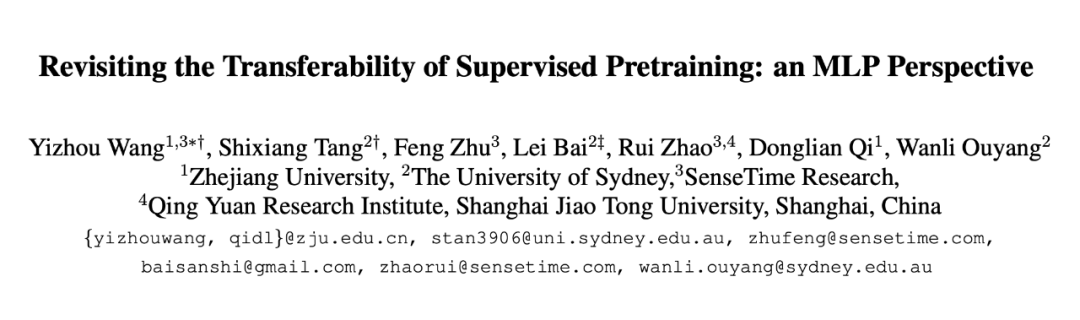

▲(左)Stage-wise eval的实验示意 (右)现有SL、USL方案及其MLP variant的stage-wise eval结果

既然我们从一个结构差异(MLP)的视角出发,我们自然就需要按照 encoder 层级结构的划分,做一个 stage-wise 的测试。Stage-wise evaluation 的结果是出乎意料的:

1. 监督学习(SL)在前 4 个 stage 有着比无监督学习(BYOL,MoCov1,MoCov2)更高的迁移能力,说明标签中的语义信息能够增益中底层特征的迁移能力;

2. BYOL 和 MoCov2 在 stage4 到 5 保持了迁移能力的提升,而 SL 和 MoCov1 则出现了性能的下降,而这两组实验中一个关键的差异就是:BYOL 和 MoCov2 在 stage5 之后插入了一个只用于预训练的 MLP 层,而 SL 和 MoCov1 没有;

3. 对 MoCov1、MoCov2、BYOL 分别进行 with/without MLP 的 ablation 后,发现在无监督方案上增加 MLP 能提升其迁移性能,并避免出现类似 MoCov1 的 stage4 到 5 的迁移能力下降。

说句题外话,实际上可能存在一些其他的非线性结构同样能增加迁移性能,但仅仅从 MLP projector 的角度出发,也能给我们带来更多有趣的结论。

SL-MLP: MLP带来的有趣现象

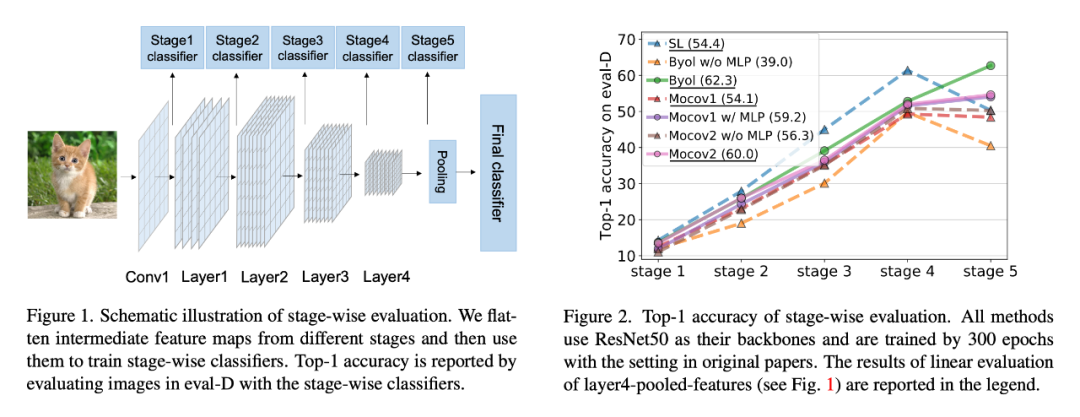

把竞争对手无监督学习在迁移能力上的情况剖析的差不多了,下一步自然就是修炼学到的知识。具体来说,参照无监督学习常用的做法,在预训练时,我们在 SL 的 encoder 和分类层之间加入了一个 MLP,并在迁移到下游任务时丢弃掉,仅使用 encoder 进行迁移。

▲ SL-MLP的训练和测试方式

我们在以下的实验中默认使用与 BYOL 完全相同的 MLP projector,给定 encoder 得到的图像特征 ,MLP projector 将其映射为 ,其中的 MLP 选择与 BYOL 相同的结构(2 个 fc,1 个 bn,1 个 relu),具体为 。

这种简单的设计带来了十分有效且有趣的现象。

现象1. SL-MLP 避免了监督学习(SL)在 stage4-5 上的迁移能力下降。

用从无监督学习那偷师来的 MLP 修炼自身后,监督学习(SL)成功弥补了自己在 stage-wise eval 上的最大劣势,让 stage5 的存在真正对下游任务有了增益。

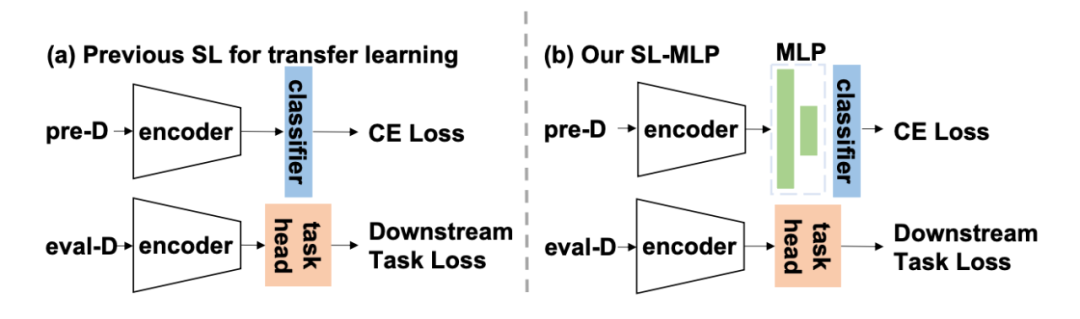

现象2. MLP增大了预训练模型的 intra-class variation。

所谓修炼,只有不在单一方面过度拘于小节,才能适应广泛的任务要求。不是一味专注在减小 intra-class variation,才能让模型保留更丰富的特征。

比较 SL、SupContrast、BYOL(及其 MLP 变体)在预训练集的特征分布,带有 MLP 的方案拥有更大的 intra-class variation。参照 LDA [7],模型在数据集 上的 discriminative ratio 可以用 来表示,其中 和 分别代表模型特征的类间距离和类内距离。因此 与 pre-D 上的 intra-class variation 反相关。

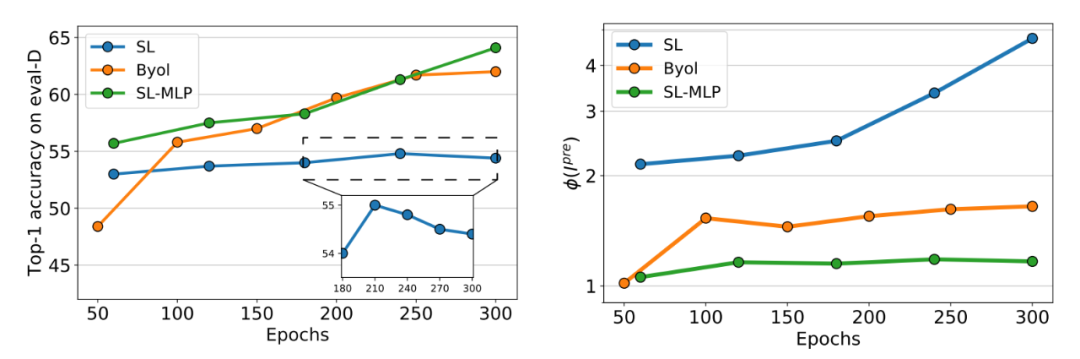

BYOL 和 SL-MLP 在 比 SL 低,但是在 eval-D 的 linear eval 显著的比 SL 高。此外,随着 SL 的 一直上升,在 eval-D 上的性能先上升后下降(210 epoch 后)。那么,这是不是说明了我们在做 SL 迁移任务的时候,并不应该一味的追求在训练集上的精度呢?

▲(左)Linear eval on eval-D (右) Discriminative ratio of pre-D

现象3. MLP 拉近了 pre-D 和 eval-D 特征分布间的距离

所谓修炼,除了与他人竞争水平高低,更重要的在于内心对万事万物的理解是否有所精进。测试精度只能说明方法的最终结果,而学习到的特征分布,才真正代表了增加了 MLP 后的监督学习,对语义的表征做出了哪些改变。

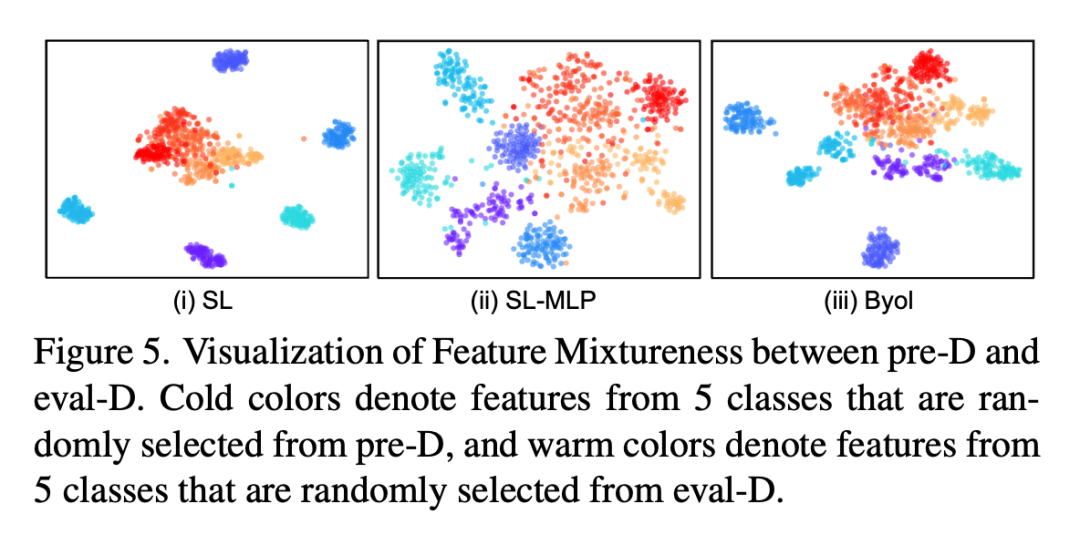

根据 Jennifer Wortma 对于 domain adaption 的分析 [8],拉近预训练域 pre-D 和迁移域 eval-D 特征分布间的距离对于针对迁移域 eval-D 的迁移学习是有帮助的。我们用蓝色系和橙色系代表可视化预训练域 pre-D 和迁移域 eval-D 上不同类别。SL 的预训练域 pre-D 特征彼此分散,且与迁移域 eval-D 的特征产生较大的距离。相对的,SL-MLP 和 BYOL 在保持了预训练域 pre-D 特征可分的基础上,预训练域 pre-D 和迁移域 eval-D 的特征在特征空间中混合的更好。

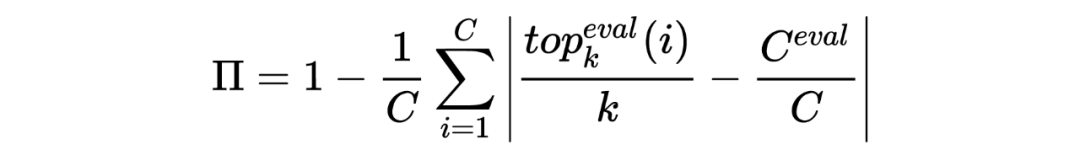

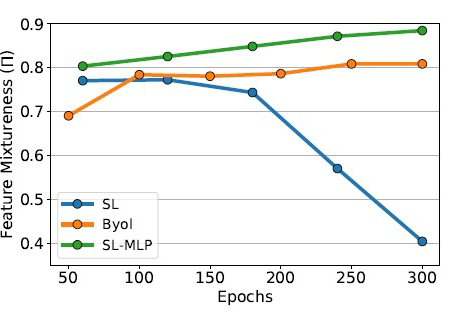

直觉上来说,我们可以用特征在 pre-D 和 eval-D 之间的混合程度 Feature mixtureness(两个 set 中不同类中心周围 topk 中同 set 的比例),来定量计算 pre-D 和 eval-D 特征分布间的距离:

虽然 SL,SL-MLP,BYOL 在开始时的 Feature mixtureness 都较高,随着训练的进行,SL 专注在预训练域 pre-D 上的表征,预训练域 pre-D 和迁移域 eval-D 特征分布间的距离开始拉远,而 SL-MLP 和 BYOL 的预训练域 pre-D 和迁移域 eval-D 特征分布间的距离则一直保持在一个很高的状态。自然,SL-MLP 和 BYOL 就更容易适应新的迁移数据集。

现象4. MLP能减低特征冗余

所谓修炼,就是去除内部的芜杂。对于模型来说,则是特征通道间的冗余度,避免特征的重复让模型受限于当前的任务。

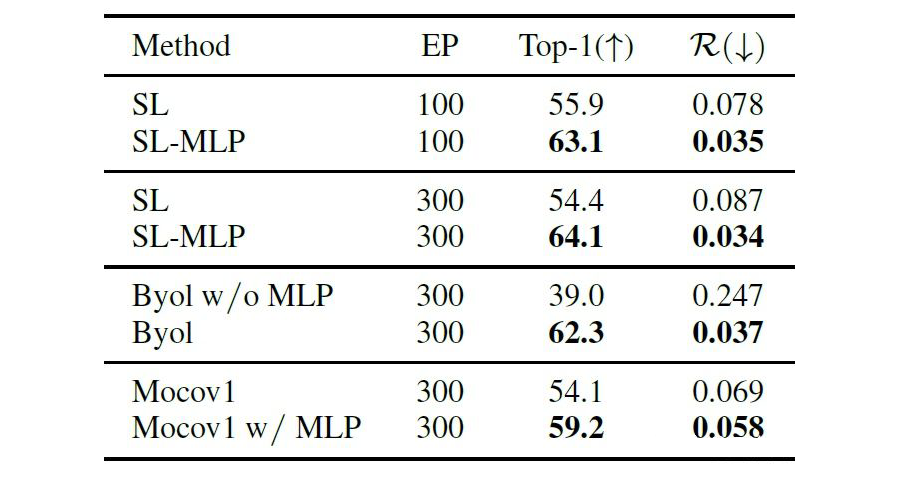

在 Barlow Twins [9] 中提到,特征通道间的高冗余会限制特征的表征能力,我们用 Resnet50 输出的 2048-d 特征维度间的 Pearson 相关度来衡量特征冗余。SL-MLP,BYOL 以及 MoCov1 w/ MLP,相比他们对应的无 MLP 变体,有更高的迁移性能与更小的特征冗余度,说明了 MLP 能减低特征冗余。

▲ R代表模型的特征冗余度

对实验现象的理论分析

在发现了这些有趣的观察之后,我们当然需要对所学到的经验进行一次归纳总结,通过理论分析提炼出成功的关键,为我们研究下一门针对 transferability 的功法打好基础。

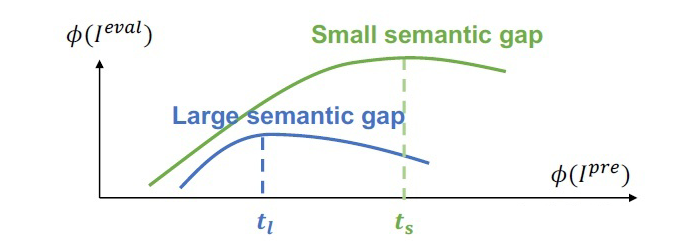

实际上,我们可以总结 pre-D 的 discriminative ratio 和 eval-D 的 discriminative ratio 间的关系满足如下的趋势并给出理论证明。

▲ Insights of transferability. 更高的

代表更高的迁移性能. 更高的

代表pre-D上更小的intra-class variation.

用数学的语言来说:

给定 ,当 时, ,其中 t 是一个正的阈值,并与 pre-D 和 eval-D 之间的特征分布距离成反比。t 的计算以及详细的公式证明我们在论文的 supplementary.C 部分给出。

上述理论说明了:

1)当我们在 pre-D上一直优化其辨别能力直到超过一个固定的阈值 t 之后,进一步优化 pre-D 会导致模型在 eval-D 上的迁移能力下降;

2)当 pre-D 和 eval-D 之间的语义差距更大时(此时,在相同的模型下两者的特征分布距离容易更大),t 会更小。

那么在应对 transfer learning 时,

1)在设计模型结构或者优化函数时,为了更好的迁移能力,我们不能把模型在预训练集的 intra-class variation 优化的过小,导致模型对于预训练集的 overfit。(可以考虑增加 MLP 来完成)

2)当被迁移域 eval-D 和预训练域 pre-D 的语义差距(semantic gap)更大时,我们需要保留更大的 intra-class variation 来做应对。

SL-MLP的迁移性能

学成归来,自当从容应对各种挑战,不卑不亢,一鸣惊人。

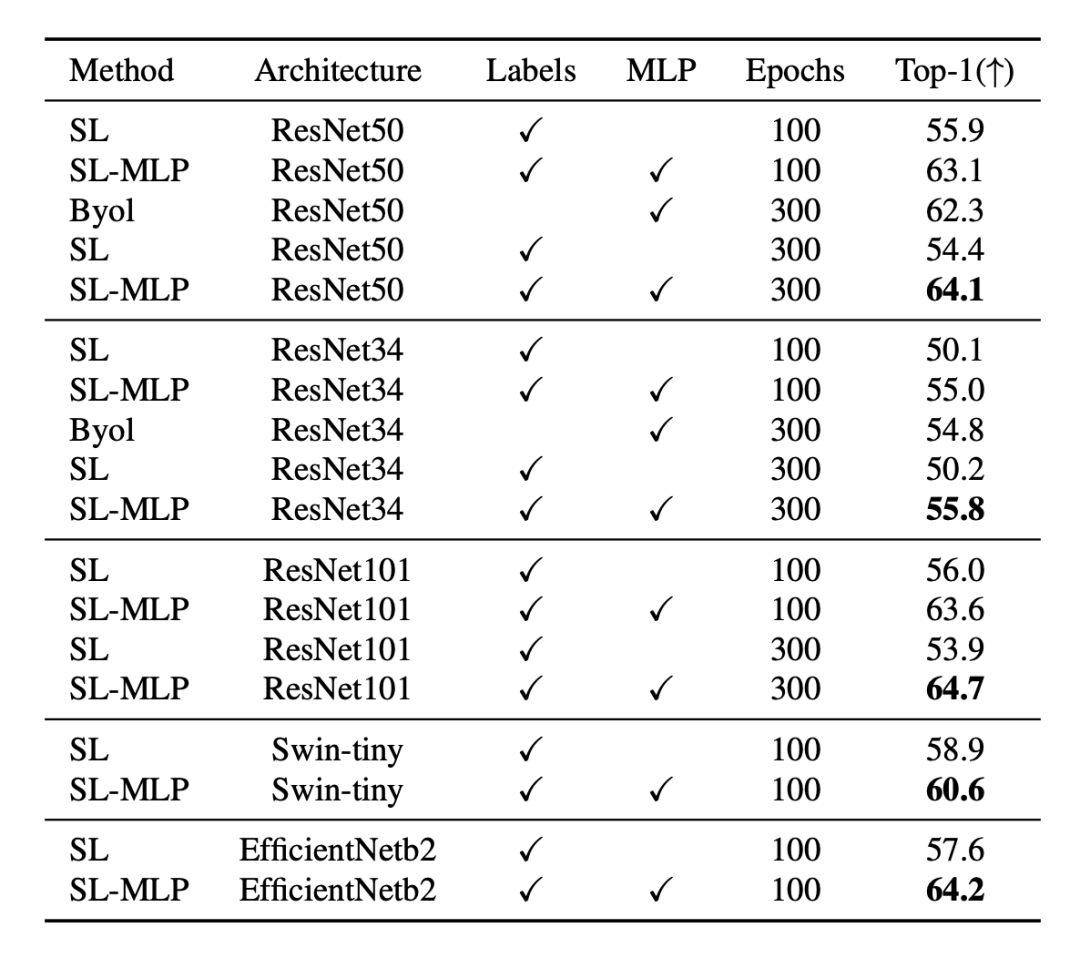

我们在 concept generalization task 任务上验证了 SL-MLP 对多个模型结构的效果。SL-MLP 对 SL 有明显的提升,甚至在相同 epoch 数下超过了 BYOL 的迁移性能。同样的,MLP 在 Swin-ViT 上也有一样的效果。在 Swin-ViT 上的提升较低主要是因为不加 MLP 的 Swin-ViT 已经有了和 SL-MLP 类似的高混合程度(Feature mixtureness)。

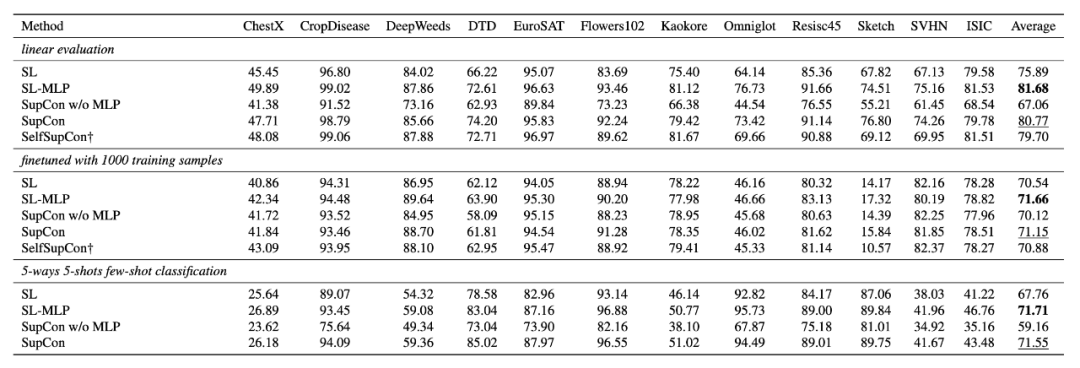

我们在 cross domain 的其他分类数据集上验证了 MLP 对于 SL-MLP 和 SupContrast 的重要性。在 linear eval,finetune 和 few-shot learning 任务上,增加 MLP 都表现出了提升,说明 MLP 相比于 contrastive loss 对于有监督的迁移能力提升更加重要。

▲ 从ImageNet-1K迁移到cross domain的分类数据集

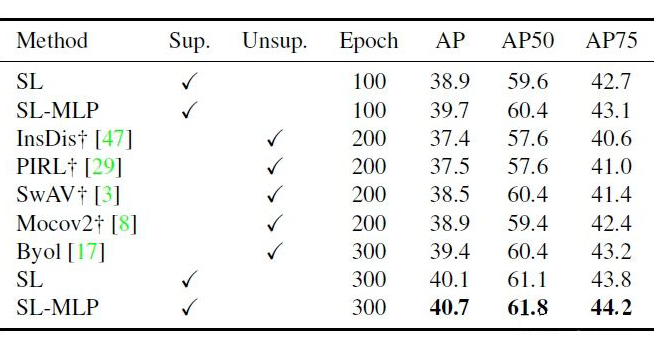

SL-MLP 在检测任务上也能观察到性能的提升。SL-MLP 在较少 epoch 下的性能甚至超过了用更多 epoch 的无监督方案。

▲ Mask R-CNN on COCO

尾声

至此,监督学习通过研究自身与无监督学习之间存在的结构差异,成功掌握了一项提升 transferability 的关键因素(MLP),用 SL-MLP 证明了自身有取得与无监督相似或更好的结果的实力。但是,未来的道路还在不断延伸,其他有效简单的非线性模块,亦或是把 knowledge 直接化用到 supervision 里,修炼的道路没有尽头。

参考文献

[1] Nanxuan Zhao, Zhirong Wu, Rynson WH Lau, and Stephen Lin. What makes instance discrimination good for transfer learning? arXiv preprint arXiv:2006.06606, 2020.

[2] Linus Ericsson, Henry Gouk, and Timothy M Hospedales. How well do self-supervised models transfer? In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pages 5414–5423, 2021

[3] Ashraful Islam, Chun-Fu Chen, Rameswar Panda, Leonid Karlinsky, Richard Radke, and Rogerio Feris. A broad study on the transferability of visual representations with contrastive learning. arXiv preprint arXiv:2103.13517, 2021.

[4] Prannay Khosla, Piotr Teterwak, Chen Wang, Aaron Sarna, Yonglong Tian, Phillip Isola, Aaron Maschinot, Ce Liu, and Dilip Krishnan. Supervised contrastive learning. arXiv preprint arXiv:2004.11362, 2020.

[5] Ting Chen, Simon Kornblith, Mohammad Norouzi, and Geoffrey Hinton. A simple framework for contrastive learning of visual representations. In International conference on machine learning, pages 1597–1607. PMLR, 2020

[6] Mert Bulent Sariyildiz, Yannis Kalantidis, Diane Larlus, and Karteek Alahari. Concept generalization in visual representation learning. In Proceedings of the IEEE/CVF International Conference on Computer Vision, pages 9629–9639, 2021

[7] Balakrishnama S, Ganapathiraju A. Linear discriminant analysis-a brief tutorial[J]. Institute for Signal and information Processing, 1998, 18(1998): 1-8.

[8] John Blitzer, Koby Crammer, Alex Kulesza, Fernando Pereira, and Jennifer Wortman. Learning bounds for domain adaptation. Advances in Neural Information Processing Systems, 20:129–136, 2007

[9] Jure Zbontar, Li Jing, Ishan Misra, Yann LeCun, and St´ephane Deny. Barlow twins: Self-supervised learning via redundancy reduction. arXiv preprint arXiv:2103.03230, 2021.

更多阅读

#投 稿 通 道#

让你的文字被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学术热点剖析、科研心得或竞赛经验讲解等。我们的目的只有一个,让知识真正流动起来。

📝 稿件基本要求:

• 文章确系个人原创作品,未曾在公开渠道发表,如为其他平台已发表或待发表的文章,请明确标注

• 稿件建议以 markdown 格式撰写,文中配图以附件形式发送,要求图片清晰,无版权问题

• PaperWeekly 尊重原作者署名权,并将为每篇被采纳的原创首发稿件,提供业内具有竞争力稿酬,具体依据文章阅读量和文章质量阶梯制结算

📬 投稿通道:

• 投稿邮箱:hr@paperweekly.site

• 来稿请备注即时联系方式(微信),以便我们在稿件选用的第一时间联系作者

• 您也可以直接添加小编微信(pwbot02)快速投稿,备注:姓名-投稿

△长按添加PaperWeekly小编

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧