【泡泡一分钟】基于相对位姿估计去噪处理的多机器人协同定位算法(ICRA-25)

z每天一分钟,带你读遍机器人顶级会议文章

标题:Multi Agent Localization from Noisy Relative Pose Measurements

作者:R. Aragues L. Carlone G. Calafiore C. Sagues

来源:ICRA 2011

编译:韩昊旻

播音员:王肃

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

今天介绍的文章是“Building Maps for Autonomous Navigation Using Sparse Visual SLAM Features ”——基于相对位姿估计去噪处理的多机器人协同定位算法,该文章发表在ICRA 2011。

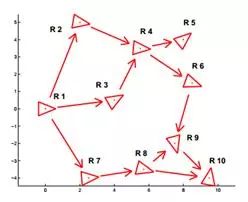

在这篇文章当中,我们提出,在不参考任何公共坐标系的情况下,通过一组机器人的相对位姿来评估其绝对位姿的方法。每个机器人都能够通过其邻近的机器人,来测量其相对与其他机器人的位置和朝向,但因为噪声的存在,这种测量方法并不是十分准确。这个方法的思路是,通过计算每个相关的机器人的位姿,来近似计算锚点的位置。具体步骤如下:首先计算每个机器人的相对方向,之后根据这些方向值,来更新其相对位置的测量值。如下图所示:10个机器人放在在一个平面环境中,并且处于未知的位置,每个机器人都可以测量其相对于其他机器人的位置和方向。

接下来,我们讨论了这种方法以分布式方式执行时展现的特性。分布式允许每个机器人仅利用本身测量信息和与他邻近的机器人的信息来确定其当前时刻的位姿。此外这种方式仅仅要求每个机器人维持自身的位置和方向,因此其所需的计算资源是很低的。

Abstract

In this paper we address the problem of estimating the poses of a team ofagents when they do not share any common reference frame. Each agent is capableof measuring the relative position and orientation of its neighboring agents,however these measurements are not exact but they are corrupted with noises.The goal is to compute the pose of each agent relative to the anchor node fromnoisy relative pose measurements. We present an strategy where, first of all, theagents compute their orientations relative to an anchor node. After that, theyupdate the relative position measurements according to these orientations, tofinally compute their positions. As contribution we discuss the proposedstrategy, that has the interesting property that can be executed in adistributed fashion. The distributed implementation allows each agent to recoverits pose using exclusively local information and local interactions with itsneighbors. Besides, it only requires each node to maintain an estimate of itsown orientation and position. Thus, the memory load of the algorithm is lowcompared to methods where each agent must also estimate the positions and orientationsof any other agent.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com