【泡泡一分钟】BodyFusion:使用单个深度相机实时捕获人体运动和表面几何(ICCV2017-95)

每天一分钟,带你读遍机器人顶级会议文章

标题:BodyFusion:Real-time Capture of Human Motion and Surface Geometry Using a Single Depth Camera

作者:Tao Yu, Kaiwen Guo, Feng Xu, Yuan Dong, Zhaoqi Su, Jianhui Zhao, Jianguo Li

来源:International Conference on Computer Vision (ICCV 2017)

编译:王健

审核:陈世浪

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

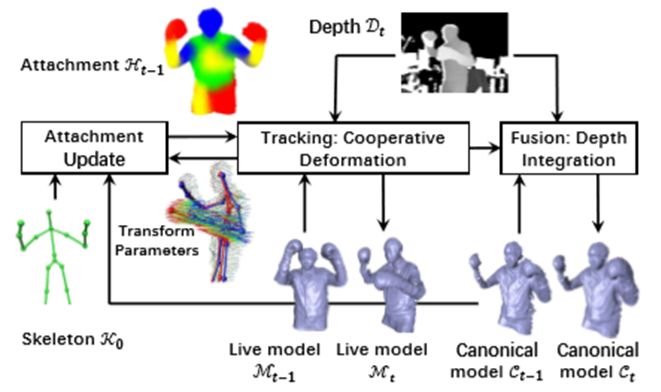

本文提出一种新颖的实时几何融合方法—BodyFusion,该方法可以通过单个消费级深度相机,完成对人体非刚性表面运动行为的跟踪和重建任务。作者利用人体行为的内部铰接运动先验,来降低表面图节点上非刚性形变参数化的模糊性,并提出了一种骨架嵌入式表面融合(SSF)的方法。本文提出方法的关键点是:基于骨架和图形节点之间的附带信息来共同解决骨骼和图形节点的形变问题。附带信息基于融合的表面几何形状和形变计算进行逐帧更新。总而言之,随着深度帧的融合,本文方法可以实现逐渐去噪,精细化和完整表面重建的任务,并完成骨架和附带信息的更新。实验结果表明,与现有融合方法相比,本文的方法能够显着提高非刚性运动融合的性能和跟踪的鲁棒性。作者还提供了一个单深度相机数据集,可以对基于融合动态场景重建算法进行定量评估。

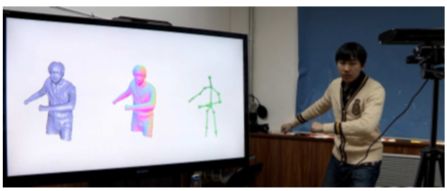

本文的实时重建效果

本文系统流程

Abstract

We propose BodyFusion, a novel real-time geometry fusion method that can track and reconstruct non-rigid surface motion of a human performance using a single consumer-grade depth camera. To reduce the ambiguities of the non-rigid deformation parameterization on the surface graph nodes, we take advantage of the internal articulated motion prior for human performance and contribute a skeleton-embedded surface fusion (SSF) method. The key feature of our method is that it jointly solves for both the skeleton and graph-node deformations based on information of the attachments between the skeleton and the graph nodes. The attachments are also updated frame by frame based on the fused surface geometry and the computed deformations. Overall, our method enables increasingly denoised, detailed, and complete surface reconstruction as well as the updating of the skeleton and attachments as the temporal depth frames are fused. Experimental results show that our method exhibits substantially improved non-rigid motion fusion performance and tracking robustness compared with previous state-of-the-art fusion methods. We also contribute a dataset for the quantitative evaluation of fusion-based dynamic scene reconstruction algorithms using a single depth camera.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com