【泡泡一分钟】用于视觉里程计的从深度相机中快速提取柱面和平面方法

每天一分钟,带你读遍机器人顶级会议文章

标题:Fast Cylinder and Plane Extraction from Depth Cameras for VisualOdometry

作者:Pedro F. Proença and Yang Gao

来源:IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS),2018

编译:孙钦

审核:颜青松,陈世浪

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

本文提出了一种名为CAPE的从有组织的点云中提取平面和圆柱段的方法,该方法通过在平面单元网格上操作,在单核CPU上处理640×480深度图的速度达到了平均300Hz。而且,与最先进的平面提取方法相比,CAPE的延迟更加一致,并且速度提高了4-10倍,根据场景,我们还凭经验证明了将CAPE应用于视觉里程计可以改善在圆柱形表面(例如隧道)场景中的轨迹估计,而使用非曲线感知的平面提取方法则会降低在这些场景中使用的性能。为了在视觉里程计中使用这些几何基元,我们建议将基于点,线和平面的概率RGB-D里程计框架扩展到圆柱基元。在该框架之后,CAPE在融合的深度地图上运行,并且依概率对圆柱面的参数进行建模以相应地考虑位姿优化残差的不确定性和权重。

源码:https://github.com/pedropro/CAPE

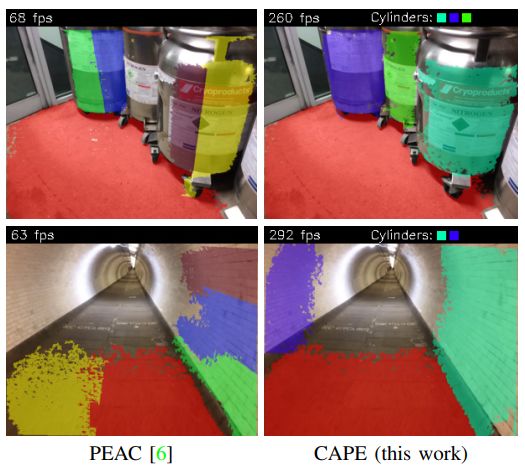

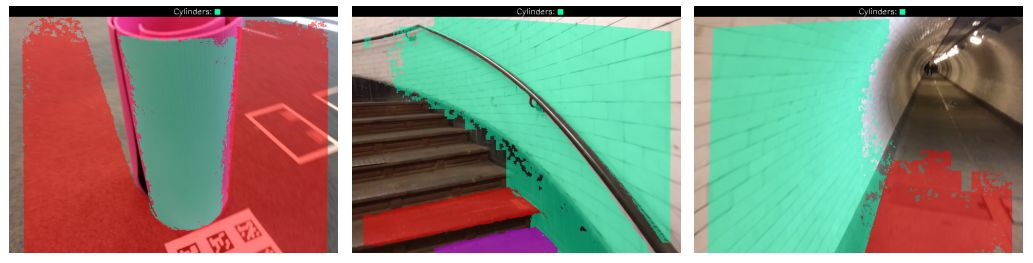

图1 最先进的平面提取方法PEAC和我们的方法CAPE在圆柱面环境中输出结果。我们的方法能捕捉足够多的基元,而PEAC方法对这些面的拟合不够稳定,从而影响对相机的位姿估计。两种方法视频效果:https://www.youtube.com/watch?v=FPFPVwm_yq0&feature=youtu.be

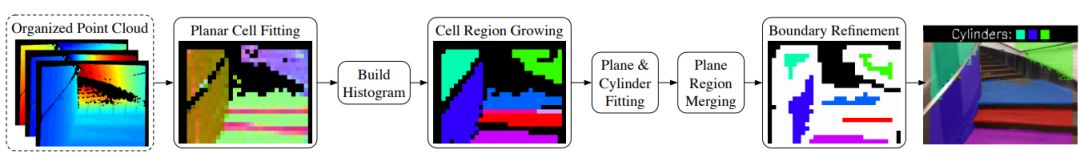

图2 CAPE方法主要流程,在中间图中,对平面单元的法线进行颜色编码。在右图中,精细的部分覆盖在相应的RGB图像上。

CAPE方法主要分为:平面单元拟合,法线直方图,单元区域增长和平面与柱面拟合四个部分。

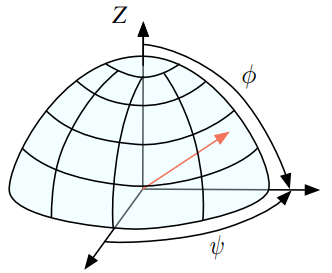

图3 用于构建单元法线直方图的球结构,Z轴指向相机平面。

单元区域增长部分算法流程:

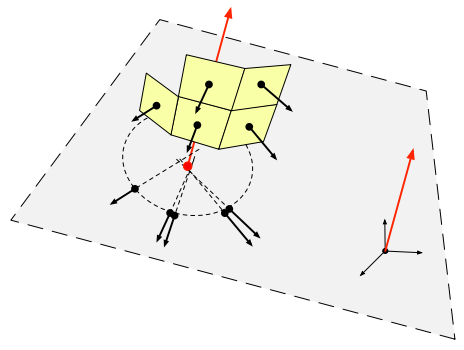

图4 基于凸圆柱单元法线的直接柱面拟合解决方案,首先,根据圆柱轴将单元中心和法线投影到平面上,其次,使用分析圆拟合解来估计半径和中心。

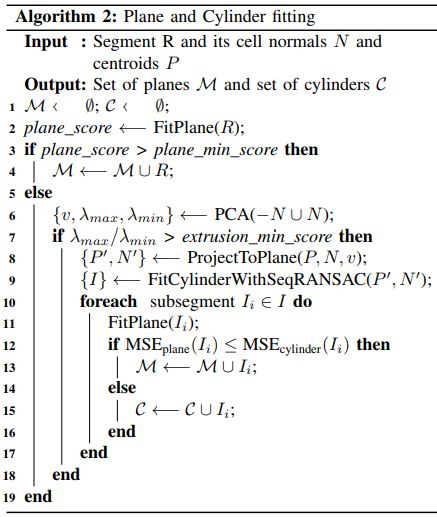

平面和柱面拟合部分算法流程:

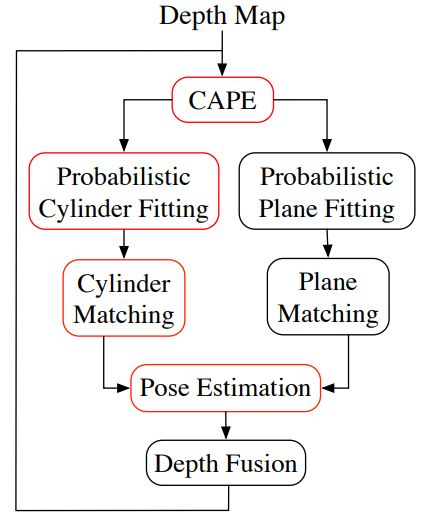

CAPE方法用于视觉里程计,主要分为概率柱面拟合,柱面匹配和基于柱面的位姿估计三个部分,其流程图如下所示:

图5 CAPE用于视觉里程计的算法流程。

实验部分:

图6 CAPE方法效果展示

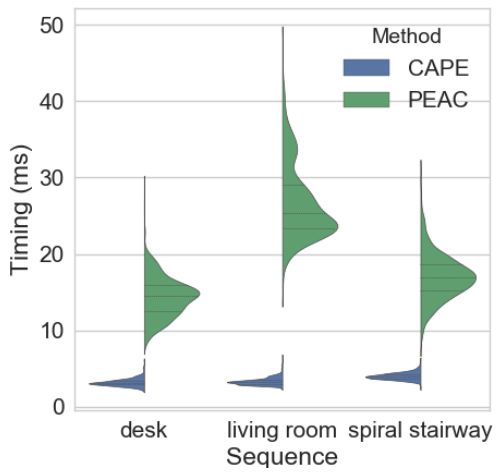

图7 PEAC和CAPE(我们的方法)两种方法在三种不同数据集上的耗时情况。

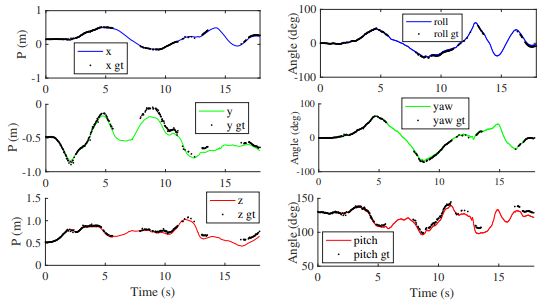

图8 真实轨迹和利用CAPE的视觉里程计比较。

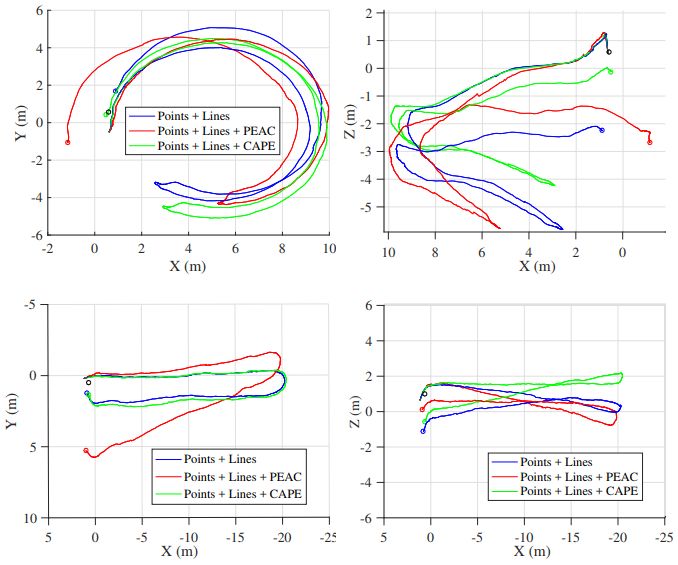

图9 在两个不同的数据集(上spiral_stairway,下为tunnel数据集)中的轨迹估计。左边为俯视图,右边的位侧视图。图中的小圆圈表示轨迹的终点,其中黑色的圆圈代表终点的真实值。

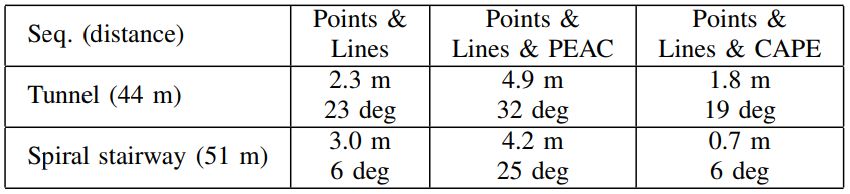

表1 最终轨迹误差

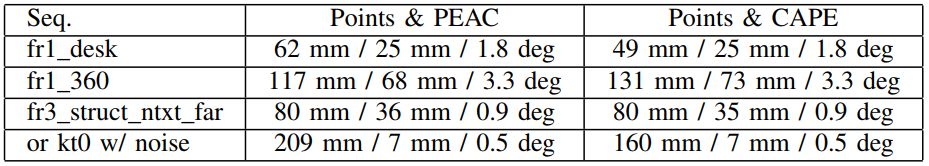

表2 在非柱面场景公共数据集的算法性能,表中的3项指标分别为绝对轨迹误差 / 相对平移误差 / 相对角度误差

Abstract

This paper presents CAPE, a method to extract planes and cylinder segments from organized point clouds, which processes 640×480 depth images on a single CPU core at an average of 300 Hz, by operating on a grid of planar cells. While, compared to state-of-the-art plane extraction, the latency of CAPE is more consistent and 4-10 times faster, depending on the scene, we also demonstrate empirically that applying CAPE to visual odometry can improve trajectory estimation on scenes made of cylindrical surfaces (e.g. tunnels), whereas using a plane extraction approach that is not curve-aware deteriorates performance on these scenes. To use these geometric primitives in visual odometry, we propose extending a probabilistic RGB-D odometry framework based on points, lines and planes to cylinder primitives. Following this framework, CAPE runs on fused depth maps and the parameters of cylinders are modelled probabilistically to account for uncertainty and weight accordingly the pose optimization residuals.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com