题目:Interpreting and Unifying Graph Neural Networks with An Optimization Framework

作者:Meiqi Zhu, Xiao Wang, Chuan Shi, Houye Ji, Peng Cui

简介:图神经网络(GNNs)在各种图分析任务中得到了相当广泛的关注。设计良好的消息传递机制是经典图神经网络中最基本的组成成分,并且经验与实验证明该部分是非常有效的。虽然传播机制多种多样,但基本都是通过沿着网络拓扑结构聚合节点特征来利用网络结构与特征信息的。鉴于此,一个问题自然产生:”尽管图神经网络有着不同的传播策略,是否存在一个统一的数学准则,从本质上指导这不同图神经网络的传播过程?如果有的话,是什么?“ 对这个问题较为完善的答案,可以帮助我们从宏观上有原则地考察不同图神经网络之间的关系和差异,并且这样的数学准则一旦被提出,就能够帮助我们发现现有图神经网络的不足之处,进而激发设计更多新的图神经网络。

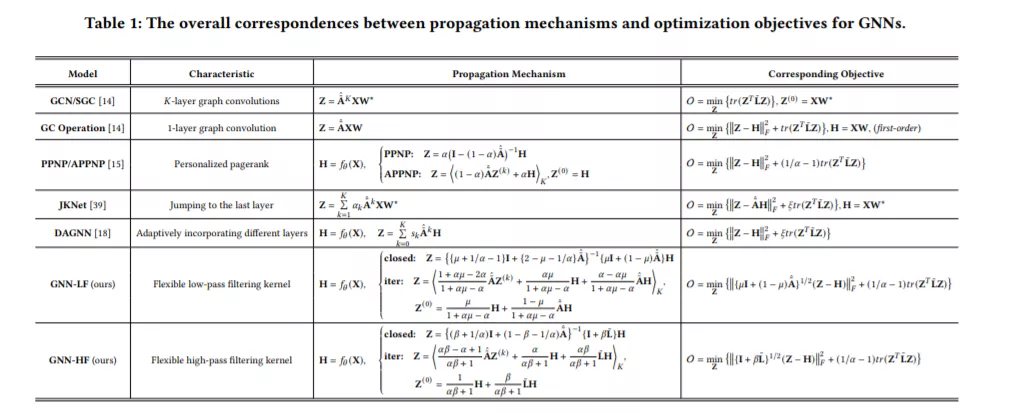

在本文中,我们致力于建立不同图神经网络传播机制之间的联系,将他们的传播过程建模成一个统一的优化问题。分析表明,多种经典图神经网络的传播机制实际上是在优化一个结合了特征拟合约束项和图拉普拉斯正则化约束项的优化目标,而他们传播后的节点表示可以隐式地看作是这个统一优化目标的最优解。特征拟合项旨在建立节点表示与原始节点特征之间的关系,通常用于满足特定图神经网络的不同需求。图拉普拉斯正则化项则是这些图神经网络所共享的,它起到拓扑平滑特征的作用。

我们提出的统一优化目标框架,总结了几种最具代表性的GNN之间的共性,不仅为探索不同GNN之间的关系提供了一个宏观的视角,也进一步为灵活设计GNN提供了新的机会。传统上,在提出一种新的图神经网络模型时,我们通常侧重于设计特定的谱域滤波器或空域聚合策略。现在,统一的优化目标框架为实现这一目标提供了另一种新的途径,即通过设计传播目标函数而得到新的图神经网络。这样,我们就清楚地知道传播过程背后的优化目标,使新设计的图神经网络更具有可解释性和可靠性。举例来说,本文我们发现现有的工作通常使用非常简单的图卷积核来设计特征拟合约束项,因此基于现有的不足开发出两个具有可调低通和高通滤波器性质的灵活优化目标函数。此外,我们提供了收敛证明和表达能力的比较。在基准数据集上进行的大量实验表明,基于本文优化框架提出的GNN模型不仅性能优于现有的优化方法,而且能够很好地缓解过度平滑问题,进一步验证了采用统一优化框架设计GNN的可行性。