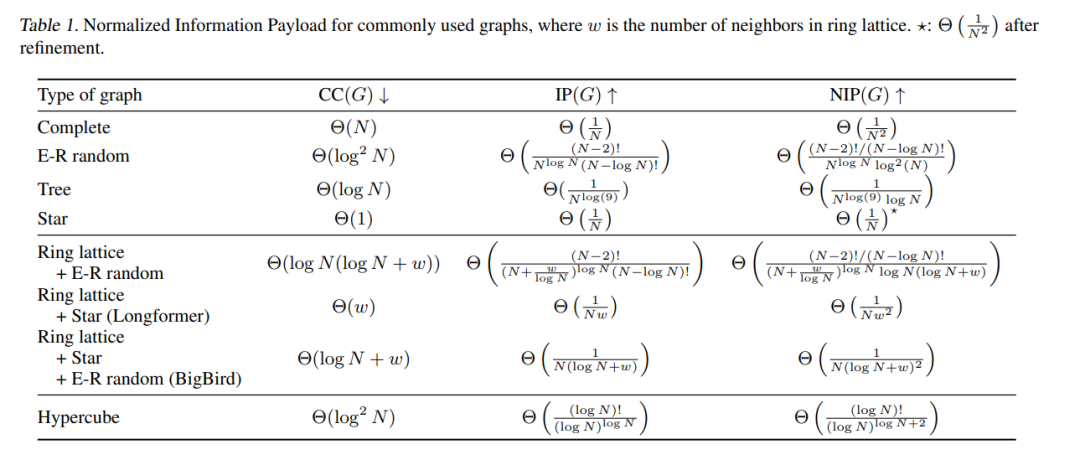

Transformers 在多种任务上取得了进展,但却受到二次元计算和内存复杂性的困扰。最近的工作提出了稀疏Transformers,关注稀疏图,以降低复杂性和保持强大的性能。虽然很有效,但是对于图需要多密集才能很好地执行的关键部分,还没有进行充分的探讨。在本文中,我们提出了归一化信息有效载荷(NIP),这是一种测量图上信息传递的图评分函数,它提供了一个在性能和复杂性之间进行权衡的分析工具。在理论分析的指导下,我们提出了超立方Transformers,一个稀疏的Transformer,它在超立方体中建模标记交互,并显示与普通Transformer相当甚至更好的结果,同时在序列长度为N的情况下产生O(N log N)复杂度。在需要不同序列长度的任务上的实验为我们的图函数提供了验证。

https://www.zhuanzhi.ai/paper/8318e8175a50804b8f5157bbd8679a00

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2022年7月17日