深度学习作为一项重要技术,引发了人工智能(AI)领域的显著变革,极大地改变了人类的生活方式。作为最具代表性的架构,Transformers赋能了众多先进模型,尤其是包含数十亿参数的大型语言模型(LLMs),成为深度学习的基石。尽管取得了令人瞩目的成就,Transformers仍面临固有的局限性,尤其是在推理时,由于注意力计算的平方复杂度,导致推理过程耗时较长。最近**,一种名为Mamba的新型架构应运而生,其灵感源自经典的状态空间模型,成为构建基础模型的有力替代方案**。Mamba在保持对序列长度近似线性扩展性的同时,提供了与Transformers相当的建模能力。这一发展引发了越来越多的研究,积极探索Mamba在不同领域中实现卓越性能的潜力。鉴于这一快速发展,亟需一份系统的综述,以整合现有的Mamba赋能模型,并全面理解这一新兴的模型架构。因此,在本综述中,我们对近期与Mamba相关的研究进行了深入调查,涵盖了三个主要方面:基于Mamba的模型进展、Mamba适应多样化数据的技术,以及Mamba在各种应用中的表现。具体来说,我们首先回顾了各种具有代表性的深度学习模型的基础知识,并作为预备知识介绍了Mamba-1&2的详细内容。接着,为了展示Mamba对AI的重要性,我们全面回顾了相关研究,重点关注Mamba模型的架构设计、数据适应性和应用领域。最后,我们讨论了当前的局限性,并探索了多个有前景的研究方向,以为未来的研究提供更深入的见解。

1 引言

在过去的二十年中,作为最杰出的人工智能(AI)技术,深度学习在医疗保健 [88]、自主系统 [37, 60]、推荐系统 [104, 228] 和金融服务 [144, 216] 等多个领域引发了一场革命。在此期间,涌现了许多深度神经网络(DNNs),极大地改变了人类的生活方式,为个人带来了巨大的便利。一个显著的例子是U-Net [151, 164],这是视觉领域中一种强大的深度学习模型,被广泛应用于医学影像中,如MRI和CT扫描的检查。其应用有助于疾病的识别和诊断,展示了其在这一关键医疗领域的有效性 [112, 191]。此外,图神经网络(GNNs)被用于处理图结构数据,以支持智能服务,如为用户推荐个性化内容、产品或服务的推荐系统 [41, 42, 194]。再者,循环神经网络(RNNs)由于其能够捕捉序列和上下文信息的能力,被广泛应用于机器翻译中,为来自不同语言背景的个人提供了有效的沟通和理解彼此思想、观点和信息的能力 [119, 167]。

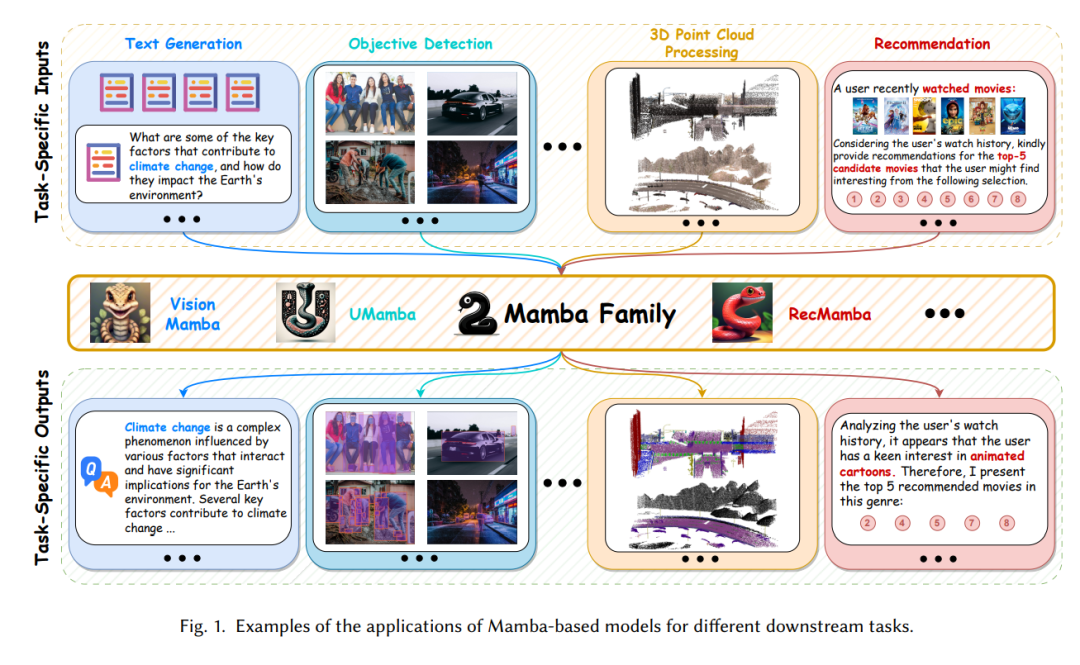

在众多深度学习架构中,Transformers近年来脱颖而出,并在广泛的应用中确立了其主导地位 [34, 175]。例如,作为最具代表性的大型基础模型,像ChatGPT这样的大型语言模型(LLMs)就是基于Transformer架构构建的 [2, 146, 228]。通过将模型规模扩大到数十亿并在多种数据源上进行训练,这些基于Transformer的模型展示了类人水平的智能,具备了令人印象深刻的语言理解、常识推理和上下文学习能力 [44, 217]。这种显著的成功得益于注意力机制 [174],它使得基于Transformer的模型能够集中注意输入序列的相关部分,从而促进更好的上下文理解。然而,注意力机制也引入了一个显著的计算开销,该开销随着输入大小呈平方增长 [124, 233],这在处理较长输入时带来了挑战。例如,计算成本的快速增长使得Transformers在处理大量序列时变得不切实际或难以实现,从而限制了其在诸如文档级别机器翻译 [131] 或长文档摘要 [94] 等任务中的应用。最近,一种名为结构化状态空间序列模型(SSMs) [58] 的有前途的架构应运而生,能够高效地捕捉序列数据中的复杂依赖关系,成为Transformer的一个强大竞争者。这些模型受经典状态空间模型 [89] 的启发,可以被视为循环神经网络和卷积神经网络的融合。它们可以使用递归或卷积操作高效计算,实现与序列长度成线性或近线性扩展,从而显著降低计算成本。更具体地说,作为最成功的SSM变体之一,Mamba在保持与序列长度成线性扩展性的同时,达到了与Transformers相当的建模能力 [55],因此成为焦点话题。Mamba首先引入了一种简单但有效的选择机制,使模型能够过滤掉不相关的信息,同时通过基于输入对SSM参数进行参数化,保留必要且相关的数据。然后,Mamba提出了一种硬件感知算法,通过扫描而非卷积来递归计算模型,在A100 GPU上实现了高达3倍的计算速度提升。如图1所示,强大的复杂且长序列数据建模能力,以及近线性扩展性,使Mamba成为一个新兴的基础模型,准备在计算机视觉 [199, 234]、自然语言处理 [111, 226]、医疗保健 [152, 179, 198] 等多个研究和应用领域掀起一场革命。例如,Zhu等人 [234] 提出了Vim,它在提取高分辨率图像特征时比DeiT [173] 快2.8倍,并节省了86.8%的GPU内存。由于Mamba强大的长序列建模能力及其卓越的效率,已有大量文献专注于在各种下游任务中应用和改进Mamba。鉴于关于Mamba研究的显著增长,亟需对现有文献进行全面回顾,并深入探讨未来研究的潜在方向。因此,在本综述中,我们从多个角度对Mamba进行了全面回顾,以为新人提供对Mamba内在工作原理的基础理解,同时帮助有经验的从业者跟上其最新的发展。具体而言,本综述的其余部分组织如下:第2节,我们回顾了各种具有代表性的深度神经网络的背景知识,包括RNNs、Transformers和状态空间模型,而第3节介绍了Mamba的详细内容。随后,我们在第4节从模块设计、扫描模式和内存管理的角度总结了基于Mamba的研究的最新进展。接着,第5节介绍了Mamba适应多样化数据的技术,包括序列和非序列数据。此外,第6节介绍了Mamba模型的代表性应用,而第7节则提出了挑战和未来方向。最后,我们在第8节总结了整个综述。在我们的综述同时,还发布了几篇相关综述,主要聚焦于状态空间模型 [137, 183] 和Vision Mamba [120, 199, 218]。与这些综述不同,本文集中于与Mamba相关的研究。我们从一个新的视角系统地分析了现有文献,探讨了Mamba架构的演变以及Mamba模型中使用的数据适应方法。

Mamba

为了应对传统SSMs在上下文感知能力方面的不足,[55] 提出了Mamba,作为一个有潜力的通用序列基础模型骨干。最近,Mamba-2 [29] 提出了结构化空间状态对偶性(SSD),它建立了一个连接结构化SSMs和多种形式注意力机制的强大理论框架,使我们能够将最初为Transformers开发的算法和系统优化应用于SSMs。在本节中,我们将对Mamba和Mamba-2进行简明而清晰的介绍。

Mamba模型的进展

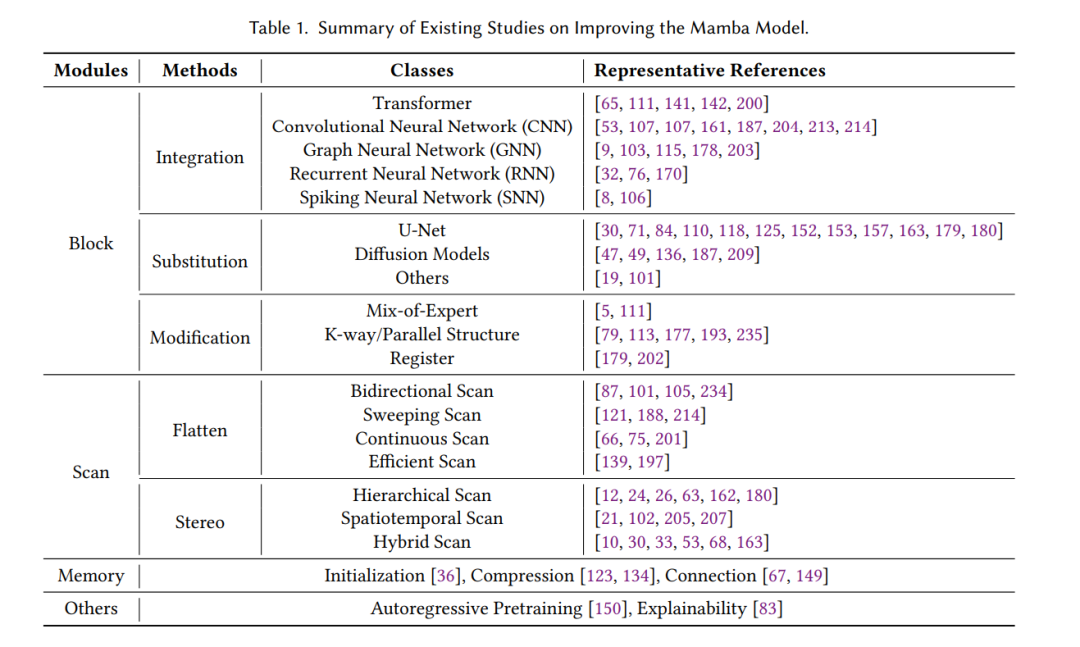

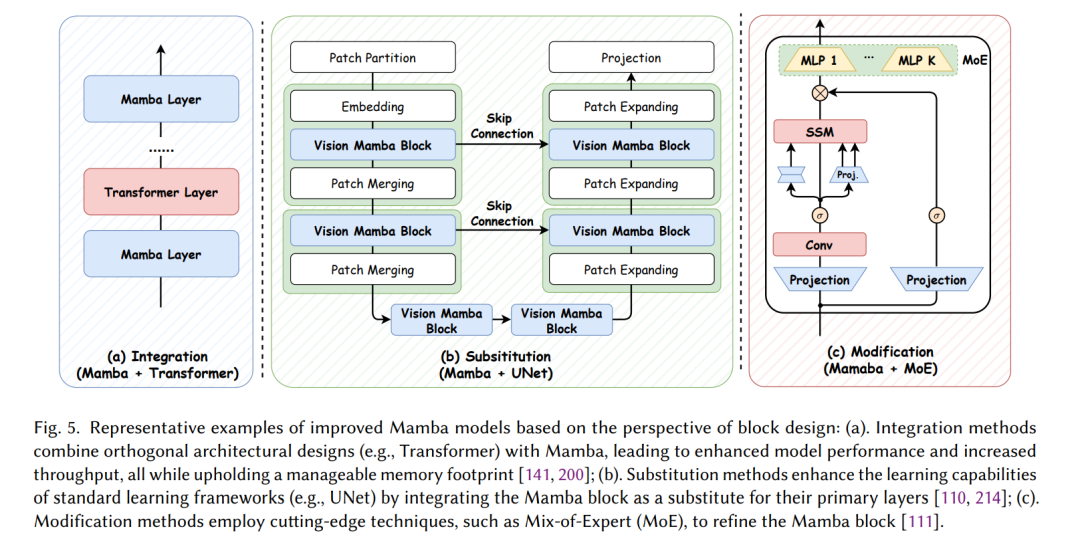

状态空间模型和Mamba最近得到了深入研究,并逐渐成为基础模型骨干的有力替代方案。尽管Mamba在自然语言处理方面表现出色,但它仍然面临一些挑战,如记忆丢失、对多样化任务的泛化能力不足,以及相比基于Transformer的语言模型在捕捉复杂模式方面的能力较弱。为了克服这些挑战,研究人员进行了大量努力以改进Mamba架构。现有研究主要集中在修改模块设计、扫描模式和内存管理方面。本节将介绍这三个方面的几项重要技术,并在表1中对相关研究进行总结。

结论

Mamba作为一种新兴的深度学习架构,凭借其强大的建模能力和计算效率,在语言生成、图像分类、推荐系统以及药物发现等多个领域取得了显著成功。近年来,越来越多的研究致力于开发具有更强表示学习能力和更低计算复杂度的基于Mamba的深度学习模型。鉴于Mamba的快速发展,迫切需要对其进行系统性的概述。为填补这一空白,本文对Mamba进行了全面回顾,重点介绍了其架构进展、数据适应性和应用领域,为研究人员提供了对Mamba最新发展的深入理解和总体概览。此外,鉴于Mamba研究仍处于初期阶段,我们还讨论了当前的局限性,并提出了未来研究的有前景方向。