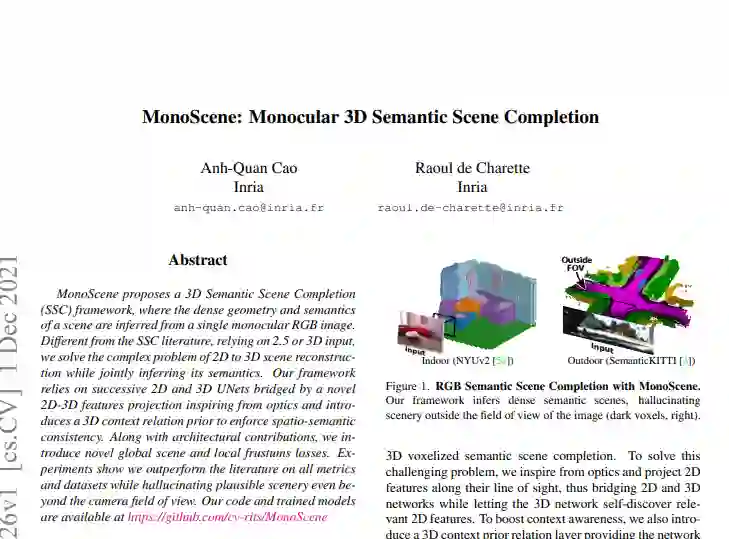

● 论文摘要:提出了一个三维语义场景完成(SSC)框架,其中场景的密集几何和语义是由单目RGB图像推断出来的。与SSC文献不同,我们依靠2.5或3D输入,解决了2D到3D场景重建的复杂问题,同时联合推断其语义。我们的框架依赖于连续的2D和3D UNets,它由一种新颖的2D-3D特征投影连接起来,这种投影来源于光学,并在执行空间语义一致性之前引入了3D上下文关系。在建筑贡献的同时,我们介绍了新颖的全球场景和当地的圆锥台的损失。实验表明,我们在所有指标和数据集上的表现都优于文献,即使在相机视野之外,我们也能幻想出似是而非的风景。

● 论文主页:https://cv-rits.github.io/MonoScene/

● 论文链接:https://arxiv.org/abs/2112.00726

● 论文代码:https://github.com/cv-rits/MonoScene

● 作者单位:法国国家信息与自动化研究所(INRIA)

成为VIP会员查看完整内容

相关内容

专知会员服务

18+阅读 · 2022年3月19日

【CVPR 2022】从大量非正式视频中构建可动画的3D神经模型,BANMo: Building Animatable 3D Neural Models from Many Casual Videos

专知会员服务

25+阅读 · 2022年3月3日

Arxiv

0+阅读 · 2022年4月15日

Arxiv

1+阅读 · 2022年4月15日