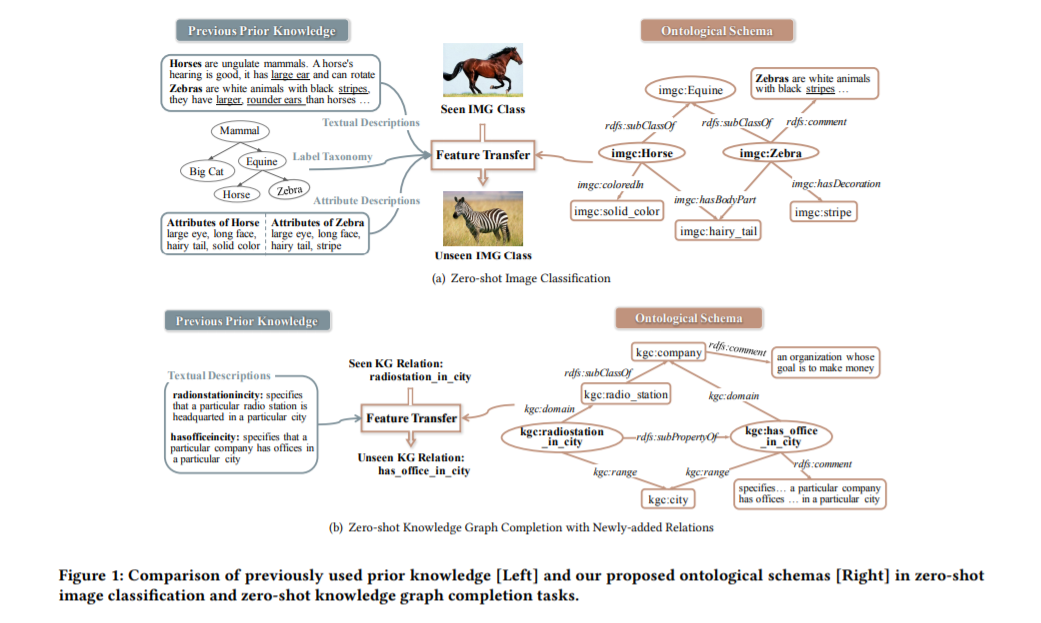

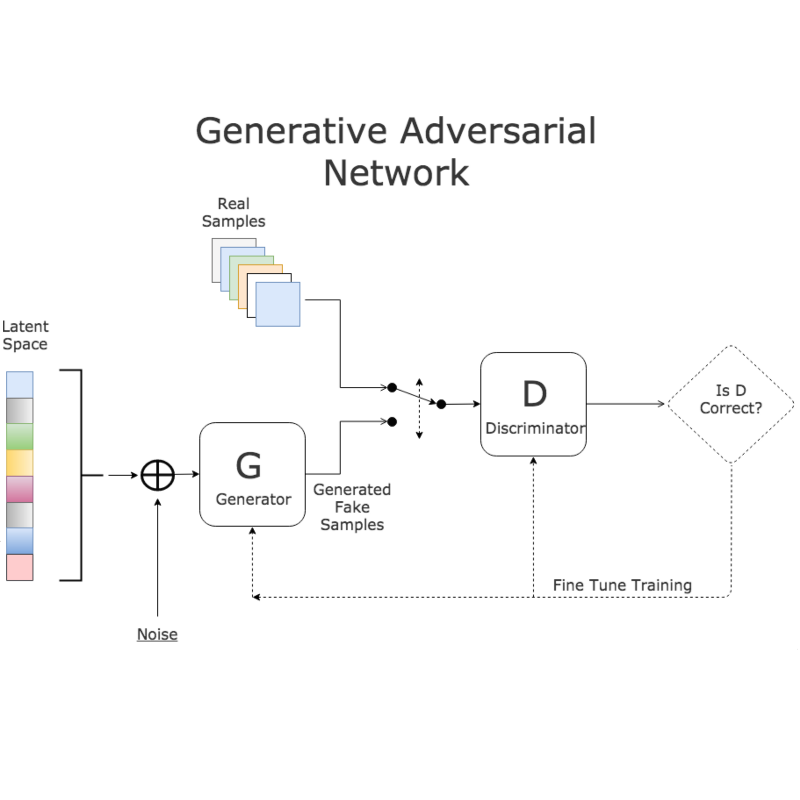

零样本学习(Zero-shot Learning, ZSL)是一种针对从未出现在训练数据中的类别进行预测的学习方法,目前已成为研究热点。实现ZSL的关键是利用类的先验知识,构建类之间的语义关系,并使学习到的模型(例如,特性)能够从训练类(例如,可见类)转移到不可见类。然而,现有方法所采用的先验相对有限,语义不完全。本文通过基于本体的知识表示和语义嵌入,探索更丰富和更具竞争性的先验知识,为ZSL的类间关系建模。同时,为了解决可见类和不可见类之间的数据不平衡问题,我们提出了带有生成式对抗网络(GANs)的生成式ZSL框架。我们的主要发现包括: (i)一个本体增强的ZSL框架,可以应用于不同的领域,如图像分类(IMGC)和知识图谱补全(KGC); (ii)利用来自不同领域的多个零样本数据集进行综合评估,我们的方法往往比最先进的模型获得更好的性能。特别是,在IMGC的四个代表性的ZSL基线上,基于本体的类语义优于之前的预测,例如,在两个示例数据集上,类的词嵌入在标准ZSL中的平均精度为12.4点(见图4)。

https://www.zhuanzhi.ai/paper/455f8ab60b8550b4318debc0acebe2d3

成为VIP会员查看完整内容

相关内容

专知会员服务

66+阅读 · 2020年4月17日