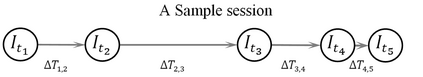

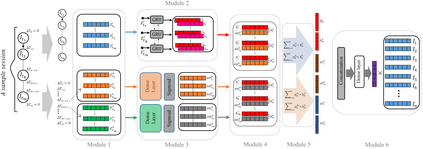

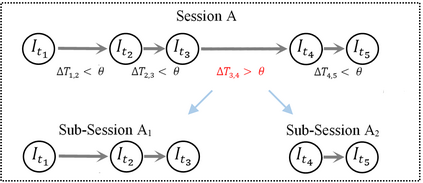

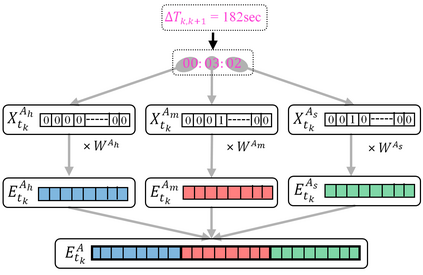

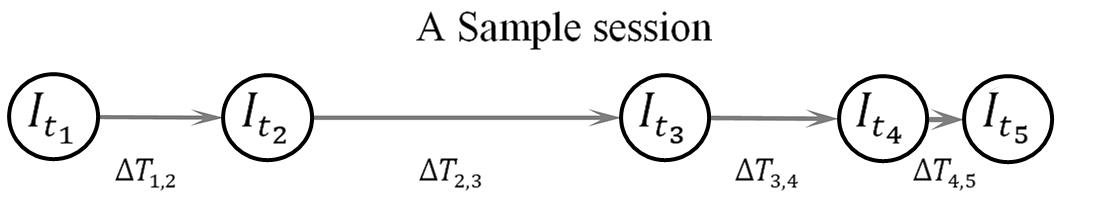

Session-Based Recommenders (SBRs) aim to predict users' next preferences regard to their previous interactions in sessions while there is no historical information about them. Modern SBRs utilize deep neural networks to map users' current interest(s) during an ongoing session to a latent space so that their next preference can be predicted. Although state-of-art SBR models achieve satisfactory results, most focus on studying the sequence of events inside sessions while ignoring temporal details of those events. In this paper, we examine the potential of session temporal information in enhancing the performance of SBRs, conceivably by reflecting the momentary interests of anonymous users or their mindset shifts during sessions. We propose the STAR framework, which utilizes the time intervals between events within sessions to construct more informative representations for items and sessions. Our mechanism revises session representation by embedding time intervals without employing discretization. Empirical results on Yoochoose and Diginetica datasets show that the suggested method outperforms the state-of-the-art baseline models in Recall and MRR criteria.

翻译:以会议为基础的建议者(SBRs)旨在预测用户对以往会议互动的下一个偏好,尽管没有关于它们的历史信息。现代SBRs利用深神经网络将用户当前的兴趣映射到一个潜在空间,以便预测他们的下一个偏好。尽管最先进的SBR模型取得了令人满意的结果,但大多数侧重于研究会议内部事件的顺序,而忽视了这些活动的时间细节。在本文件中,我们考察了会议时间信息在提高SBRs绩效方面的潜力,可以想象地反映匿名用户的暂时兴趣或他们在会议期间的心态转变。我们提出了STAR框架,该框架利用会议期间活动之间的间隔来为项目和会议建立更多的信息说明。我们的机制通过不使用离散的间隔来修改会议的代表性。关于Yoochoose和Diginetica数据集的实证结果显示,所建议的方法超过了回授和MRR标准中最先进的基线模型。