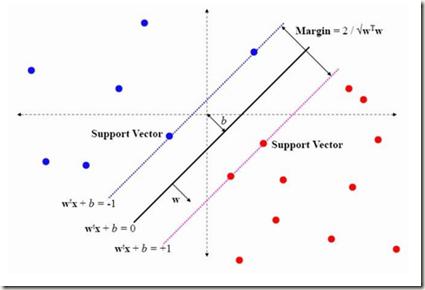

MindSculpt enables users to generate a wide range of hybrid geometries in Grasshopper in real time simply by thinking about those geometries. This design tool combines a brain-computer interface (BCI) with the parametric design platform Grasshopper, creating an intuitive design workflow that shortens the latency between ideation and implementation compared to traditional computer-aided design tools based on mouse-and-keyboard paradigms. The project arises from transdisciplinary research between neuroscience and architecture, with the goal of building a cyber-human collaborative tool that is capable of leveraging the complex and fluid nature of thinking in the design process. MindSculpt applies a supervised machine-learning approach, based on the support vector machine model (SVM), to identify patterns of brain waves that occur in EEG data when participants mentally rotate four different solid geometries. The researchers tested MindSculpt with participants who had no prior experience in design and found that the tool was enjoyable to use and could contribute to design ideation and artistic endeavors.

翻译:脑雕塑使用户能够仅仅通过考虑这些地理比例来实时生成大量相混合的对流结构。这个设计工具将大脑-计算机界面(BCI)和参数设计平台(Grasible)结合起来,创造了一个直观的设计工作流程,缩短思想和执行之间的延缓度,而与基于鼠键模型的传统计算机辅助设计工具相比,它缩短了思想与执行之间的延缓度。该项目产生于神经科学和结构之间的跨学科研究,目的是建立一个网络-人类合作工具,能够在设计过程中利用复杂和流畅的思维性质。MindSculpt在支持矢量机模型(SVM)的基础上,采用一个受监督的机器学习方法,以确定在EEG数据中出现脑波的模式,因为参与者在精神上旋转了四种不同的固态地理比例。研究人员测试了MindSculpt与在设计方面没有经验的参与者进行了测试,发现该工具可以使用,并有助于设计思想和艺术努力。</s>