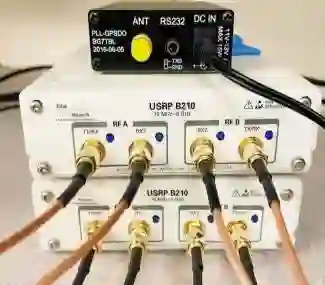

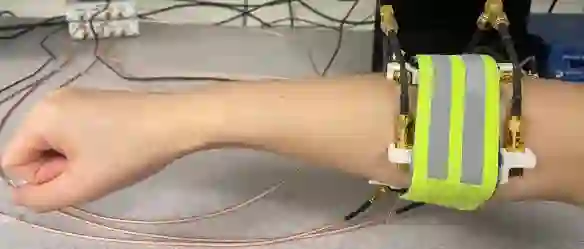

Conventional electromyography (EMG) measures the continuous neural activity during muscle contraction, but lacks explicit quantification of the actual contraction. Mechanomyography (MMG) and accelerometers only measure body surface motion, while ultrasound, CT-scan and MRI are restricted to in-clinic snapshots. Here we propose a novel radiomyography (RMG) for continuous muscle actuation sensing that can be wearable and touchless, capturing both superficial and deep muscle groups. We verified RMG experimentally by a forearm wearable sensor for detailed hand gesture recognition. We first converted the radio sensing outputs to the time-frequency spectrogram, and then employed the vision transformer (ViT) deep learning network as the classification model, which can recognize 23 gestures with an average accuracy up to 99% on 8 subjects. By transfer learning, high adaptivity to user difference and sensor variation were achieved at an average accuracy up to 97%. We further demonstrated RMG to monitor eye and leg muscles and achieved high accuracy for eye movement and body postures tracking. RMG can be used with synchronous EMG to derive stimulation-actuation waveforms for many future applications in kinesiology, physiotherapy, rehabilitation, and human-machine interface.

翻译:常规电磁学(EMG) 测量肌肉收缩期间的连续神经活动,但缺乏对实际收缩的明确量化。 美学和加速仪只测量身体表面运动, 而超声波、 CT- 扫描和 MRI 仅限于临床切片。 我们在这里建议使用新型射电学(RMG) 进行连续肌肉振动感应, 它可以磨损和触摸不到, 捕捉表面和深肌肉组。 我们用一个前臂磨损传感器对RMG进行实验, 以便进行详细的手势识别。 我们首先将无线电感应输出转换为时频光谱学, 然后使用视力变异器(VT) 深深学习网络作为分类模型, 它可以识别23个平均精度达99%的动作, 8个科目上的平均精度达到99%。 通过传输学习, 用户差异的高适应性和感应变, 平均精度达到97% 。 我们进一步演示RMG, 以监测眼和腿肌肉, 并实现眼睛运动和身体姿势的高度精确度跟踪。 RMMG, 可用于同步- mG 今后许多的化学- 和感光学- 和感应 。