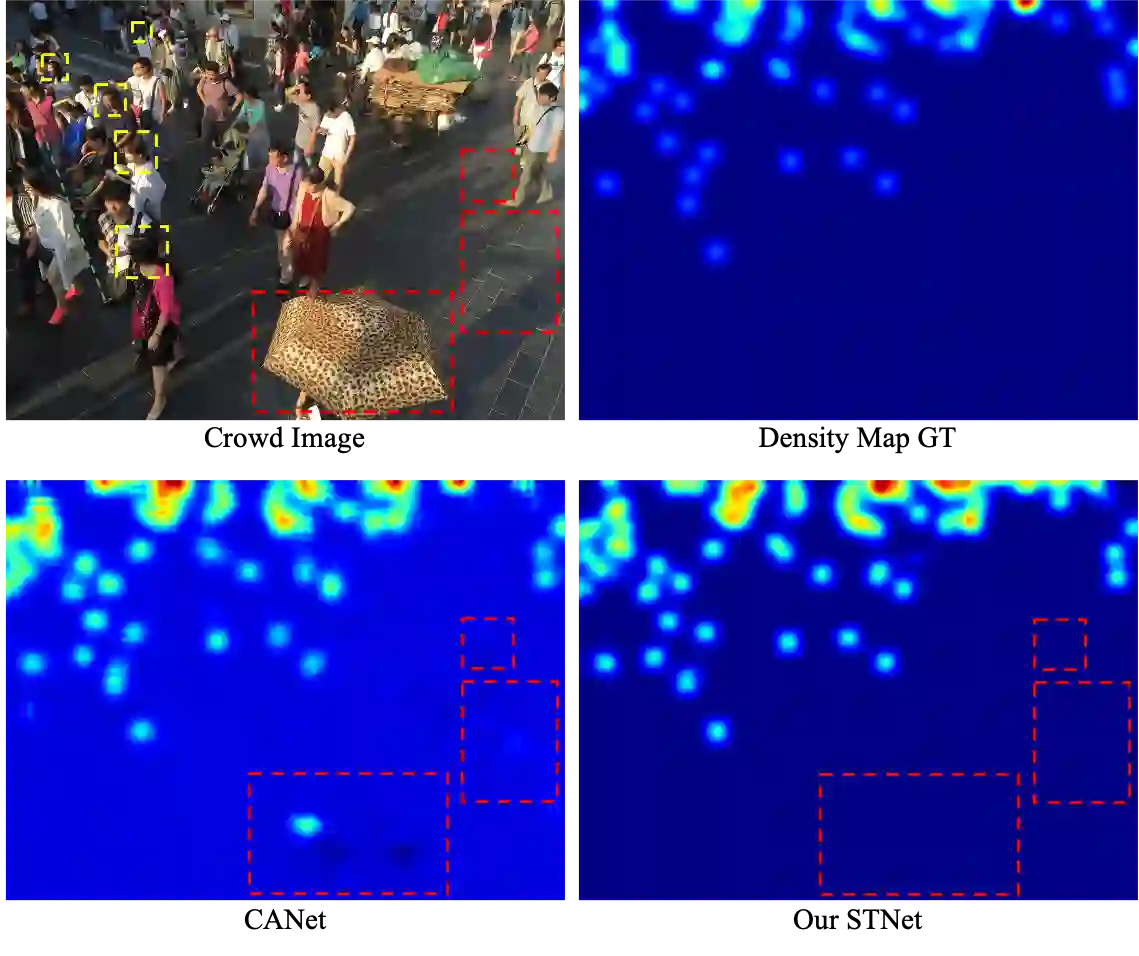

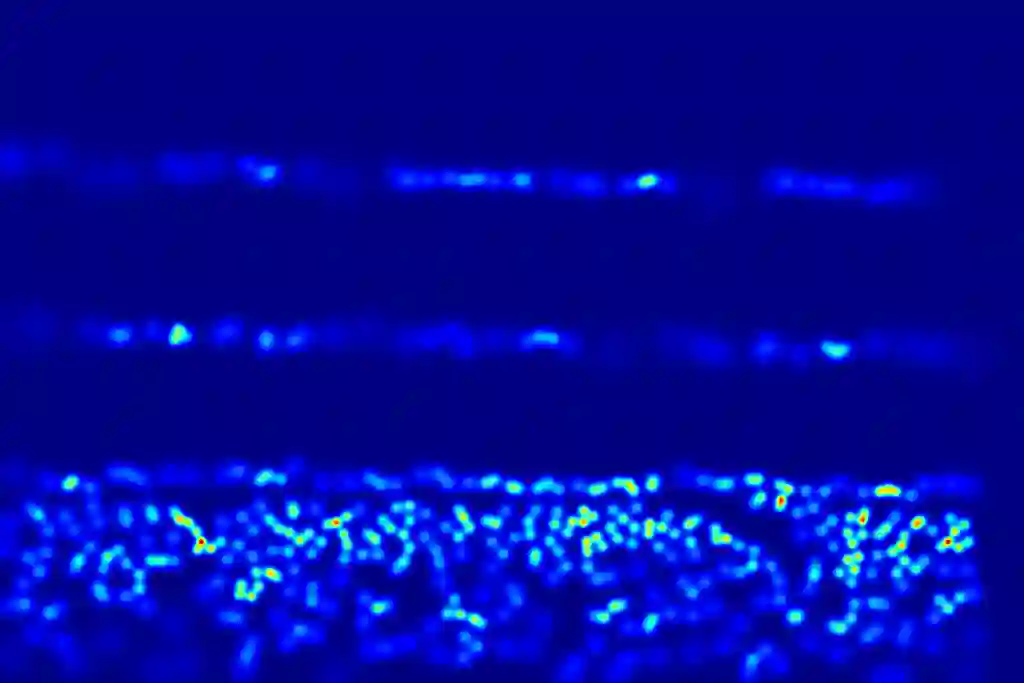

Crowd counting remains a challenging task because the presence of drastic scale variation, density inconsistency, and complex background can seriously degrade the counting accuracy. To battle the ingrained issue of accuracy degradation, we propose a novel and powerful network called Scale Tree Network (STNet) for accurate crowd counting. STNet consists of two key components: a Scale-Tree Diversity Enhancer and a Semi-supervised Multi-level Auxiliator. Specifically, the Diversity Enhancer is designed to enrich scale diversity, which alleviates limitations of existing methods caused by insufficient level of scales. A novel tree structure is adopted to hierarchically parse coarse-to-fine crowd regions. Furthermore, a simple yet effective Multi-level Auxiliator is presented to aid in exploiting generalisable shared characteristics at multiple levels, allowing more accurate pixel-wise background cognition. The overall STNet is trained in an end-to-end manner, without the needs for manually tuning loss weights between the main and the auxiliary tasks. Extensive experiments on four challenging crowd datasets demonstrate the superiority of the proposed method.

翻译:人群计数仍是一项艰巨的任务,因为规模差异巨大,密度不一致,背景复杂,会严重降低计数的准确性。为了应对精度退化这一根深蒂固的问题,我们提议建立一个名为“规模树网络(STNet)”的新颖而强大的网络,用于准确的人群计数。STNet由两个关键部分组成:一个规模树多样性增强器和一个半监督的多层次辅助器。具体地说,多样性增强器旨在丰富规模多样性,从而减轻现有方法因规模不足而造成的局限性。在四级粗略的从粗略到平面的人群聚居区采用了新的树结构。此外,还介绍了一个简单而有效的多层次辅助器,以帮助在多个级别上利用通用的共同特征,从而实现更准确的等离子线背景识调。总体的STNet以端到端方式培训,而无需对主任务和辅助任务之间的损失重量进行手工调整。对四个具有挑战性的人群数据集进行了广泛的实验,展示了拟议方法的优越性。