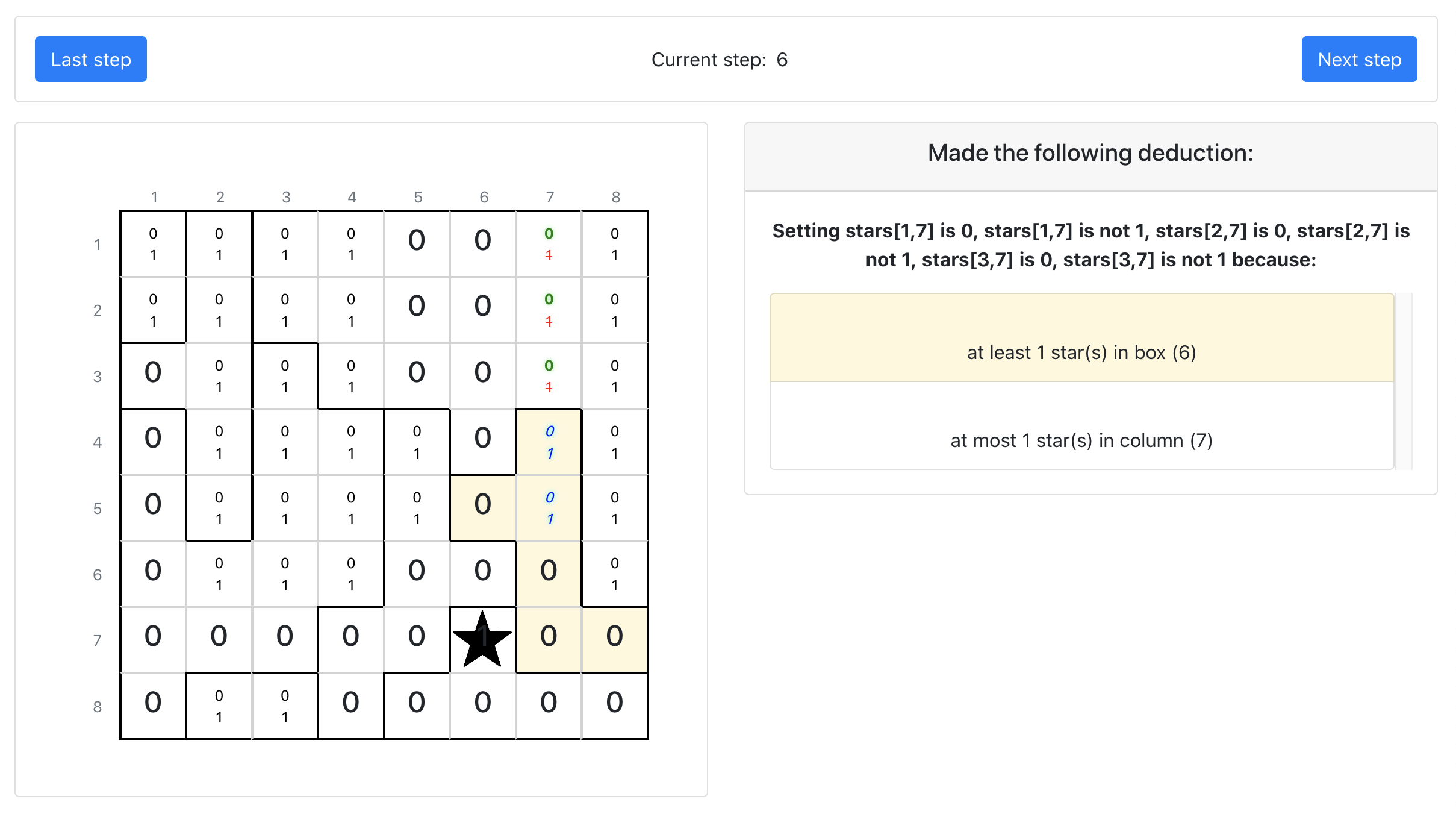

In this paper, we present Demystify, a general tool for creating human-interpretable step-by-step explanations of how to solve a wide range of pen and paper puzzles from a high-level logical description. Demystify is based on Minimal Unsatisfiable Subsets (MUSes), which allow Demystify to solve puzzles as a series of logical deductions by identifying which parts of the puzzle are required to progress. This paper makes three contributions over previous work. First, we provide a generic input language, based on the Essence constraint language, which allows us to easily use MUSes to solve a much wider range of pen and paper puzzles. Second, we demonstrate that the explanations that Demystify produces match those provided by humans by comparing our results with those provided independently by puzzle experts on a range of puzzles. We compare Demystify to published guides for solving a range of different pen and paper puzzles and show that by using MUSes, Demystify produces solving strategies which closely match human-produced guides to solving those same puzzles (on average 89% of the time). Finally, we introduce a new randomised algorithm to find MUSes for more difficult puzzles. This algorithm is focused on optimised search for individual small MUSes.

翻译:在本文中, 我们介绍Demystify( Demystify), 这是一种用于从高层次逻辑描述中解开大量笔和纸质谜题的通用工具, 用于从高层次逻辑描述中解开大量笔和纸质谜题。 Demystify( MUSes) 是基于最小不满意的子集( MUSes), 使得解密可以将谜题解开为一系列逻辑推理的序列。 我们比较解谜题中哪些部分需要向前推进。 本文比先前的工作做了三点贡献 。 首先, 我们提供了一种通用输入语言, 以 Esence 约束语言为基础, 使我们能够很容易地使用 MUSes 解开更多笔和纸质谜题题。 其次, 我们通过比较解谜小解谜小解谜小解谜( 平均为89% ) 和解谜专家在一系列解谜中独立提供的结果, 来解谜题。 我们比较解谜类比已出版的指南, 解决不同笔和纸质谜题题, 并显示使用 Mmystifififific( imalimalimalimalimal) as) 等新指南的策略与解谜题解的解谜题( 。