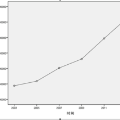

Entropy measures are effective features for time series classification problems. Traditional entropy measures, such as Shannon entropy, use probability distribution function. However, for the effective separation of time series, new entropy estimation methods are required to characterize the chaotic dynamic of the system. Our concept of Neural Network Entropy (NNetEn) is based on the classification of special datasets (MNIST-10 and SARS-CoV-2-RBV1) in relation to the entropy of the time series recorded in the reservoir of the LogNNet neural network. NNetEn estimates the chaotic dynamics of time series in an original way. Based on the NNetEn algorithm, we propose two new classification metrics: R2 Efficiency and Pearson Efficiency. The efficiency of NNetEn is verified on separation of two chaotic time series of sine mapping using dispersion analysis (ANOVA). For two close dynamic time series (r = 1.1918 and r = 1.2243), the F-ratio has reached the value of 124 and reflects high efficiency of the introduced method in classification problems. The EEG signal classification for healthy persons and patients with Alzheimer disease illustrates the practical application of the NNetEn features. Our computations demonstrate the synergistic effect of increasing classification accuracy when applying traditional entropy measures and the NNetEn concept conjointly. An implementation of the algorithms in Python is presented.

翻译:熵测量是时间序列分类问题的有效特征。传统熵测量,如香农熵,使用概率分布函数。然而,为了有效分离时间序列,需要新的熵估计方法来表征系统的混沌动态。我们提出的神经网络熵(NNetEn)概念是基于MNIST-10和SARS-CoV-2-RBV1中的特殊数据集分类与记录在LogNNet神经网络中的时间序列的熵之间的关系。NNetEn以原创的方式估计时间序列的混沌动态。基于NNetEn算法,我们提出了两个新的分类指标:R2效率和Pearson效率。 NNetEn的有效性通过使用方差分析(ANOVA)分离正弦映射的两个混沌时间序列进行验证。 对于两个接近的动态时间序列(r = 1.1918和r = 1.2243),F-ratio达到了124的值,反映了所引入的分类问题的高效性。对于健康人和患有阿尔茨海默病的患者的脑电信号分类,展示了NNetEn特征的实际应用。我们的计算表明,同时应用传统的熵测量和NNetEn概念时,分类准确度的提高具有协同作用。该算法的Python实现已提供。