【KDD2020-Tutorial】因果推理与稳定学习,Causal Inference and Stable Learning

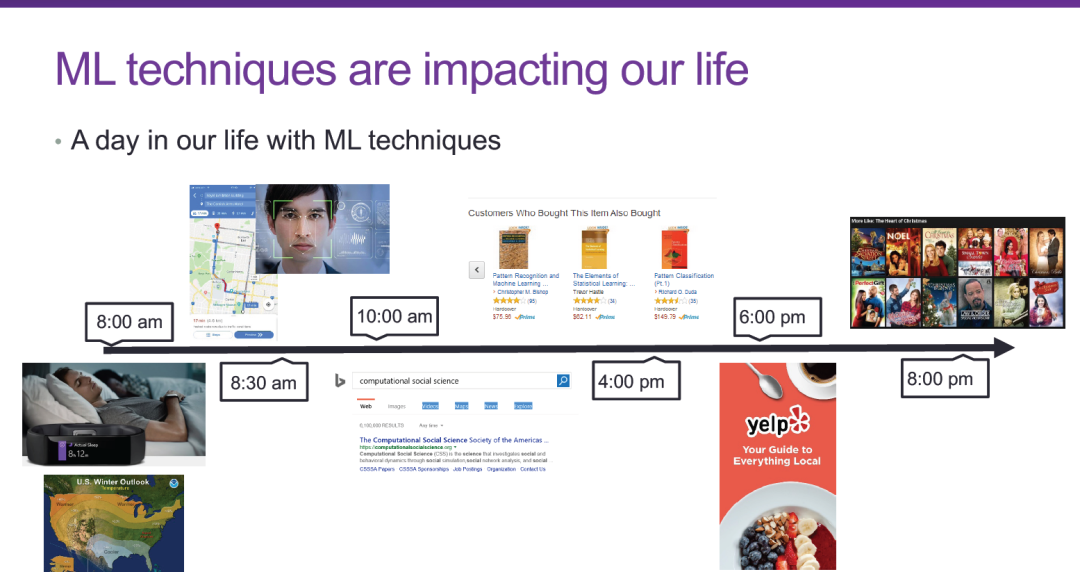

在一个常见的机器学习问题中,使用对训练数据集估计的模型,根据观察到的特征预测未来的结果值。当测试数据和训练数据来自相同的分布时,许多学习算法被提出并证明是成功的。然而,对于给定的训练数据分布,性能最好的模型通常会利用特征之间微妙的统计关系,这使得它们在应用于分布与训练数据不同的测试数据时,可能更容易出现预测错误。对于学术研究和实际应用来说,如何开发能够稳定和稳健地转换数据的学习模型是至关重要的。

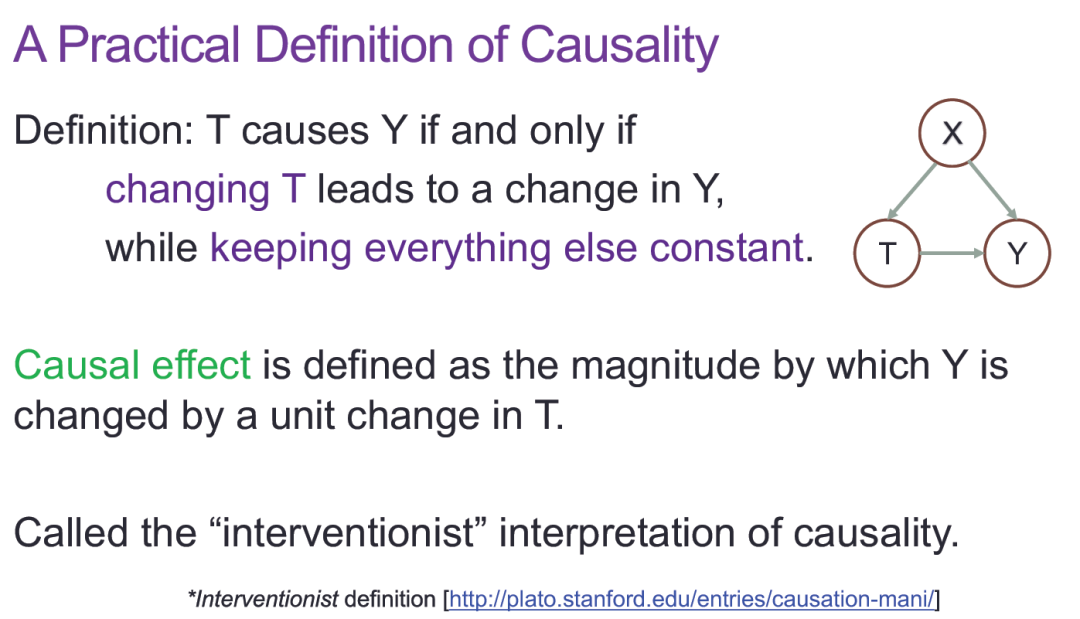

因果推理是指根据效果发生的条件得出因果关系的结论的过程,是一种强大的统计建模工具,用于解释和稳定学习。本教程侧重于因果推理和稳定学习,旨在从观察数据中探索因果知识,提高机器学习算法的可解释性和稳定性。首先,我们将介绍因果推论,并介绍一些最近的数据驱动方法,以估计因果效应从观测数据,特别是在高维设置。为了弥补因果推理和机器学习之间的差距,我们首先给出了稳定性和鲁棒性学习算法的定义,然后将介绍一些最近的稳定学习算法来提高预测的稳定性和可解释性。最后,我们将讨论稳定学习的应用和未来的发展方向,并提供稳定学习的基准。

http://kdd2020tutorial.thumedialab.com/

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“CISL” 可以获取《【KDD2020-Tutorial】因果推理与稳定学习,Causal Inference and Stable Learning》专知下载链接索引

登录查看更多

相关内容

专知会员服务

48+阅读 · 2019年12月13日

Arxiv

5+阅读 · 2018年7月23日