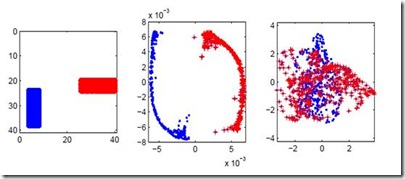

We adapt previous research on category theory and topological unsupervised learning to develop a functorial perspective on manifold learning. We first characterize manifold learning algorithms as functors that map pseudometric spaces to optimization objectives and factor through hierachical clustering functors. We then use this characterization to prove refinement bounds on manifold learning loss functions and construct a hierarchy of manifold learning algorithms based on their invariants. We express several popular manifold learning algorithms as functors at different levels of this hierarchy, including Metric Multidimensional Scaling, IsoMap, Laplacian Eigenmaps, and UMAP. Next, we use interleaving distance to study the stability of a broad class of manifold learning algorithms. We present bounds on how closely the embeddings these algorithms produce from noisy data approximate the embeddings they would learn from noiseless data. Finally, we use our framework to derive a set of novel manifold learning algorithms, which we experimentally demonstrate are competitive with the state of the art.

翻译:我们调整了先前的分类理论和地形学学学研究,以发展关于多重学习的复式视角。 我们首先将多重学习算法定性为绘制假数空间以优化目标和因子的真菌。 我们然后使用这种定性来证明关于多重学习损失功能的精细界限, 并根据其变异性构建一个多重学习算法的层次。 我们作为这一层次的不同层次的真菌, 包括Metric MDoverlobal Astruction, IsoMap, Laplaceian Eigenmaps, 和 UMAP, 表达一些流行的多元学习算法。 下一步, 我们利用间距来研究一系列广泛的多元学习算法的稳定性。 我们展示了这些算法从杂乱的数据中产生如何接近它们从无噪音数据中学习的嵌入。 最后, 我们用我们的框架来产生一套新型的复式学习算法, 我们实验性地证明这些算出与艺术状态具有竞争力。