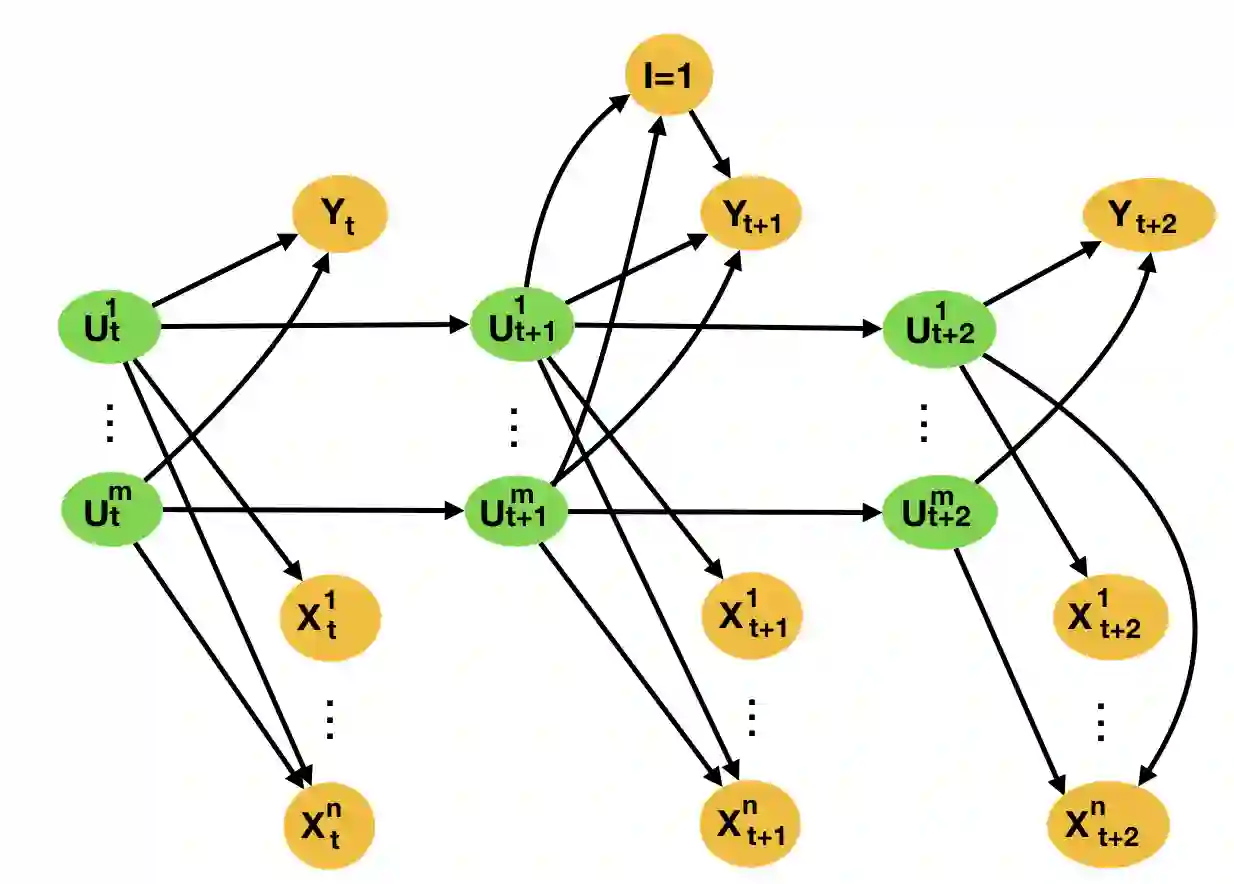

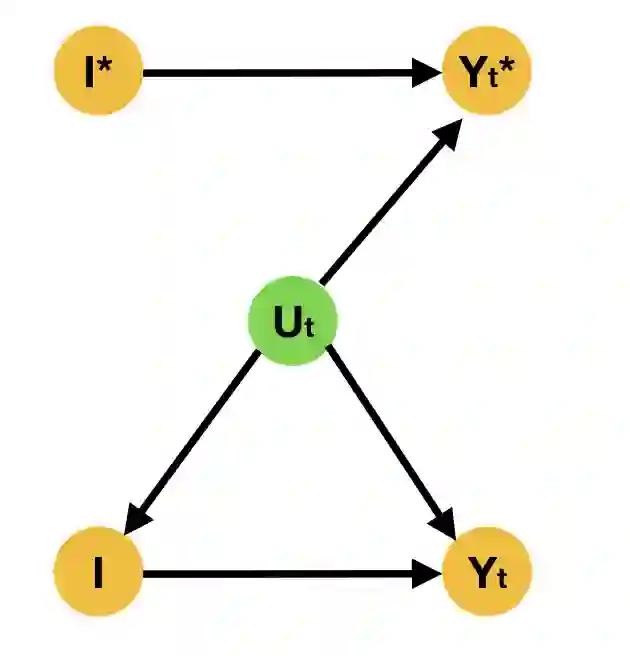

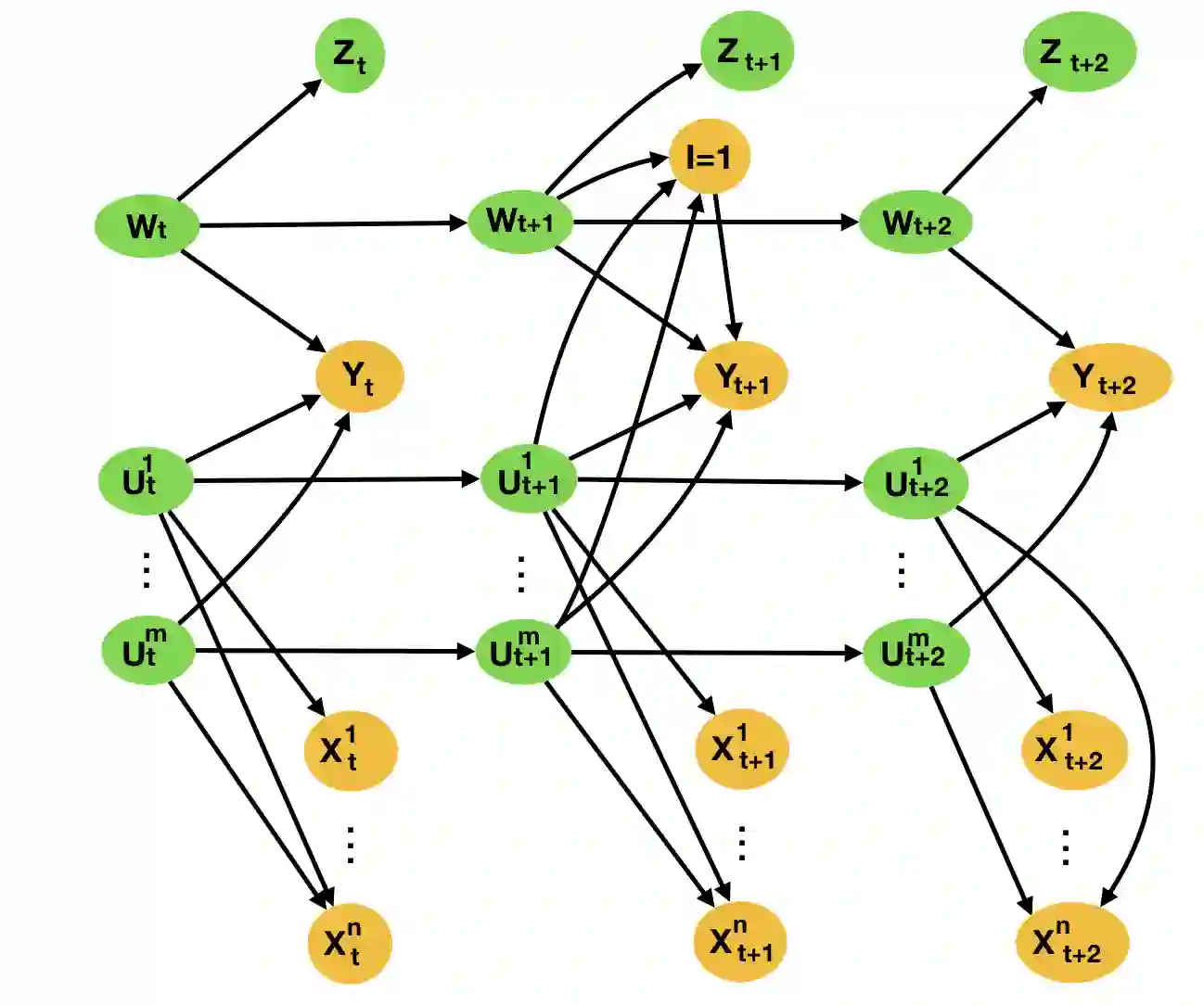

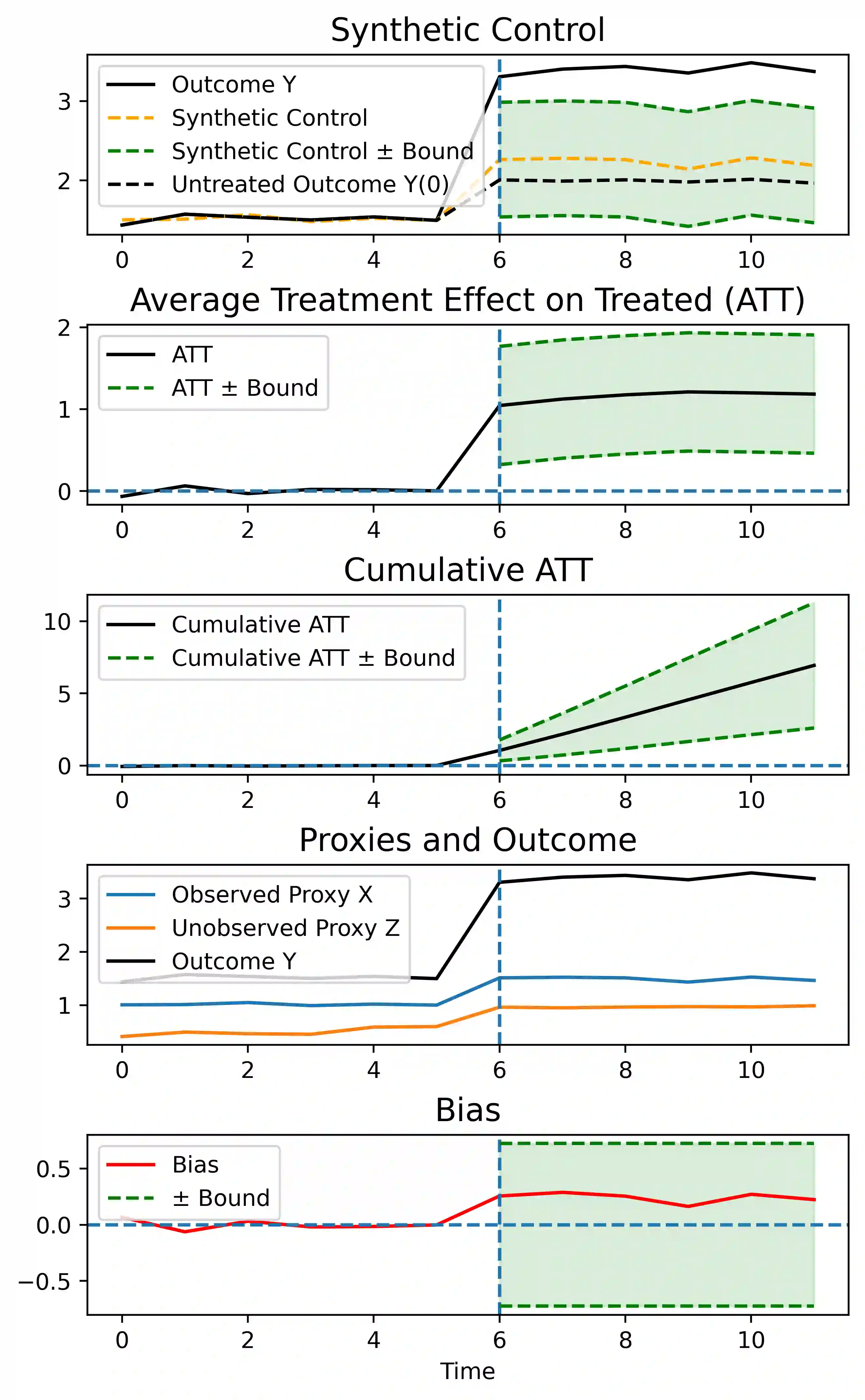

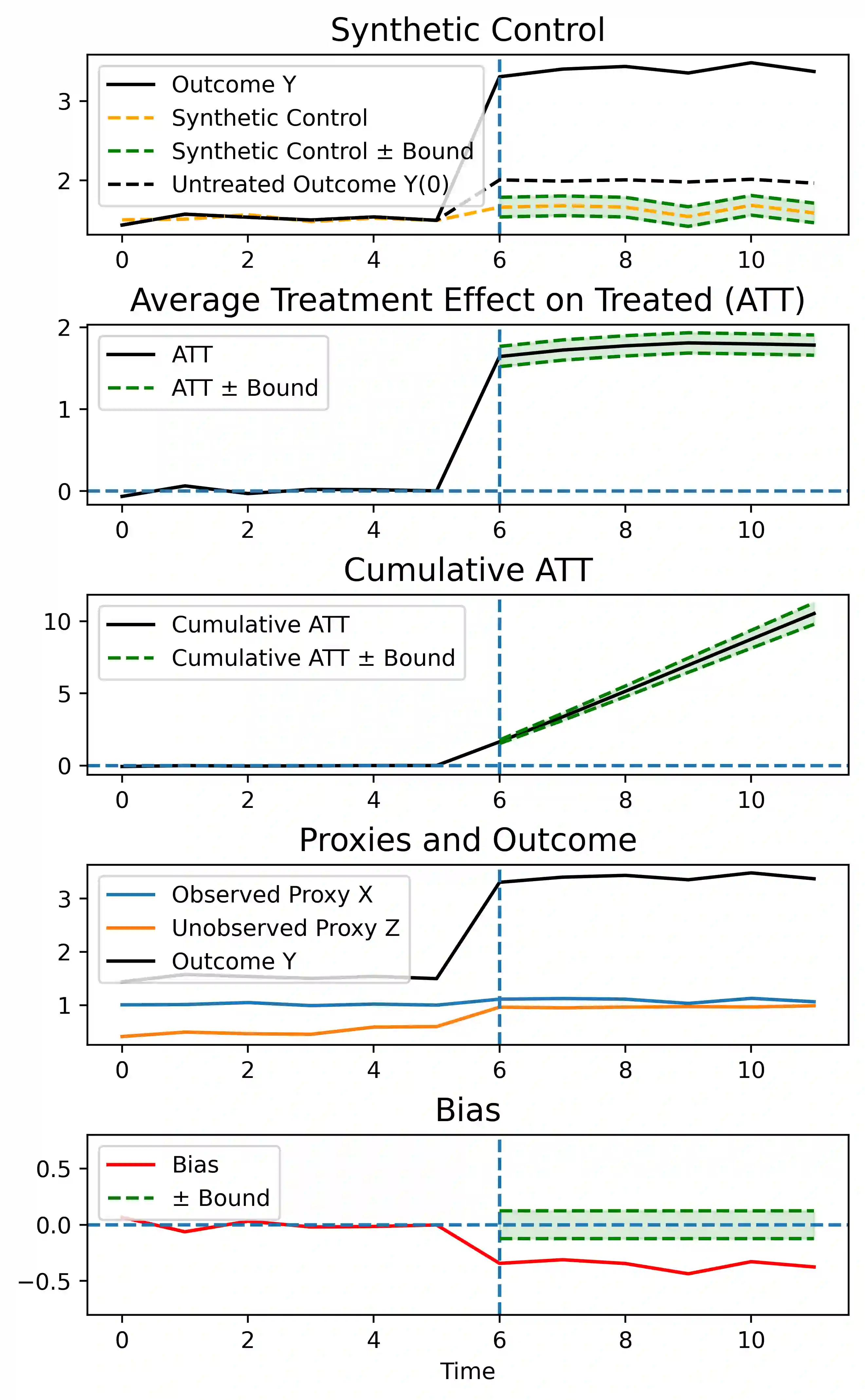

Quantifying cause and effect relationships is an important problem in many domains. The gold standard solution is to conduct a randomised controlled trial. However, in many situations such trials cannot be performed. In the absence of such trials, many methods have been devised to quantify the causal impact of an intervention from observational data given certain assumptions. One widely used method are synthetic control models. While identifiability of the causal estimand in such models has been obtained from a range of assumptions, it is widely and implicitly assumed that the underlying assumptions are satisfied for all time periods both pre- and post-intervention. This is a strong assumption, as synthetic control models can only be learned in pre-intervention period. In this paper we address this challenge, and prove identifiability can be obtained without the need for this assumption, by showing it follows from the principle of invariant causal mechanisms. Moreover, for the first time, we formulate and study synthetic control models in Pearl's structural causal model framework. Importantly, we provide a general framework for sensitivity analysis of synthetic control causal inference to violations of the assumptions underlying non-parametric identifiability. We end by providing an empirical demonstration of our sensitivity analysis framework on simulated and real data in the widely-used linear synthetic control framework.

翻译:量化因果关系是许多领域的一个重要问题。黄金标准解决方案是进行随机控制试验,但在许多情况下,这种试验无法进行。在没有这种试验的情况下,已经设计了许多方法,从观测数据中量化干预的因果关系。一种广泛使用的方法是合成控制模型。虽然从一系列假设中可以辨别出此类模型中因果关系的可测性,但广泛和隐含地假定,在干预前和干预后的所有时期,基本假设都得到了满足。这是一个强有力的假设,因为合成控制模型只能在干预前阶段学习。在本文中,我们处理这一挑战,并证明可识别性,而不需要这一假设,方法是根据不变因果关系机制的原则加以证明。此外,我们首次在珍珠的结构性因果模型框架内制定并研究合成控制模型。重要的是,我们为合成控制因果关系分析提供了一个一般框架,用以分析综合控制因果关系,推断出非定量识别性假设在干预前期间是否遭到违反。我们在本文中应对了这一挑战,并证明可识别性,无需进行这一假设,即可证明可识别性。我们通过广泛模拟的合成数据敏感性,从而对真实性进行模拟的合成控制框架进行模拟。