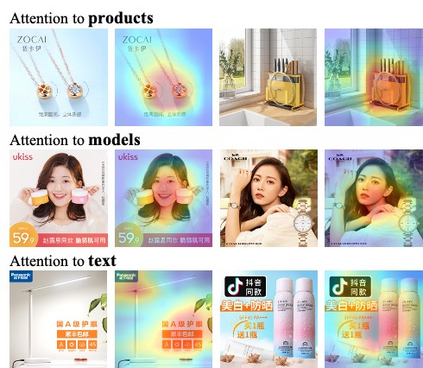

Creative plays a great important role in e-commerce for exhibiting products. Sellers usually create multiple creatives for comprehensive demonstrations, thus it is crucial to display the most appealing design to maximize the Click-Through Rate~(CTR). For this purpose, modern recommender systems dynamically rank creatives when a product is proposed for a user. However, this task suffers more cold-start problem than conventional products recommendation In this paper, we propose a hybrid bandit model with visual priors which first makes predictions with a visual evaluation, and then naturally evolves to focus on the specialities through the hybrid bandit model. Our contributions are three-fold: 1) We present a visual-aware ranking model (called VAM) that incorporates a list-wise ranking loss for ordering the creatives according to the visual appearance. 2) Regarding visual evaluations as a prior, the hybrid bandit model (called HBM) is proposed to evolve consistently to make better posteriori estimations by taking more observations into consideration for online scenarios. 3) A first large-scale creative dataset, CreativeRanking, is constructed, which contains over 1.7M creatives of 500k products as well as their real impression and click data. Extensive experiments have also been conducted on both our dataset and public Mushroom dataset, demonstrating the effectiveness of the proposed method.

翻译:创意在展示产品的电子商务中起着非常重要的作用。 卖主通常为全面演示创造多种创意, 因此, 展示最有吸引力的设计以最大限度地实现点击- 浏览率~ (CTR) 至关重要 。 为此, 当向用户推荐产品时, 现代建议系统动态地排序创意。 然而, 这项任务比常规产品建议更会遇到冷却的启动问题 。 在本文件中, 我们提出一个具有视觉前科的混合土匪模型, 其视觉前科首先通过视觉评估作出预测, 然后自然地演变为通过混合土匪模型将重点放在专业上。 我们的贡献有三重:(1) 我们展示了一个视觉觉排名模型(称为VAM), 其中包含根据视觉外观订购创作品的列表排序损失。 (2) 关于视觉评估, 混合土匪模型(称为HBM) 提议不断演进化, 通过更多观察对在线情景进行更好的事后估计。 3) 第一个大型的创意数据集, 创意数据集(CreamRanking) 正在构建, 包含超过 1.7M 的创意产品, 以及我们所拟议的真实印象和点击数据方法进行的数据。