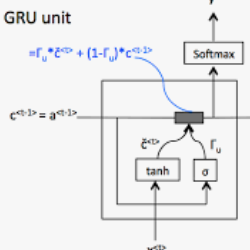

Point clouds collected by real-world sensors are always unaligned and sparse, which makes it hard to reconstruct the complete shape of object from a single frame of data. In this work, we manage to provide complete point clouds from sparse input with pose disturbance by limited translation and rotation. We also use temporal information to enhance the completion model, refining the output with a sequence of inputs. With the help of gated recovery units(GRU) and attention mechanisms as temporal units, we propose a point cloud completion framework that accepts a sequence of unaligned and sparse inputs, and outputs consistent and aligned point clouds. Our network performs in an online manner and presents a refined point cloud for each frame, which enables it to be integrated into any SLAM or reconstruction pipeline. As far as we know, our framework is the first to utilize temporal information and ensure temporal consistency with limited transformation. Through experiments in ShapeNet and KITTI, we prove that our framework is effective in both synthetic and real-world datasets.

翻译:由真实世界传感器收集的点云总是不相容和稀少的,因此很难从一个数据框架来重建物体的完整形状。 在这项工作中,我们设法通过有限的翻译和旋转来提供从微量输入中产生的完整的点云,造成干扰;我们还利用时间信息来增强完成模式,用一系列输入来改进输出。在封闭式恢复单位和关注机制的帮助下,我们提出了一个点云完成框架,接受一系列不匹配和稀少的投入,以及一致和一致的点云。我们的网络以在线方式运行,为每个框架提供一个精细的点云,使其能够融入任何SLAM或重建管道。据我们所知,我们的框架首先利用时间信息,确保时间与有限的转换保持一致。通过在ShapeNet和KITTI的实验,我们证明我们的框架在合成和真实世界的数据集中都是有效的。