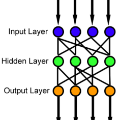

Feedforward neural networks offer a promising approach for solving differential equations. However, the reliability and accuracy of the approximation still represent delicate issues that are not fully resolved in the current literature. Computational approaches are in general highly dependent on a variety of computational parameters as well as on the choice of optimisation methods, a point that has to be seen together with the structure of the cost function. The intention of this paper is to make a step towards resolving these open issues. To this end we study here the solution of a simple but fundamental stiff ordinary differential equation modelling a damped system. We consider two computational approaches for solving differential equations by neural forms. These are the classic but still actual method of trial solutions defining the cost function, and a recent direct construction of the cost function related to the trial solution method. Let us note that the settings we study can easily be applied more generally, including solution of partial differential equations. By a very detailed computational study we show that it is possible to identify preferable choices to be made for parameters and methods. We also illuminate some interesting effects that are observable in the neural network simulations. Overall we extend the current literature in the field by showing what can be done in order to obtain reliable and accurate results by the neural network approach. By doing this we illustrate the importance of a careful choice of the computational setup.

翻译:然而,近似的可靠性和准确性仍代表着目前文献中尚未完全解决的微妙问题。 计算方法一般高度取决于各种计算参数以及优化方法的选择,这一点必须与成本功能的结构一起看待。 本文的意图是为解决这些未决问题迈出一步。 我们在此研究如何解决简单而基本的硬性普通差异方程式模拟系统。 我们考虑两种计算方法,用神经形式解决差异方程式。 这些是典型的但实际的试验方法,界定成本功能,以及最近直接构建与试验解决方案方法相关的成本函数。 让我们注意,我们研究的环境可以更容易地被广泛应用,包括部分差异方程式的解决方案。 通过一项非常详细的计算研究,我们证明有可能找到为参数和方法作出更可取的选择。 我们还展示了在神经网络模拟中观察到的一些有趣的效果。 总体而言,我们扩展了当前测试方法的当前文献的重要性,通过实地的精确度来显示我们所作的精确的计算结果。