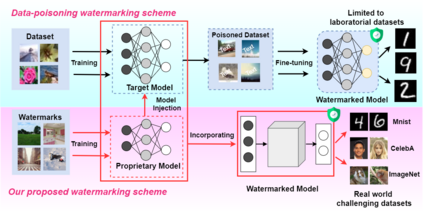

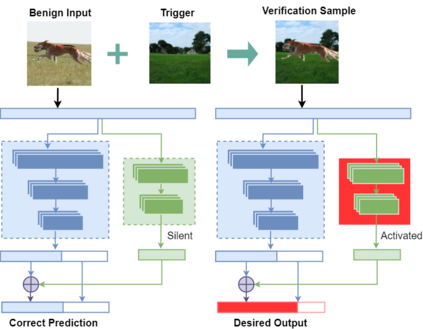

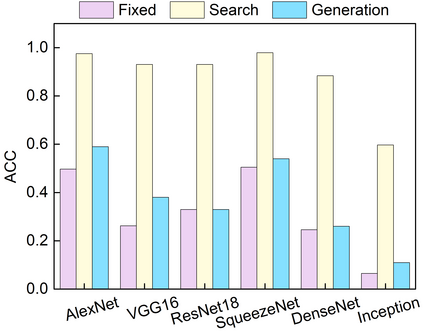

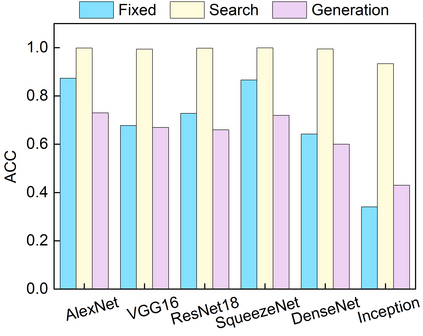

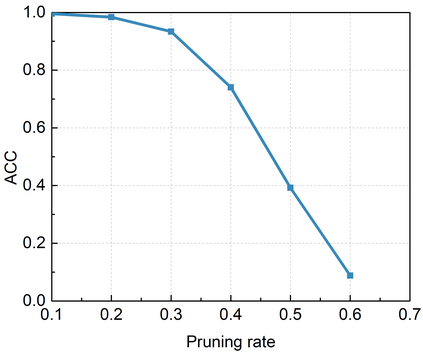

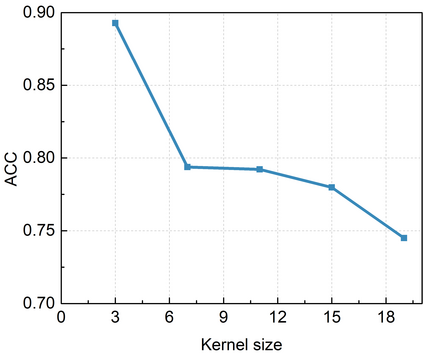

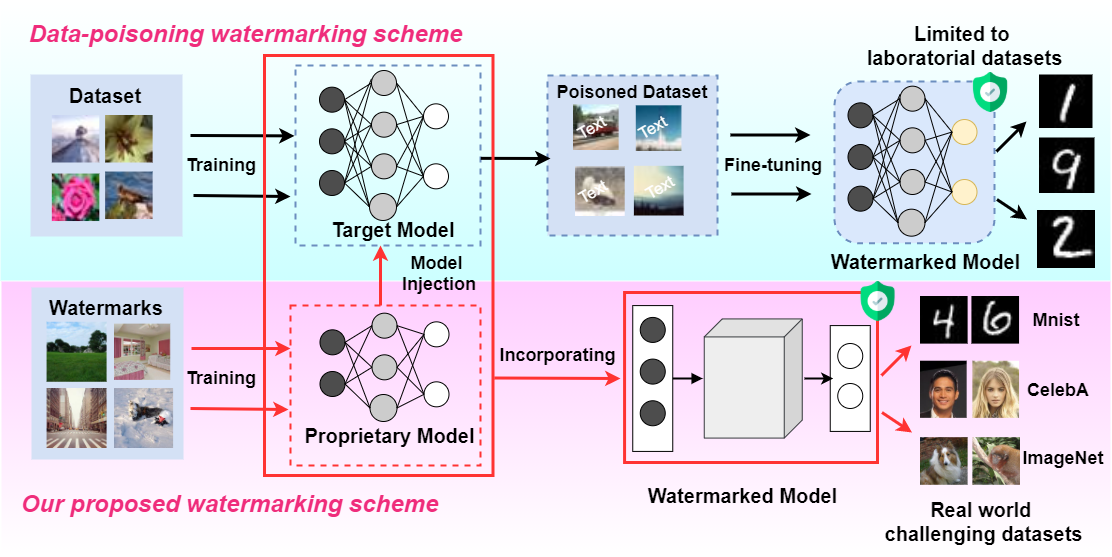

Watermarking has been widely adopted for protecting the intellectual property (IP) of Deep Neural Networks (DNN) to defend the unauthorized distribution. Unfortunately, the popular data-poisoning DNN watermarking scheme relies on target model fine-tuning to embed watermarks, which limits its practical applications in tackling real-world tasks. Specifically, the learning of watermarks via tedious model fine-tuning on a poisoned dataset (carefully-crafted sample-label pairs) is not efficient in tackling the tasks on challenging datasets and production-level DNN model protection. To address the aforementioned limitations, in this paper, we propose a plug-and-play watermarking scheme for DNN models by injecting an independent proprietary model into the target model to serve the watermark embedding and ownership verification. In contrast to the prior studies, our proposed method by incorporating a proprietary model is free of target model fine-tuning without involving any parameters update of the target model, thus the fidelity is well preserved. Our research findings reveal that model fine-tuning with poisoned data is not prepared for the IP protection of DNN models deployed in real-world tasks and poses a new research direction toward a more thorough understanding and investigation of adopting the proprietary model for DNN watermarking. The source code and models are available at https://github.com/AntigoneRandy/PTYNet.

翻译:保护深神经网络(DNN)的知识产权(IP),以维护未经授权的分布;不幸的是,流行的数据倾注 DNN的水标记计划依赖于嵌入水标记的目标模型微调,这限制了其在应对现实世界任务方面的实际应用;具体地说,通过有毒数据集(精心制作的样品标签配对)的破旧模型微调来学习水标记(IP),在处理挑战性数据集和生产级DNN模型保护的任务方面效率不高;为了应对上述限制,在本文件中,我们提议对DNN模型采用插装装水标记计划,在目标模型中注入独立的专利模型,为嵌入水标记和所有权核查服务。与先前的研究不同,我们提议的采用专有模型的方法无需目标模型微调,而不涉及目标模型的任何参数更新,因此忠实得到很好的保存。我们的研究结果表明,对有毒数据模型的微调不是为DNNNN模型的IP保护而准备的插装水标记计划,我们是在现实世界/数据库中部署的更彻底的DNA模型研究任务和新方向。