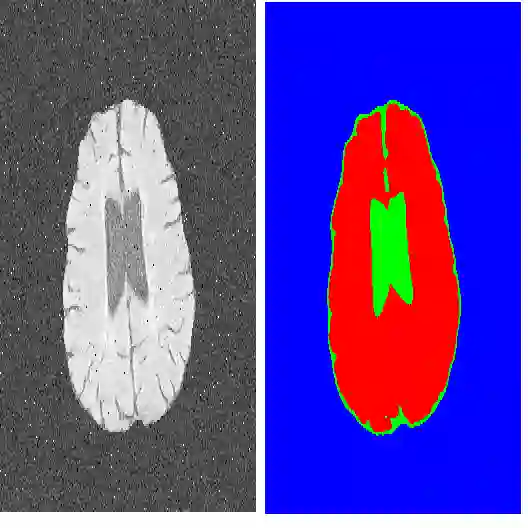

Convolutional neural networks have been widely applied to medical image segmentation and have achieved considerable performance. However, the performance may be significantly affected by the domain gap between training data (source domain) and testing data (target domain). To address this issue, we propose a data manipulation based domain generalization method, called Automated Augmentation for Domain Generalization (AADG). Our AADG framework can effectively sample data augmentation policies that generate novel domains and diversify the training set from an appropriate search space. Specifically, we introduce a novel proxy task maximizing the diversity among multiple augmented novel domains as measured by the Sinkhorn distance in a unit sphere space, making automated augmentation tractable. Adversarial training and deep reinforcement learning are employed to efficiently search the objectives. Quantitative and qualitative experiments on 11 publicly-accessible fundus image datasets (four for retinal vessel segmentation, four for optic disc and cup (OD/OC) segmentation and three for retinal lesion segmentation) are comprehensively performed. Two OCTA datasets for retinal vasculature segmentation are further involved to validate cross-modality generalization. Our proposed AADG exhibits state-of-the-art generalization performance and outperforms existing approaches by considerable margins on retinal vessel, OD/OC and lesion segmentation tasks. The learned policies are empirically validated to be model-agnostic and can transfer well to other models. The source code is available at https://github.com/CRazorback/AADG.

翻译:为解决这一问题,我们提议了一个基于数据操纵的通用域法,称为“Dome通用自动增强”(AADG),我们的AADG框架可以有效地抽样数据增强政策,产生新的域,并使培训从适当的搜索空间多样化。具体地说,我们引入了一个新的代理任务,最大限度地扩大多种扩大的新领域的多样性,如单位空间Sinkhorn距离测量的Sinkhorn距离测量的多倍增新领域多样性,使自动增强可感光度。为有效搜索目标,我们采用了基于数据操纵的域(源域域)和测试数据(目标域域)和测试数据(目标域)。我们的ADGDG框架可以有效地抽样数据增强政策,产生新的域,并使培训从适当的搜索空间多样化。具体地说,我们引入了一个新的代号(Sinkhorn)新领域的多样性,使自动增强可感光度。 Aversarial 培训和深度增强学习用于高效搜索目标。在11个公众可获取的Fundus图像数据集(4个对船进行再定分解,4个光碟和杯(ODOC)分解,以及3个正平级(ODDR)系统) 进一步验证现有的分解(SDA) 和SDA) 常规演演演演演演。