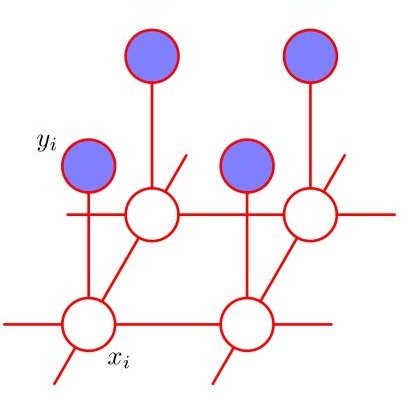

Statistical Relational Learning (SRL) models have attracted significant attention due to their ability to model complex data while handling uncertainty. However, most of these models have been limited to discrete domains due to their limited potential functions. We introduce Relational Neural Markov Random Fields (RN-MRFs) which allow for handling of complex relational hybrid domains. The key advantage of our model is that it makes minimal data distributional assumptions and can seamlessly allow for human knowledge through potentials or relational rules. We propose a maximum pseudolikelihood estimation-based learning algorithm with importance sampling for training the neural potential parameters. Our empirical evaluations across diverse domains such as image processing and relational object mapping, clearly demonstrate its effectiveness against non-neural counterparts.

翻译:统计关系学习模型(SRL)因其在处理不确定性时能够模拟复杂数据而引起人们的极大关注,然而,这些模型中的大多数都局限于不同领域,因为它们的潜在功能有限。我们引入了关系型Neural Markov随机场(RN-MRFs),以便处理复杂的关系混合领域。我们模型的主要优点是,它使数据分布假设最小化,并且能够通过潜力或关系规则无缝地允许人类知识。我们提出了一种以假象为基础的最大估计学习算法,对神经潜在参数进行重要抽样培训。我们对图像处理和关系对象绘图等不同领域的实证评估清楚地表明了它相对于非新对应方的有效性。