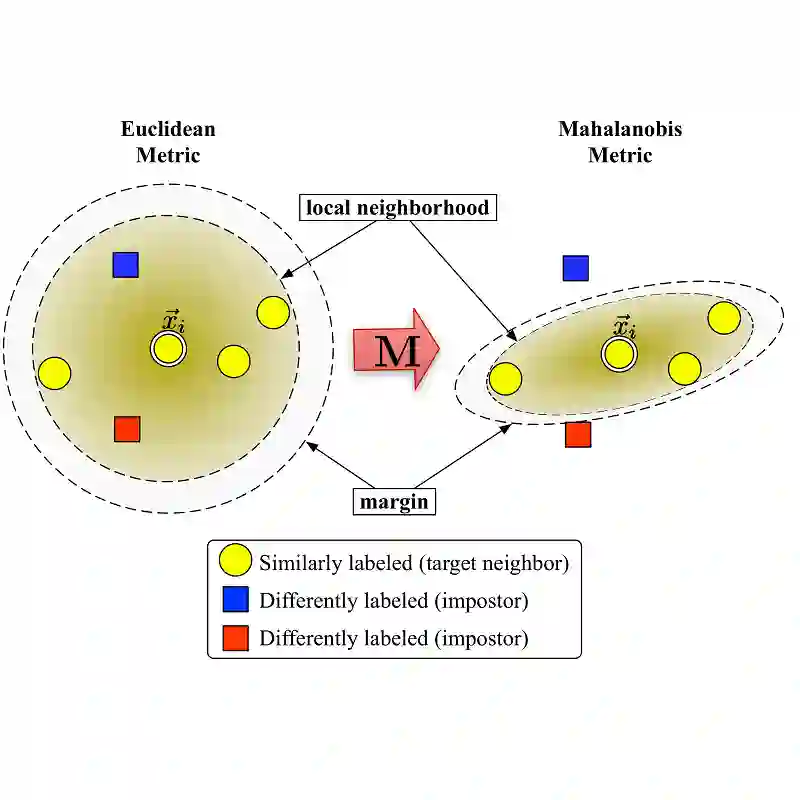

We introduce a method based on deep metric learning to perform Bayesian optimisation over high-dimensional, structured input spaces using variational autoencoders (VAEs). By extending ideas from supervised deep metric learning, we address a longstanding problem in high-dimensional VAE Bayesian optimisation, namely how to enforce a discriminative latent space as an inductive bias. Importantly, we achieve such an inductive bias using just 1% of the available labelled data relative to previous work, highlighting the sample efficiency of our approach. As a theoretical contribution, we present a proof of vanishing regret for our method. As an empirical contribution, we present state-of-the-art results on real-world high-dimensional black-box optimisation problems including property-guided molecule generation. It is the hope that the results presented in this paper can act as a guiding principle for realising effective high-dimensional Bayesian optimisation.

翻译:我们引入了一种基于深入的衡量学习方法,用变式自动读数器(VAE)对高维、结构化输入空间进行优化。 通过扩展从监督的深度测试学习中得出的理念,我们解决了高维VAE Bayesian优化方面的一个长期问题,即如何将歧视潜伏空间作为诱导偏差加以执行。重要的是,我们利用与以往工作相比仅有1%的现有标签数据来达到这种感应偏差,突出我们方法的样本效率。作为一种理论贡献,我们展示了我们方法的消亡遗憾。作为经验贡献,我们展示了现实世界高维度黑盒优化问题的最新结果,包括财产制导分子生成问题。希望本文中介绍的结果能够成为实现有效的高维海湾优化的指导原则。