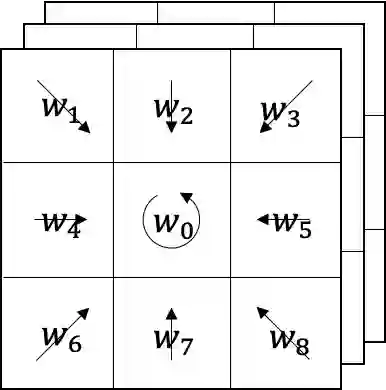

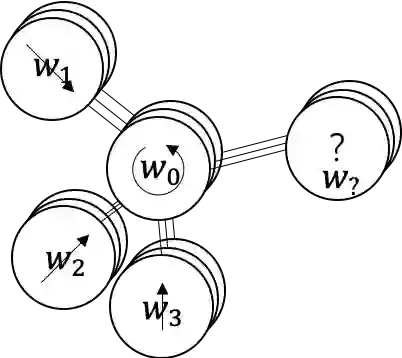

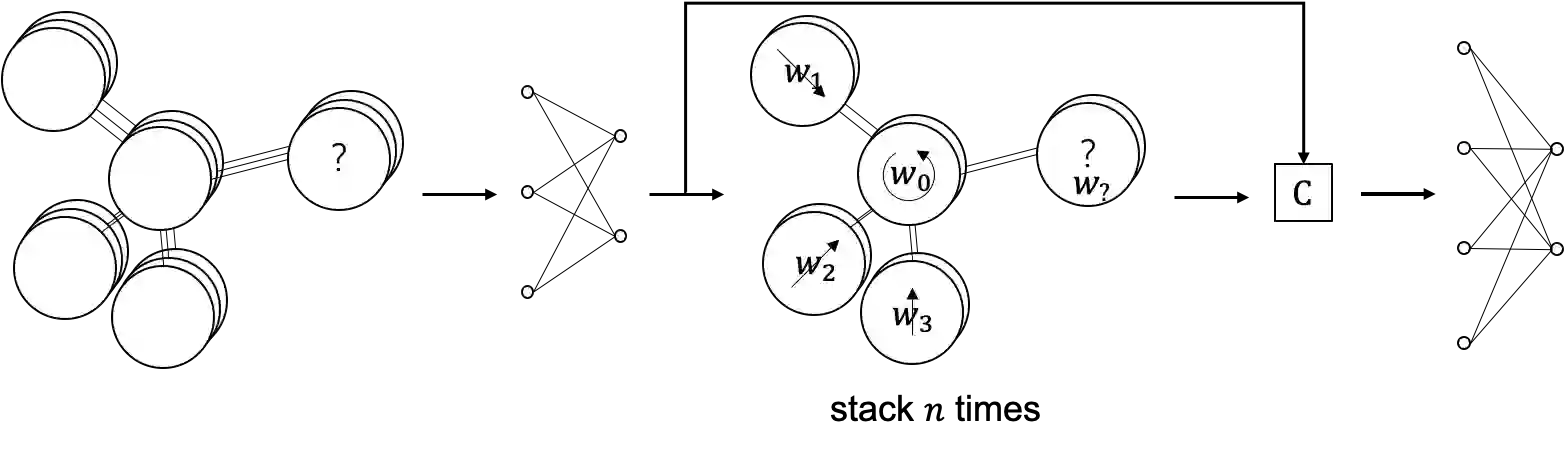

Convolutional Neural Networks(CNNs) has achieved remarkable performance breakthrough in Euclidean structure data. Recently, aggregation-transformation based Graph Neural networks(GNNs) gradually produce a powerful performance on non-Euclidean data. In this paper, we propose a cross-correlation based graph convolution method allowing to naturally generalize CNNs to non-Euclidean domains and inherit the excellent natures of CNNs, such as local filters, parameter sharing, flexible receptive field, etc. Meanwhile, it leverages dynamically generated convolution kernel and cross-correlation operators to address the shortcomings of prior methods based on aggregation-transformation or their approximations. Our method has achieved or matched popular state-of-the-art results across three established graph benchmarks: the Cora, Citeseer, and Pubmed citation network datasets.

翻译:突变神经网络(CNNs)在Euclidean结构数据上取得了显著的成绩突破。 最近,基于聚合-转化的图形神经网络(GNNs)逐渐在非欧clidean数据上产生强大的性能。 在本文中,我们提出了一个基于交叉关系的图变方法,可以自然地将CNN向非欧clidean领域推广,并继承CNN的出色性质,如本地过滤器、参数共享、灵活的可接收场等。 同时,它利用动态生成的聚合内核和交叉连接操作器来解决先前基于聚合-转化或其近似值的方法的缺陷。 我们的方法已经达到或匹配了在Cora、Citeseer和Pubmed引文网络数据集这三个既定的图表基准上流行的最新结果。