《pyramid Attention Network for Semantic Segmentation》

CVPR2018论文

论文链接:https://arxiv.org/pdf/1805.10180.pdf

一、背景

1、语义分割难点

(1)物体尺度不一,存在多尺度目标,小物体分割效果不好;

(2)类别较多,存在类内相异类间相似等问题,导致类别分类错误、类内不连续。

2、网络结构设计

(1)Encoder部分

扩大感受野,获得更多全局信息,如空洞卷积,但可能会导致产生网格伪像,影响小物体的预测;利用空间金字塔结构,融合多尺度的特征信息,但可能会丢失像素级别的定位信息;

(2)Decoder部分

下采样过程中丢失空间信息,所以上采样过程中利用多阶段的low-level特征辅助恢复空间位置信息。

3、作者方法

作者受SE-NET的启发,将注意力机制和空间金字塔相结合,来提取准确而密集的特征并获取像素标签。具体来说,作者提出了两个模块,特征金字塔注意力模块(FPA )和全局注意力上采样模块(GAU),FPA能够提供像素级注意力信息并通过金字塔结构来扩大感受野的范围,GAU 模块利用高层特征来指导低层特征恢复图像像素的定位。结合这两个模块,提出PAN网络。

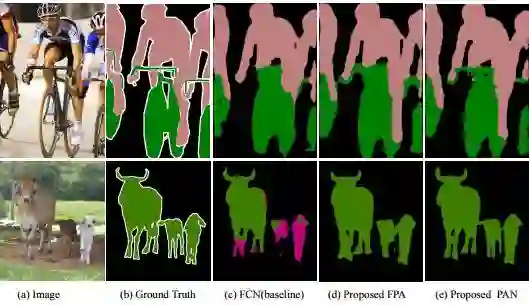

图1:VOC 数据集的可视化结果

二、网络结构

1、金字塔注意力网络 PAN

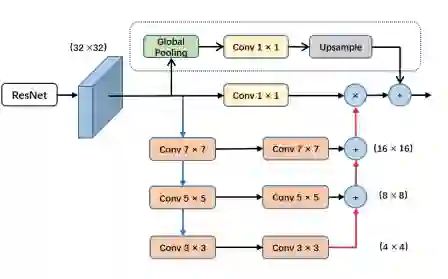

图2:金字塔注意力网络结构

2、特征金字塔注意力模块 FPA

FPA模块包括两个分支,上面分支通过global pooling获取全局上下文信息;下面分支基于金字塔结构,用不同大小的卷积核(3×3, 5×5, 7×7),提取不同尺度的上下文信息,然后逐步融合相邻尺寸的特征,接着与1×1卷积后feature map进行逐像素点成,获取像素级注意力特征;最后将两个分支特征进行逐像素相加。所以FPA 模块可以融合不同尺度的上下文信息,同时还能为高层次的特征图提供更好的像素级注意力。

图3:特征金字塔注意力模块结构

3、全局注意力上采样模块 GAU

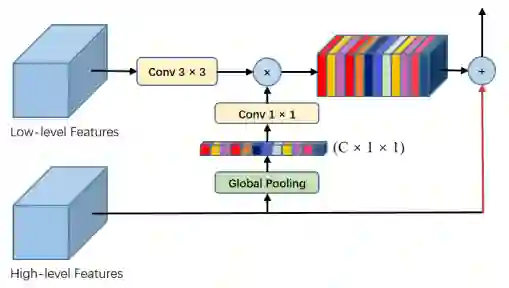

首先对低层次特征执行 3×3 的卷积操作,以减少 CNN 特征图的通道数。从高层次特征生成的全局上下文信息依次经过 1×1 卷积、批量归一化 (batch normalization) 和非线性变换操作 (nonlinearity),然后再与低层次特征相乘。最后,高层次特征与加权后的低层次特征相加并进行逐步的上采样过程。所以该模块,通过全局池化过程将全局上下文信息作为低层特征的指导,来选择类别的定位细节。

图4:全局注意力上采样模块

三、实验

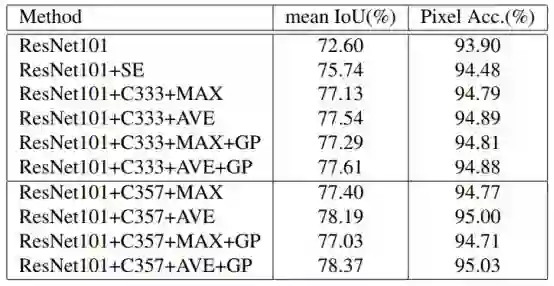

1、FPA有效性验证

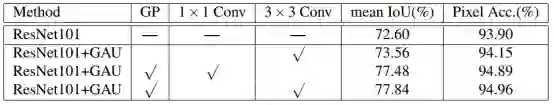

2、GAU有效性验证

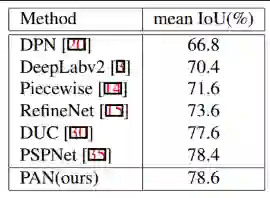

3、PASCAL VOC 2012结果

4、Cityscape实验结果