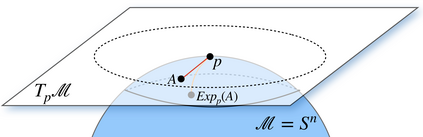

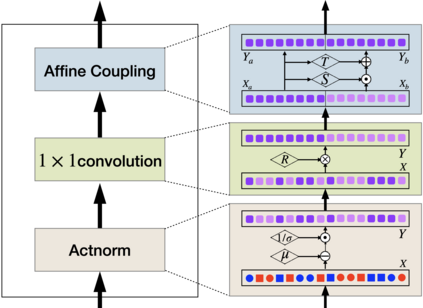

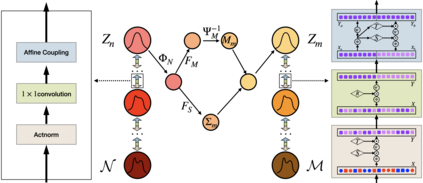

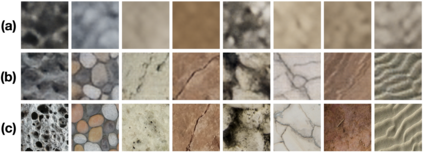

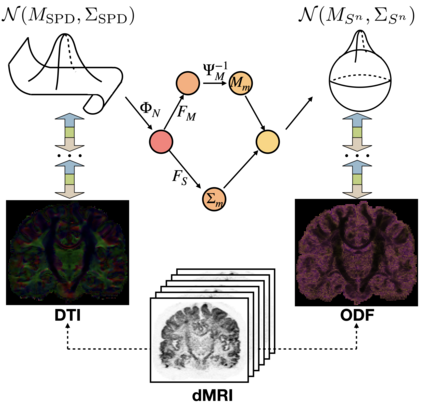

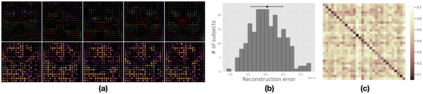

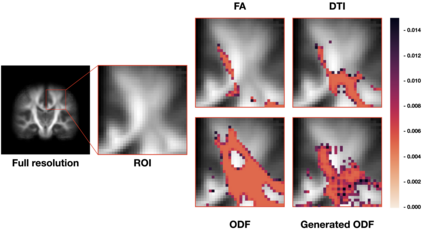

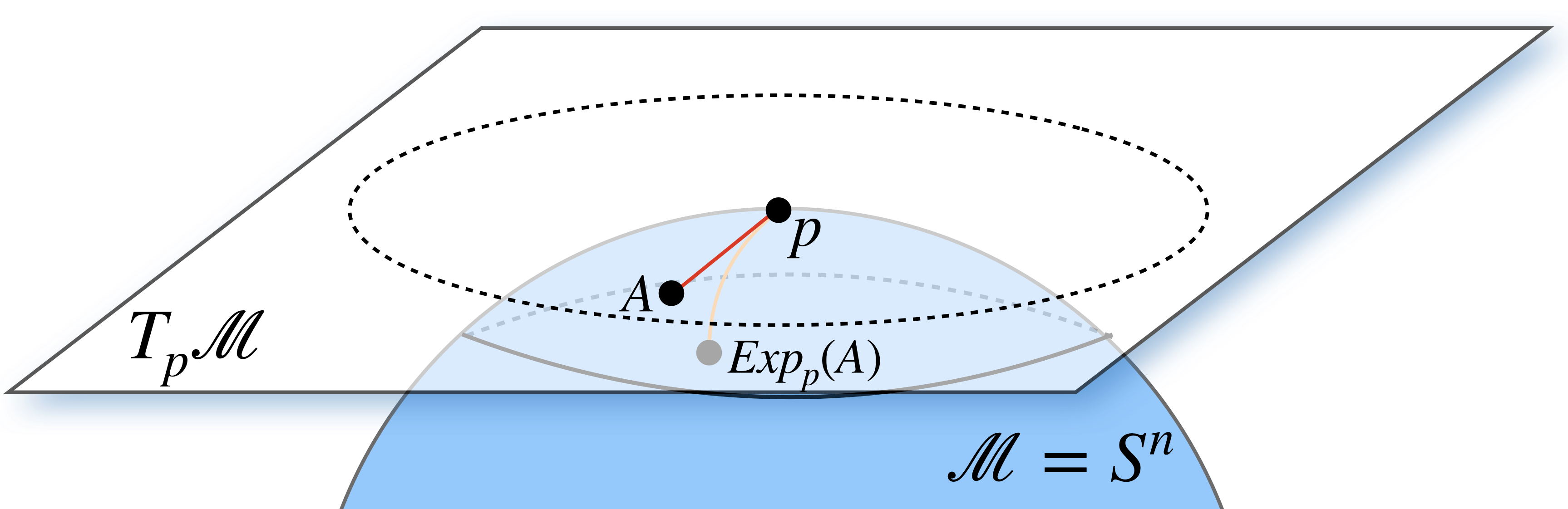

Many measurements or observations in computer vision and machine learning manifest as non-Euclidean data. While recent proposals (like spherical CNN) have extended a number of deep neural network architectures to manifold-valued data, and this has often provided strong improvements in performance, the literature on generative models for manifold data is quite sparse. Partly due to this gap, there are also no modality transfer/translation models for manifold-valued data whereas numerous such methods based on generative models are available for natural images. This paper addresses this gap, motivated by a need in brain imaging -- in doing so, we expand the operating range of certain generative models (as well as generative models for modality transfer) from natural images to images with manifold-valued measurements. Our main result is the design of a two-stream version of GLOW (flow-based invertible generative models) that can synthesize information of a field of one type of manifold-valued measurements given another. On the theoretical side, we introduce three kinds of invertible layers for manifold-valued data, which are not only analogous to their functionality in flow-based generative models (e.g., GLOW) but also preserve the key benefits (determinants of the Jacobian are easy to calculate). For experiments, on a large dataset from the Human Connectome Project (HCP), we show promising results where we can reliably and accurately reconstruct brain images of a field of orientation distribution functions (ODF) from diffusion tensor images (DTI), where the latter has a $5\times$ faster acquisition time but at the expense of worse angular resolution.

翻译:计算机视觉和机器学习中的许多测量或观测显示为非欧洲语言数据。 虽然最近的一些提议(如球形CNN)将一些深神经网络结构扩展为多值数据,这往往提供了显著的性能改进,但关于多重数据基因化模型的文献相当稀少。部分由于这一差距,对于多种价值数据也没有模式的传输/翻译模型,而基于基因化模型的多种方法则可以用于自然图像。本文讨论这一差距,其动机是大脑成像需要更快的传播,因此我们扩大了某些直径图像的操作范围(以及模式转移的基因化模型),从自然图像到多重价值测量的图像。我们的主要成果是设计了双流版GLOW(基于流动的不可忽略的基因化模型),可以将一种多种价值测量的域的信息综合在一起。在理论上,我们为多种价值数据引入三种可忽略的层(成本化数据,但不仅与基于流基基因模型的功能相近似,而且成本化模型的操作范围(以及模式的基因转换模式的基因转换模型的基因转换模型的基因转换模型的基因转换模型的基因转换模型的基因),我们也可以从一个长期的模型的模型的模型的计算结果(例如人类的模型的精确的模型的模型的模型的模型的精确的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的模型的精确性值值)的模型的模型的模型的模型的精确性值值值)的精确性值值)的模型的模型的精确性值值值(我们的精确的计算结果。