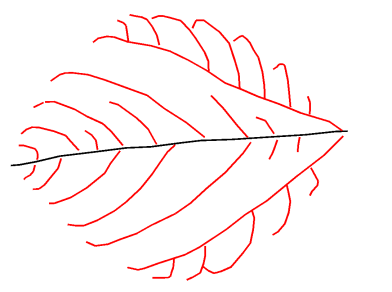

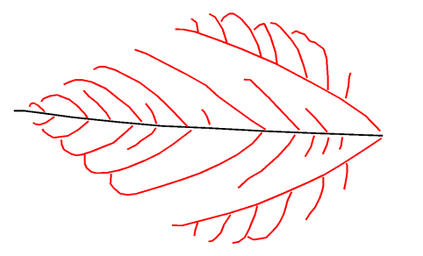

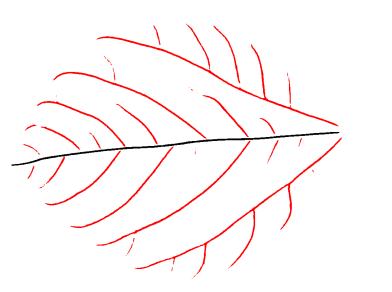

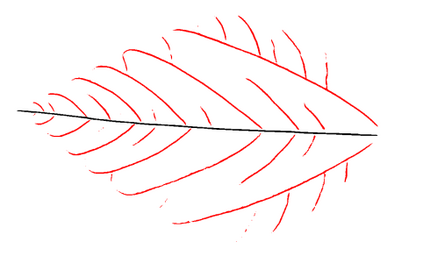

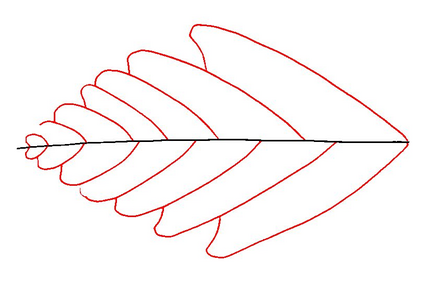

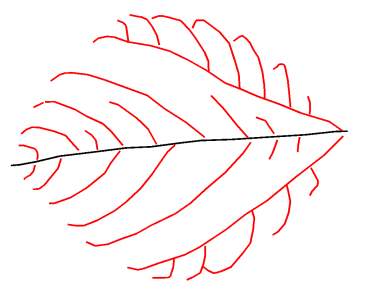

In this work, we present a novel mask guided attention (MGA) method for fine-grained patchy image classification. The key challenge of fine-grained patchy image classification lies in two folds, ultra-fine-grained inter-category variances among objects and very few data available for training. This motivates us to consider employing more useful supervision signal to train a discriminative model within limited training samples. Specifically, the proposed MGA integrates a pre-trained semantic segmentation model that produces auxiliary supervision signal, i.e., patchy attention mask, enabling a discriminative representation learning. The patchy attention mask drives the classifier to filter out the insignificant parts of images (e.g., common features between different categories), which enhances the robustness of MGA for the fine-grained patchy image classification. We verify the effectiveness of our method on three publicly available patchy image datasets. Experimental results demonstrate that our MGA method achieves superior performance on three datasets compared with the state-of-the-art methods. In addition, our ablation study shows that MGA improves the accuracy by 2.25% and 2% on the SoyCultivarVein and BtfPIS datasets, indicating its practicality towards solving the fine-grained patchy image classification.

翻译:在这项工作中,我们展示了一种新颖的蒙面引导引导关注(MGA)的细细细细切片面图像分类法(MGA) 。 细细切切片面图像分类的关键挑战在于两个折叠, 不同对象之间超细细细类间差异, 可用于培训的数据很少。 这促使我们考虑使用更有用的监督信号, 在有限的培训样本中培养一种歧视模式。 具体地说, 拟议的MGA 整合了一种预先训练的语义分割模型, 产生辅助监督信号, 即: 补丁关注面罩, 能够进行有区别的描述学习。 补面面遮面促使分类者过滤图像的无关紧要部分( 例如, 不同类别之间的共同特征) 。 这加强了微细细细切切面图像分类的稳健性。 我们验证了我们在三种公开提供的补面图像数据集上的方法的有效性。 实验结果显示, 我们的MGA方法在三个数据集上取得了优于国家艺术分类方法。 此外, 我们的缩缩图研究表明, MGA-GAGA提高了其精确度图像的准确性通过2% 和Bul- Sprespresprespal 。