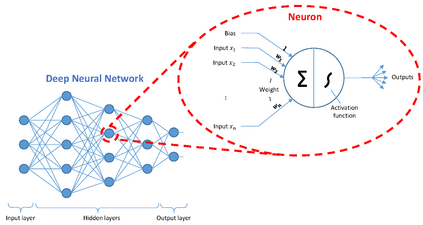

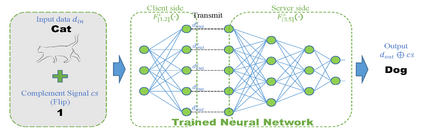

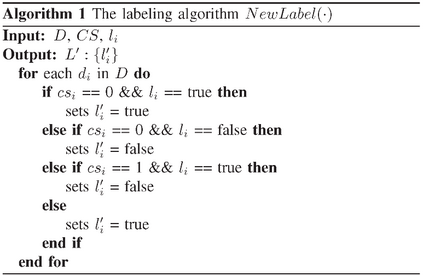

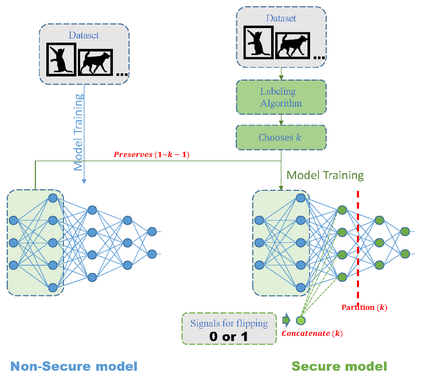

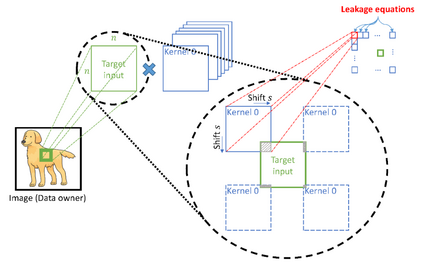

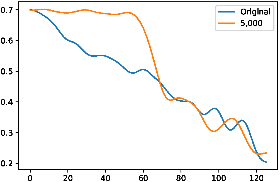

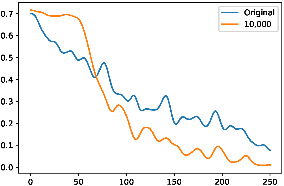

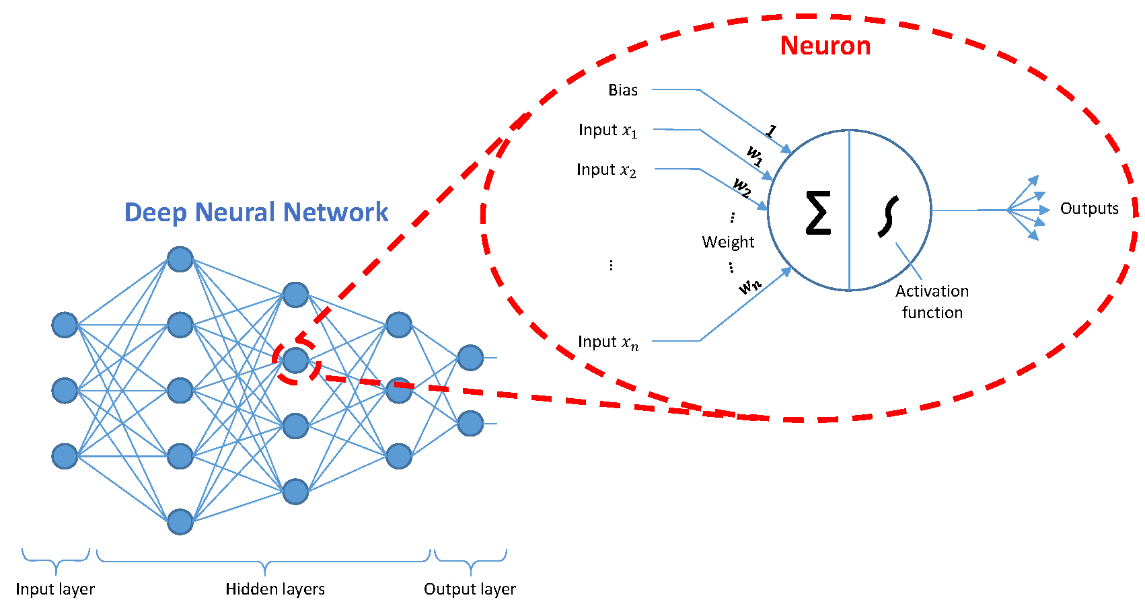

Recently, deep learning, which uses Deep Neural Networks (DNN), plays an important role in many fields. A secure neural network model with a secure training/inference scheme is indispensable to many applications. To accomplish such a task usually needs one of the entities (the customer or the service provider) to provide private information (customer's data or the model) to the other. Without a secure scheme and the mutual trust between the service providers and their customers, it will be an impossible mission. In this paper, we propose a novel privacy-preserving deep learning model and a secure training/inference scheme to protect the input, the output, and the model in the application of the neural network. We utilize the innate properties of a deep neural network to design a secure mechanism without using any complicated cryptography component. The security analysis shows our proposed scheme is secure and the experimental results also demonstrate that our method is very efficient and suitable for real applications.

翻译:最近,利用深神经网络(DNN)的深度学习在许多领域都发挥着重要作用。一个安全神经网络模型,加上安全的培训/推断计划,对于许多应用来说是必不可少的。要完成这一任务,通常需要其中一个实体(客户或服务提供者)向另一个实体(客户或服务提供者)提供私人信息(数据或模型),如果没有一个安全的计划和服务提供者与其客户之间的相互信任,那将是一个不可能的任务。在这份文件中,我们提出一个新的隐私保护深度学习模型和安全培训/推断计划,以保护输入、输出和神经网络应用模型。我们利用深神经网络的内在特性设计一个安全机制,而不使用任何复杂的密码学组成部分。安全分析表明我们提议的计划是安全的,实验结果也表明我们的方法非常高效,适合实际应用。