深度学习隐私

·

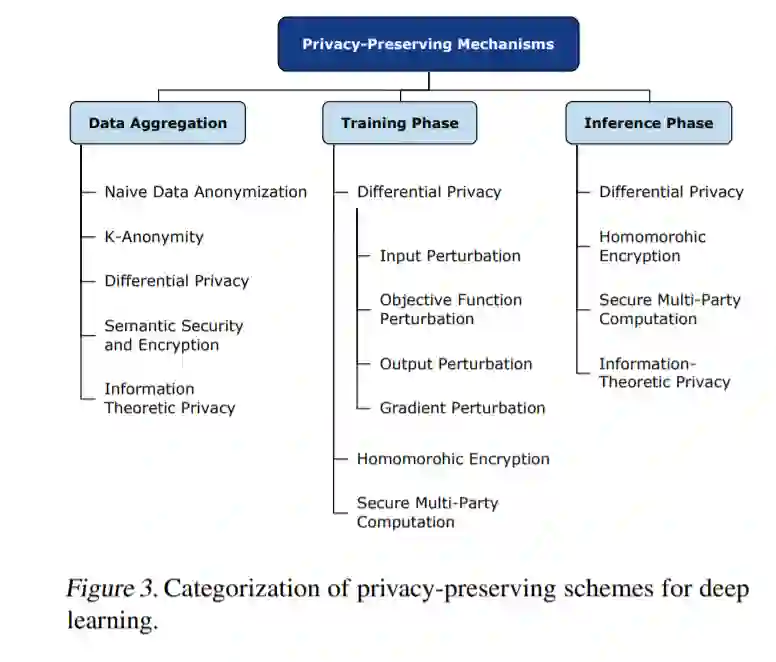

随着深度学习在视觉、推荐系统、自然语言处理等诸多领域的不断发展,深度神经网络(DNNs)在生产系统中得到了广泛的应用。大数据集的可用性和高计算能力是这些进步的主要因素。这些数据集通常是众包的,可能包含敏感信息。这造成了严重的隐私问题,因为这些数据可能被滥用或通过各种漏洞泄露。即使云提供商和通信链路是可信的,仍然存在推理攻击的威胁,攻击者可以推测用于训练的数据的属性,或者找到底层的模型架构和参数。在这次调查中,我们回顾了深度学习带来的隐私问题,以及为解决这些问题而引入的缓解技术。我们还指出,在测试时间推断隐私方面的文献存在空白,并提出未来可能的研究方向。

成为VIP会员查看完整内容

相关内容

专知会员服务

80+阅读 · 2020年3月5日