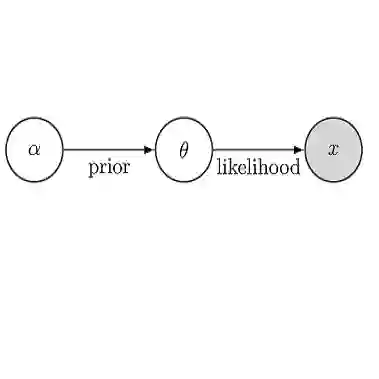

Sampling from probability distributions is an important problem in statistics and machine learning, specially in Bayesian inference when integration with respect to posterior distribution is intractable and sampling from the posterior is the only viable option for inference. In this paper, we propose Schr\"{o}dinger-F\"{o}llmer sampler (SFS), a novel approach for sampling from possibly unnormalized distributions. The proposed SFS is based on the Schr\"{o}dinger-F\"{o}llmer diffusion process on the unit interval with a time dependent drift term, which transports the degenerate distribution at time zero to the target distribution at time one. Comparing with the existing Markov chain Monte Carlo samplers that require ergodicity, no such requirement is needed for SFS. Computationally, SFS can be easily implemented using the Euler-Maruyama discretization. In theoretical analysis, we establish non-asymptotic error bounds for the sampling distribution of SFS in the Wasserstein distance under suitable conditions. We conduct numerical experiments to evaluate the performance of SFS and demonstrate that it is able to generate samples with better quality than several existing methods.

翻译:从概率分布中取样是统计和机器学习中的一个重要问题,特别是在巴伊西亚的推论中,当后座分布的集成是棘手的,从后座分布取样是唯一可行的推论选项。在本文中,我们提议Schr\"{o}dinger-F\"{o}b}llmer采样器(SFS),这是对可能未经标准化分布的采样的一种新颖方法。拟议的SFS基于 Schr\"{o}dinger-F\}{o}llmer 扩散过程,在具有时间依赖性漂移条件的单位间隔中,将下降的分布在零时迁移到目标分布。与现有的Markov 链 Monte Carlo采样器相比,不需要这种要求,SFS。计算,SFS很容易使用Euler-Maruyama离散的采样方法。在理论分析中,我们在瓦瑟斯坦距离中为SFSFS的采样分配定出非痛苦的界限。我们进行数字性实验,比评估SFSFS在适当条件下能够生成的样品的质量要好。