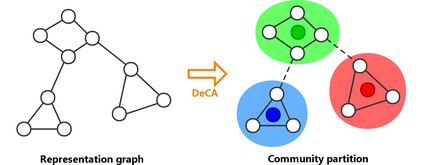

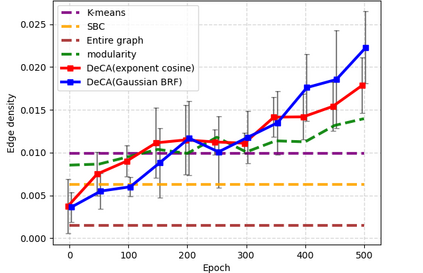

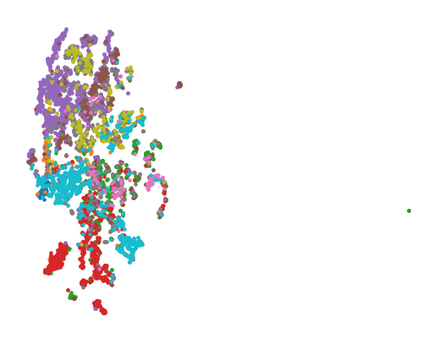

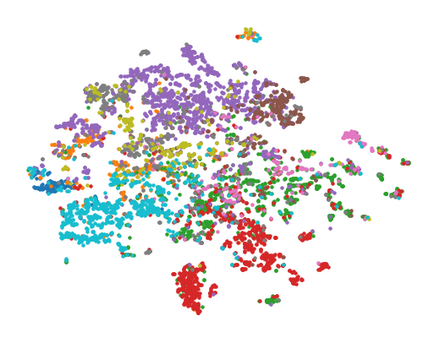

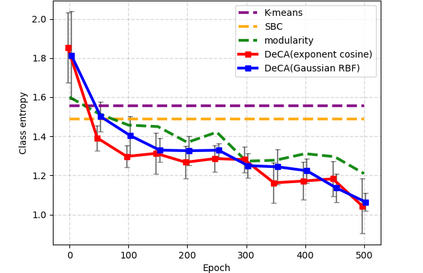

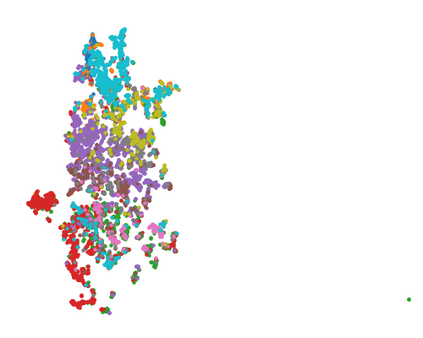

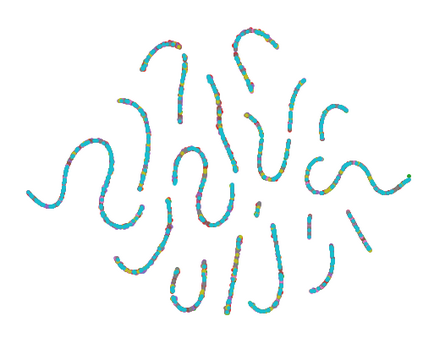

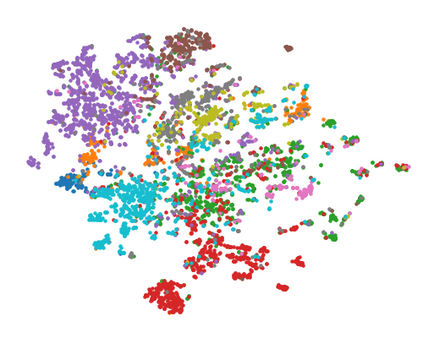

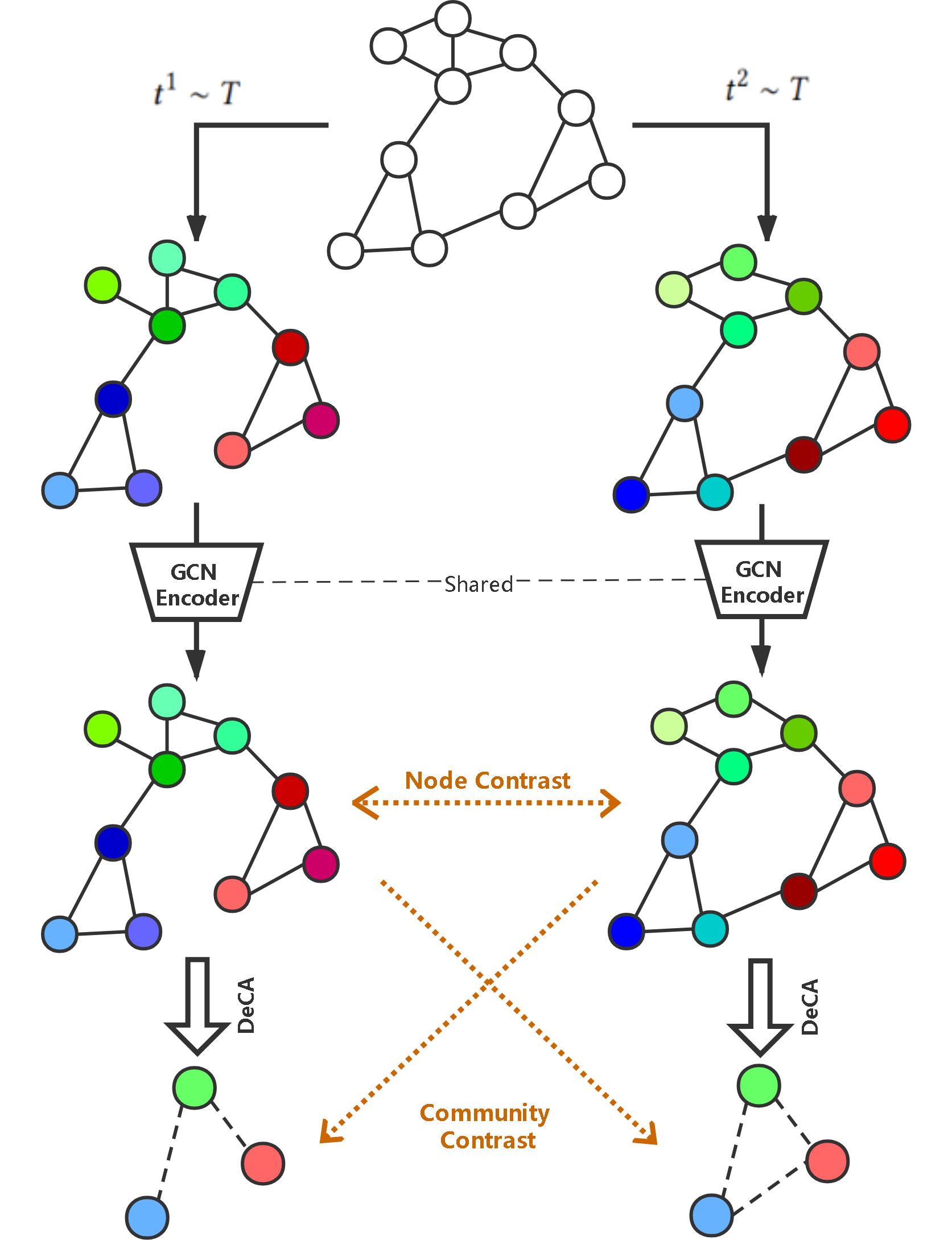

Graph representation learning is crucial for many real-world applications (e.g. social relation analysis). A fundamental problem for graph representation learning is how to effectively learn representations without human labeling, which is usually costly and time-consuming. Graph contrastive learning (GCL) addresses this problem by pulling the positive node pairs (or similar nodes) closer while pushing the negative node pairs (or dissimilar nodes) apart in the representation space. Despite the success of the existing GCL methods, they primarily sample node pairs based on the node-level proximity yet the community structures have rarely been taken into consideration. As a result, two nodes from the same community might be sampled as a negative pair. We argue that the community information should be considered to identify node pairs in the same communities, where the nodes insides are semantically similar. To address this issue, we propose a novel Graph Communal Contrastive Learning (gCooL) framework to jointly learn the community partition and learn node representations in an end-to-end fashion. Specifically, the proposed gCooL consists of two components: a Dense Community Aggregation (DeCA) algorithm for community detection and a Reweighted Self-supervised Cross-contrastive (ReSC) training scheme to utilize the community information. Additionally, the real-world graphs are complex and often consist of multiple views. In this paper, we demonstrate that the proposed gCooL can also be naturally adapted to multiplex graphs. Finally, we comprehensively evaluate the proposed gCooL on a variety of real-world graphs. The experimental results show that the gCooL outperforms the state-of-the-art methods.

翻译:对许多真实世界应用(例如社会关系分析)来说,图表代表制的学习至关重要。图形代表制学习的一个根本问题是,如何在不贴人标签的情况下有效地学习演示,这通常成本高、耗时。图表对比学习(GCL)通过拉动正节点对(或类似节点)更接近来解决这个问题,同时将代表空间中的负节点对(或不同节点)分开。尽管现有的GCL方法取得了成功,但它们主要根据节点接近度对结点对配进行抽样抽样,但社区结构却很少得到考虑。因此,来自同一社区的两节点可能会被作为负对的对比进行抽样抽样。我们主张,社区信息应该被考虑来识别同一社区中的正节点对配(或相似节点),同时将代表空间中的负节点对对(或相异节点对节点)分开。为了解决这个问题,我们建议一个新的图形对比(gCool)框架可以共同学习社区间隔段,并学习最终到的偏差点结构。具体地,拟议的 goo-L组成了两个组成部分:C-crecial-comal-comalalalalalalalalalalal-comgraphalalalalalal 。我们使用了自我演化的自我演算(C)。