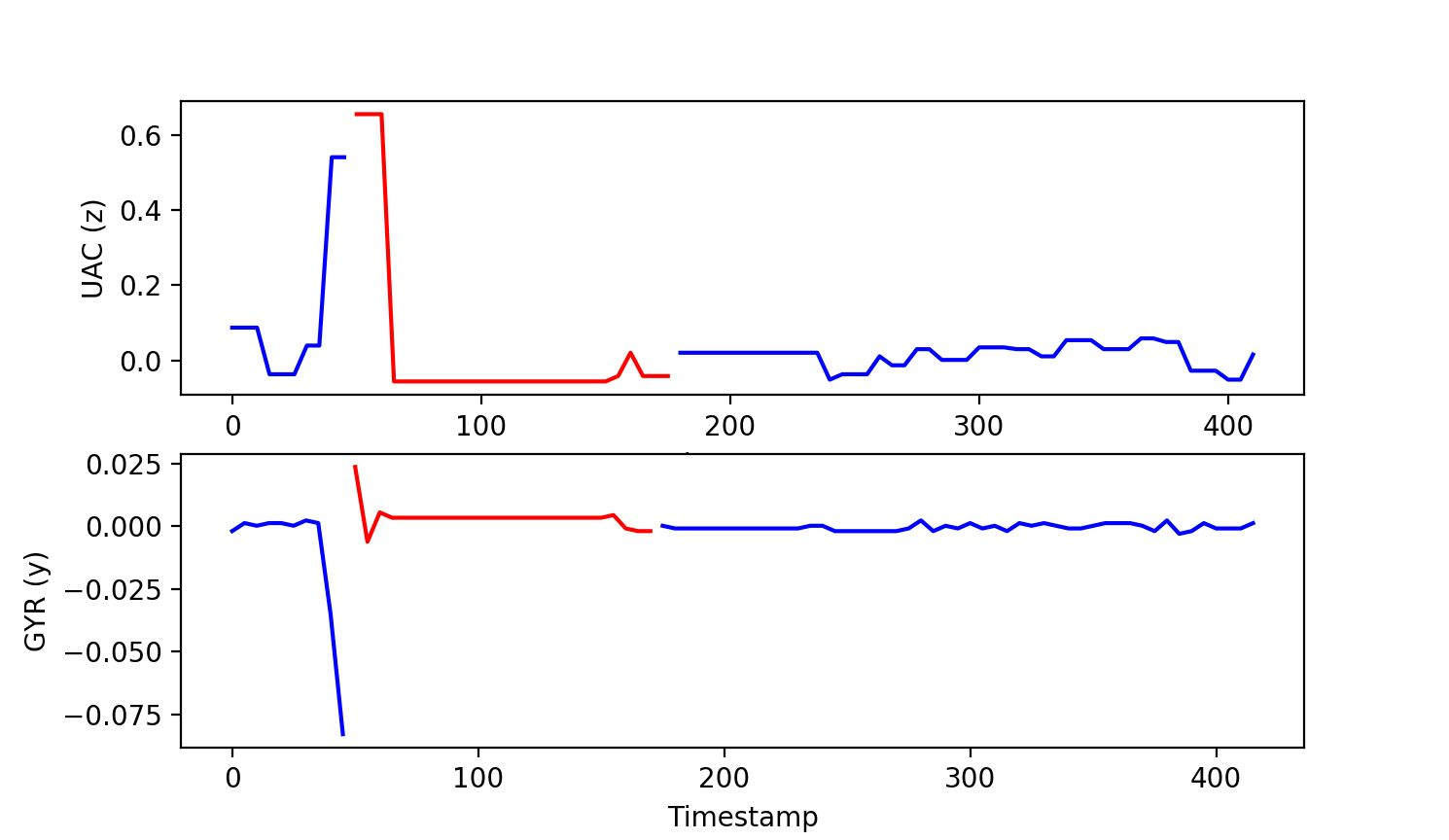

CAPTCHA systems have been widely deployed to identify and block fraudulent bot traffic. However, current solutions, such as Google's reCAPTCHA, often either (i) require additional user actions (e.g., users solving mathematical or image-based puzzles), or (ii) need to send the attestation data back to the server (e.g., user behavioral data, device fingerprints, etc.), thus raising significant privacy concerns. To address both of the above, in this paper we present ZKSENSE: the first zero knowledge proof-based bot detection system, specifically designed for mobile devices. Our approach is completely transparent to the users and does not reveal any sensitive sensor data to the service provider. To achieve this, ZKSENSE studies the mobile device's motion sensor outputs during user actions and assess their humanness locally with the use of an ML-based classifier trained by using sensor data from public sources and data collected from a small set of volunteers. We implement a proof of concept of our system as an Android service to demonstrate its feasibility and effectiveness. In our evaluation we show that ZKSENSE detects bots without degrading the end-user experience or jeopardizing their privacy, with 91% accuracy across a variety of bot scenarios, including: (i) when the device is resting (e.g., on a table), (ii) when there is artificial movement from the device's vibration, and (iii) when the device is docked on a swinging cradle.

翻译:CAPTCHA系统被广泛用于识别和阻止欺诈性机器人贩运,然而,目前的解决办法,例如谷歌的RECAPTCHA,往往(一) 需要额外的用户行动(例如用户解解数学或图像拼图),或(二) 需要将证明数据发回服务器(例如用户行为数据、设备指纹等),从而引起严重的隐私问题。为了解决上述两方面,我们在本文件中介绍了ZKSENESE:第一个以知识为根据的零知识验证机器人检测系统,专门为移动设备设计的。我们的方法对用户是完全透明的,不向服务供应商透露任何敏感的传感器数据。为此,ZKSENSE在用户行动期间对移动装置的感应输出进行了研究,并在当地使用以ML为基础的分类器进行训练,使用公共来源的感应数据以及从一小群志愿者收集的数据,评估了我们系统的概念,作为Android服务,以证明其可行性和有效性。在我们的评估中,我们显示,SKSENS的系统在储存机的轨道上运动,其准确性在不具有破坏性的轨道上,在不使机尾部变。