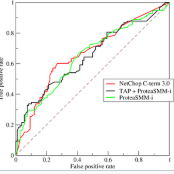

Detecting distracted driving behaviours is important to reduce millions of deaths and injuries occurring worldwide. Distracted or anomalous driving behaviours are deviations from the 'normal' driving that need to be identified correctly to alert the driver. However, these driving behaviours do not comprise of one specific type of driving style and their distribution can be different during training and testing phases of a classifier. We formulate this problem as a supervised contrastive learning approach to learn a visual representation to detect normal, and seen and unseen anomalous driving behaviours. We made a change to the standard contrastive loss function to adjust the similarity of negative pairs to aid the optimization. Normally, the (self) supervised contrastive framework contains an encoder followed by a projection head, which is omitted during testing phase as the encoding layers are considered to contain general visual representative information. However, we assert that for supervised contrastive learning task, including projection head will be beneficial. We showed our results on a Driver Anomaly Detection dataset that contains 783 minutes of video recordings of normal and anomalous driving behaviours of 31 drivers from various from top and front cameras (both depth and infrared). We also performed an extra step of fine tuning the labels in this dataset. Out of 9 video modalities combinations, our modified contrastive approach improved the ROC AUC on 7 in comparison to the baseline models (from 3.12% to 8.91% for different modalities); the remaining two models also had manual labelling. We performed statistical tests that showed evidence that our modifications perform better than the baseline contrastive models. Finally, the results showed that the fusion of depth and infrared modalities from top and front view achieved the best AUC ROC of 0.9738 and AUC PR of 0.9772.

翻译:检测分散的驾驶行为对于减少全世界数百万人伤亡非常重要。 偏差或异常的驾驶行为与“ 正常” 驱动力不同, 需要正确识别, 以提醒驱动器。 但是, 这些驱动行为并不包含一种特定类型的驾驶风格, 在分类器的培训和测试阶段, 其分布可能不同。 我们把这个问题设计成一种有监督对比的学习方法, 以学习视觉表现, 以检测正常、 可见和隐蔽的异常驾驶行为。 我们改变了标准对比性损失功能, 以调整负对子的相似性, 帮助优化。 通常, (自我) 监督的对比性框架包含一个编码符, 之后有一个投影头, 在测试阶段, 编码层被认为包含一般视觉代表信息。 然而, 我们坚持, 监督对比性学习任务, 包括投影头将是有益的。 我们展示了驱动性异常检测数据集的结果, 该数据集包含783分钟的正常和异常的视频记录记录, 将31名司机的行为从上部和前摄像头( 从深度到红外) 。 我们还进行了超前7级的统计模型进行了超前7级的对比, 。 我们还进行了了升级了比标度测试, 。