Uber开源实时多任务、多传感器融合3D目标检测方法!

点击上方“计算机视觉life”,选择“星标”

快速获得最新干货

论文地址:https://1fykyq3mdn5r21tpna3wkdyi-wpengine.netdna-ssl.com/wp-content/uploads/2019/05/Multi-Task-Multi-Sensor-Fusion-for-3D-Object-Detection.pdf

代码:https://github.com/philimat/EECS442_Project_MMF.git

来源:Uber

论文名称:Multi-Task Multi-Sensor Fusion for 3D Object Detection

原文作者:Ming Liang

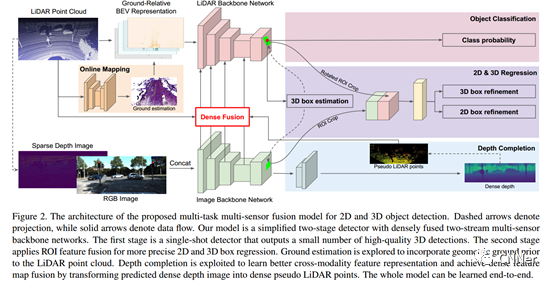

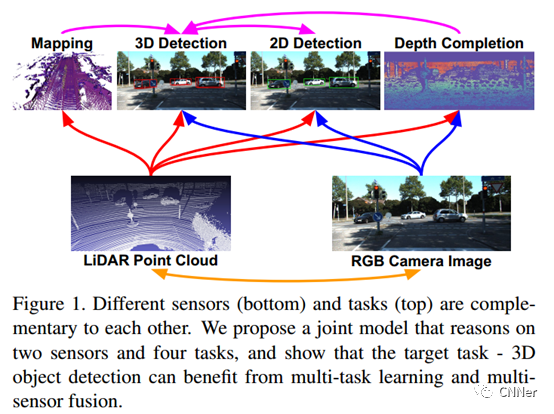

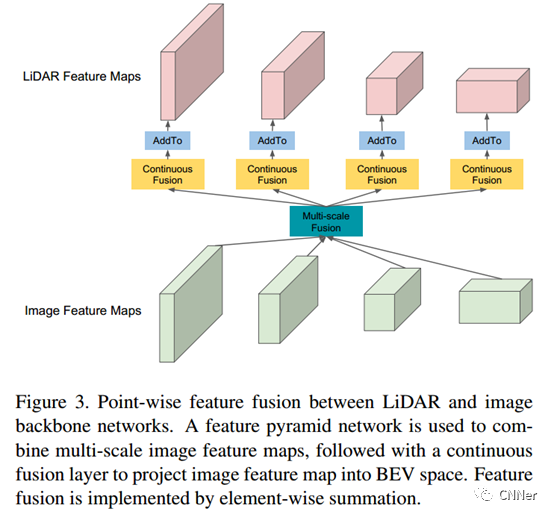

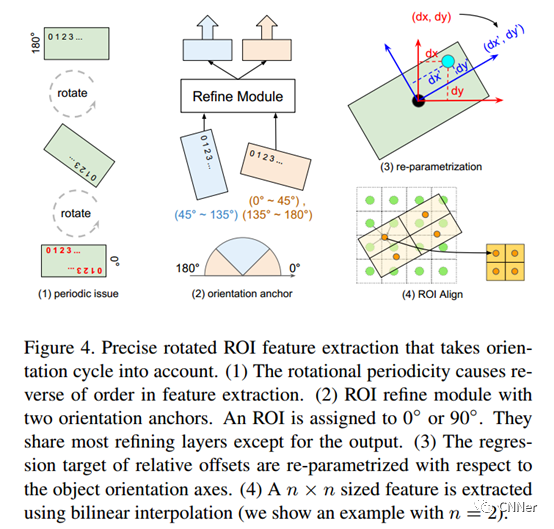

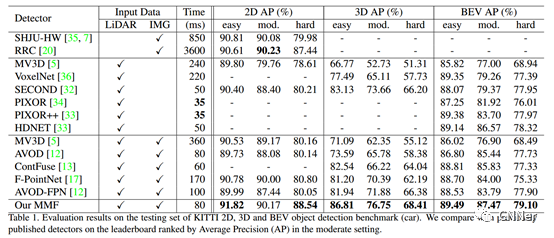

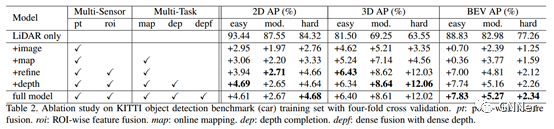

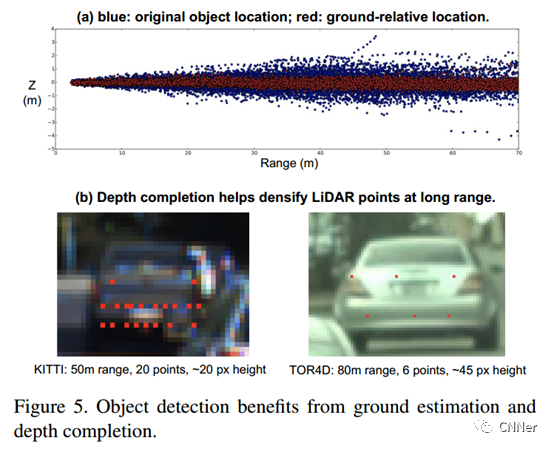

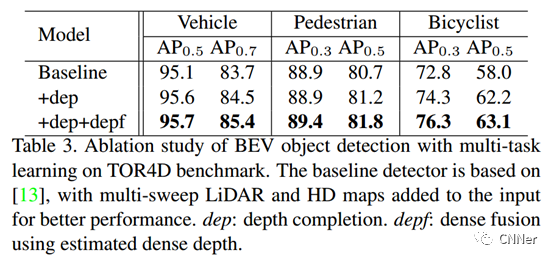

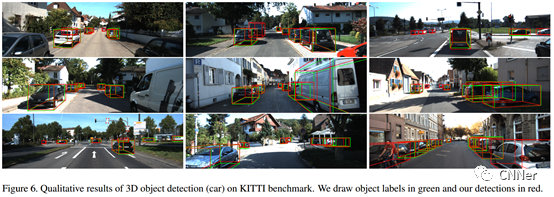

在本文中,我们提出利用多个相关任务来实现精确的多传感器3D目标检测。为了实现这一目标,我们提出了一种端到端可学习的架构,用于2D和3D目标检测以及地面估计和深度完成。实验表明,所有这些任务都是互补的,并通过融合不同层次的信息,帮助网络学习更好的表征。更重要的是,本文方法领先于KITTI基准的2D, 3D和鸟瞰目标检测,同时是实时的。

下面是论文具体框架结构以及实验结果:

声明:文章来自于网络,仅用于学习分享,版权归原作者所有,侵权请加上文微信联系删除。

从0到1学习SLAM,戳↓

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~

投稿、合作也欢迎联系:simiter@126.com

长按关注计算机视觉life

登录查看更多

相关内容

专知会员服务

32+阅读 · 2019年11月28日