AAAI 2021 | 从语义关系建模的角度进行句子语义关系匹配

动机

方法

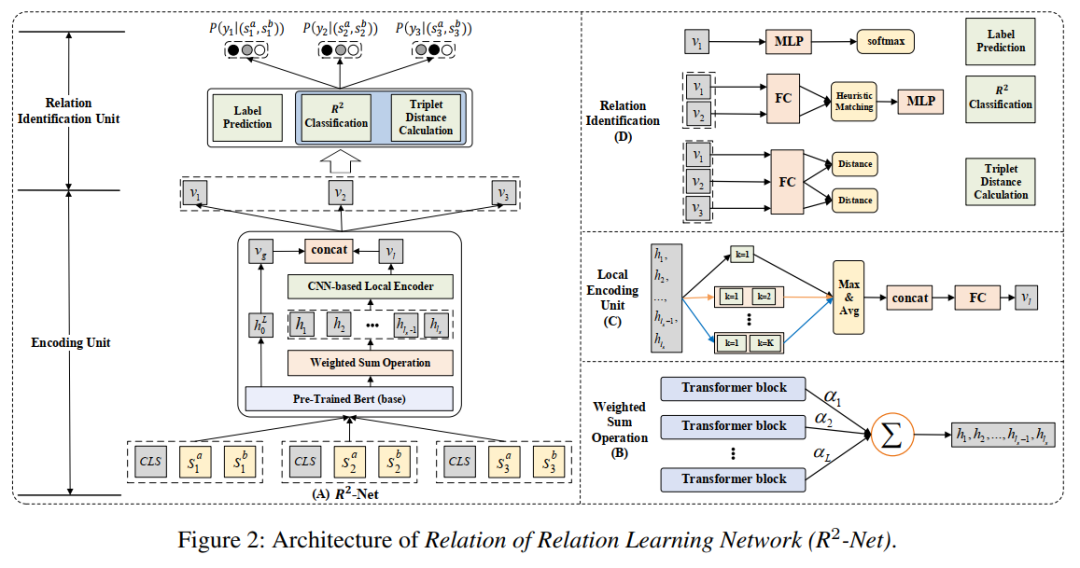

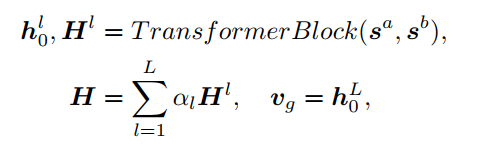

首先是模型图,整体模型分为两部分,第一部分是编码部分,第二部分是关系识别部分。

在此基础上,考虑到 BERT 关注的更多的全局信息,对一些局部特征的建模还有所欠缺,作者在这里使用了 CNN 进行局部特征抽取,通过利用不同尺寸的卷积核实现更全面的局部特征抽取:

2.2 关系识别部分

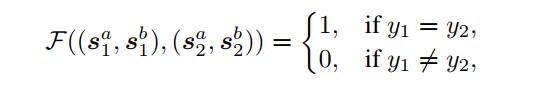

这部分是本文主要的贡献之处,本文首先设计了一个关系的关系分类任务(Relation of Relation Classification),用于判断输入的两对句子对的语义关系是否相同,是一个二分类问题,可以形式化表述为:

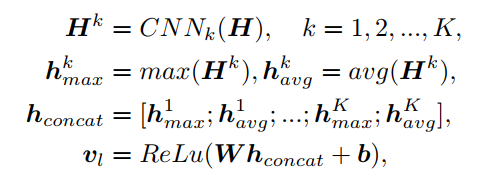

2.2.1 关系的关系分类

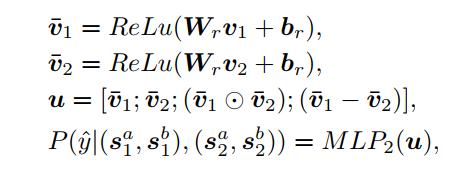

针对这个问题,本文借鉴自监督学习(self-supervised learning)的思想设计了一个关系的关系分类模块,要求输入两个句子,通过简单的启发式匹配,然后利用一个 MLP 进行二分类,模型图中的子图 D 展示了具体的结构,相关的过程可以表示为:

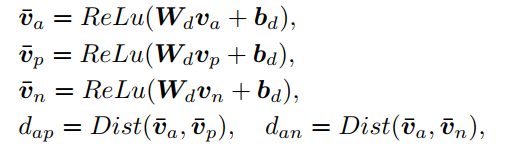

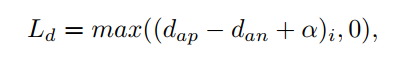

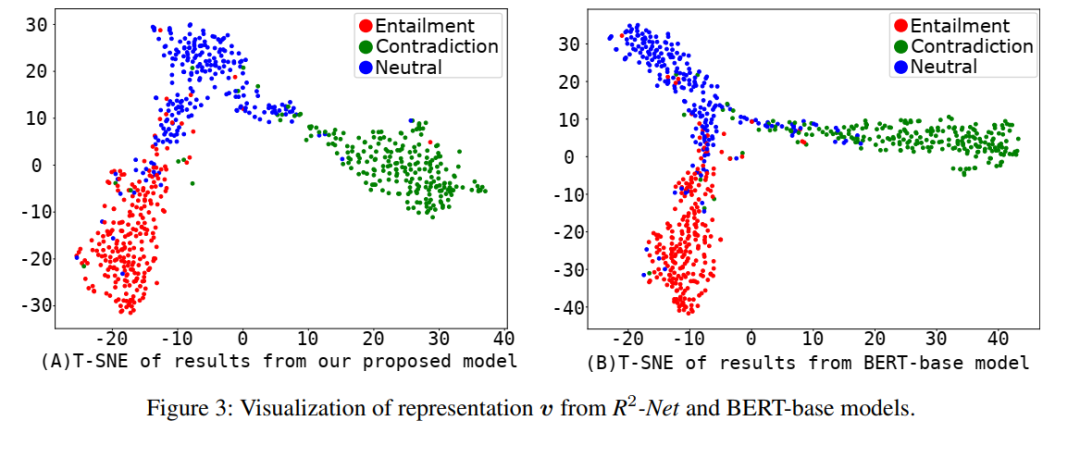

除此之外,为了进一步准确建模句子关系的关系,作者还将对比学习引入到这个模块中,由于模型最终会学习到一个句子对的语义关系表示向量,因此,作者通过对比学习要求模型学习的语义关系表示向量在表示相同语义关系的时候要近一些,在表示不同语义关系时要距离的远一些,从而使得模型能够真正学习到与关系相关的一些不变特征,充分发挥对比学习的作用。具体而言,作者首先利用 MLP 将三个不同输入的语义关系表示向量映射到同一空间,然后分别计算正例对和负例对之间的距离,用于最后的计算。

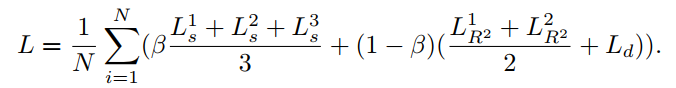

2.3 损失函数

本文的方法不仅需要预测两个句子之间的语义关系,还需要预测两个句子对之间的语义关系是否相同,而且还要去优化对比学习的目标,因此作者使用了三个函数,并通过加权的形式将其整合起来。具体如下:

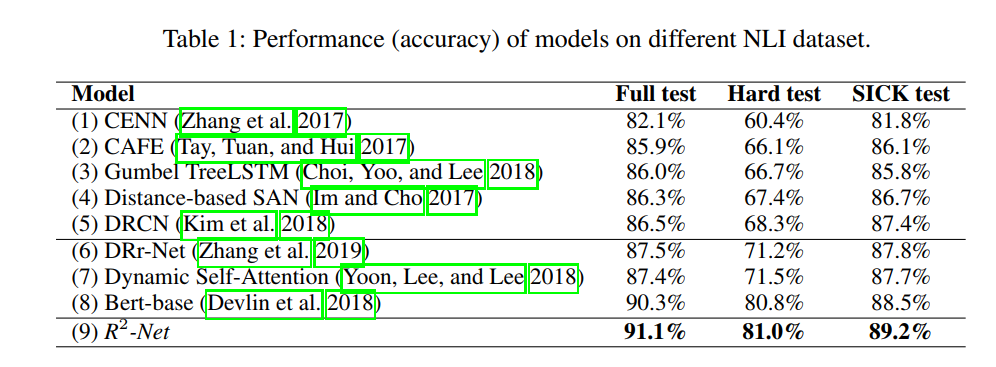

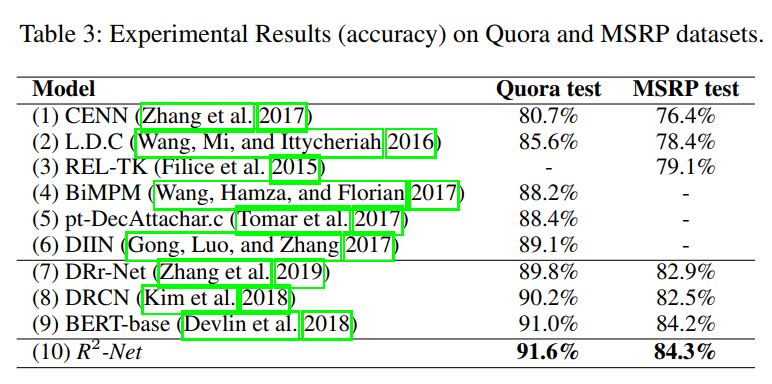

实验

总结

从本文中可以看出,方法比较简单,作者这是额外设计了一些新的利用语义关系的任务,同时利用对比学习对语义关系进行深入挖掘,从而进一步提升了语义匹配识别任务的效果,可以说是简单有效。而且本文提出的方法能够方便迁移到其他模型上,具有良好的可扩展性,是一篇很不错的文章。

更多阅读

#投 稿 通 道#

让你的论文被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

📝 来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

📬 投稿邮箱:

• 投稿邮箱:hr@paperweekly.site

• 所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。