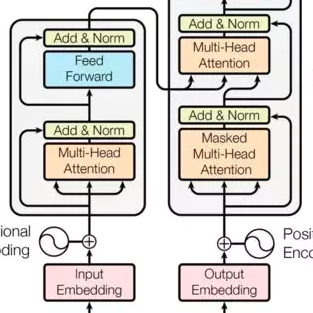

Transformer由论文《Attention is All You Need》提出,现在是谷歌云TPU推荐的参考模型。Transformer是:“首个完全抛弃RNN的recurrence,CNN的convolution,仅用attention来做特征抽取的模型。“ 本文简介了Transformer模型。

成为VIP会员查看完整内容

相关内容

Transformer是谷歌发表的论文《Attention Is All You Need》提出一种完全基于Attention的翻译架构