AI 可将大脑信号解码成语音(附论文)

到目前为止,它只能发出你听到的信息,还无法读懂你的想法或任何别的信息。

据一篇新的研究论文显示,AI算法可以帮助科学家们处理脑电波,并将其直接转换成声音。

这篇论文发表在《自然》旗下刊物《Scientific Reports》上(https://www.nature.com/articles/s41598-018-37359-z),论文的高级作者Nima Mesgarani是哥伦比亚大学的研究人员。他说:“我们的声音有助于将我们与朋友、家人和周围世界联系起来,这就是为什么因受伤或生病而失去声音的力量对人来说打击太大了。借助今天的这项研究,我们有可能恢复这种力量。我们已经证明,借助合适的技术,这些人的想法可以被任何听者解读和理解。”

每当我们听人们说话时,或者甚至想象人们说话时,我们大脑听觉皮层中的神经元就会兴奋。当我们想象人们说话时,大脑究竟如何解读杂乱的声波或如何复制这个过程还是未知数。然而神经科学家们已经表明,执行任务期间发出的脑电波模式可以拼凑起来、重建所说的单词。它促进了构建神经义肢(neuroprosthetics)这个想法,神经义肢这种装置充当脑机接口。

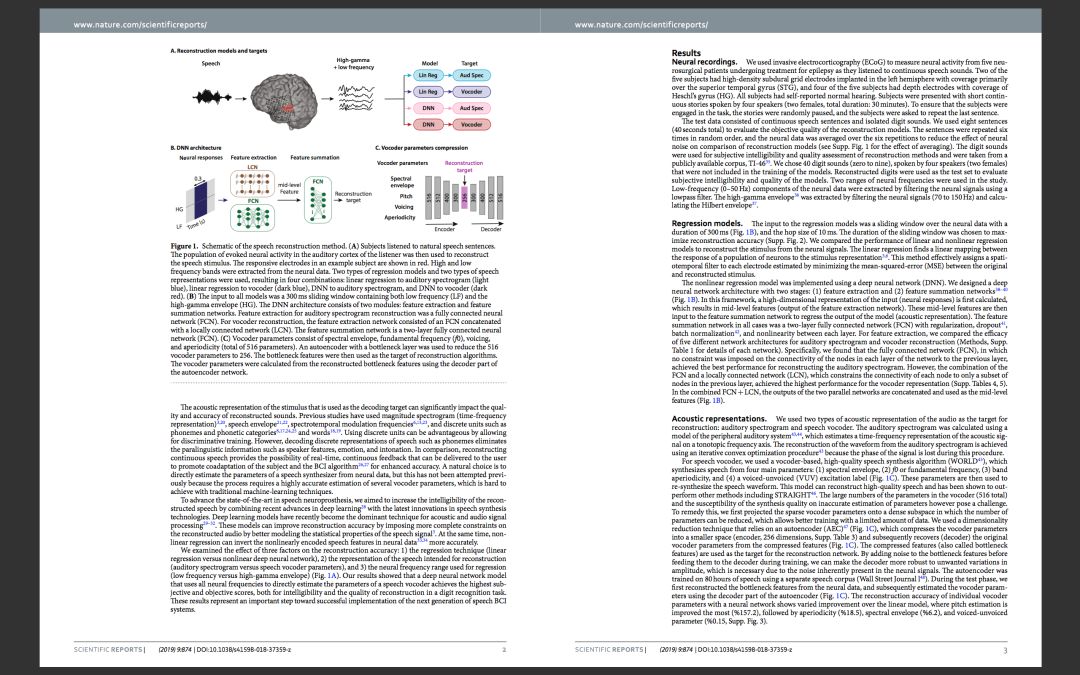

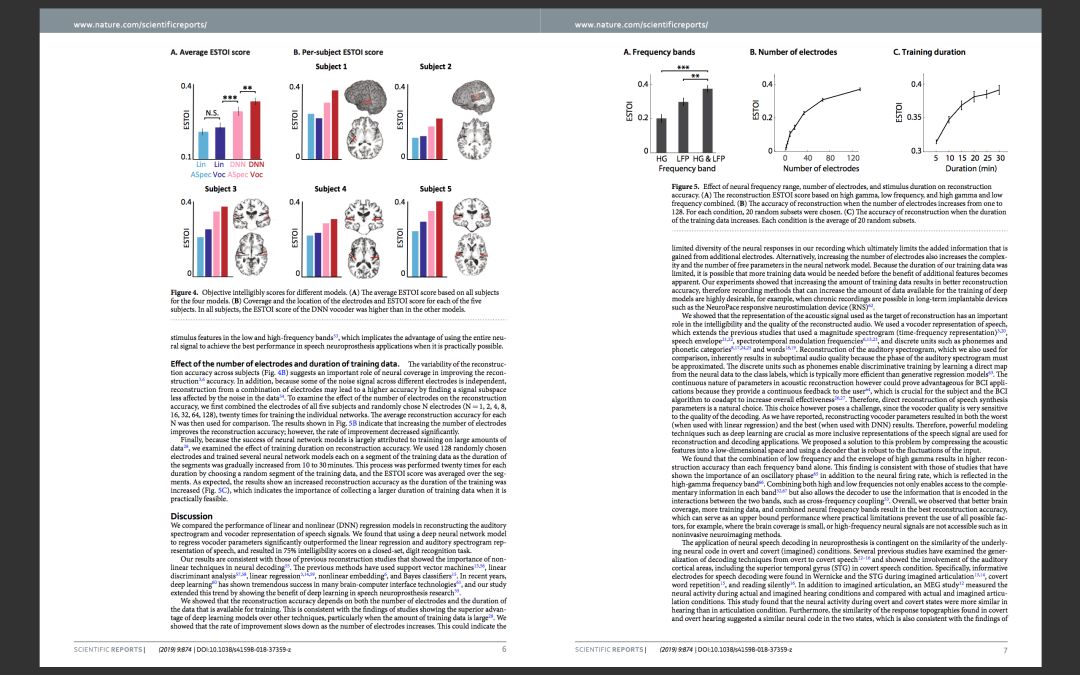

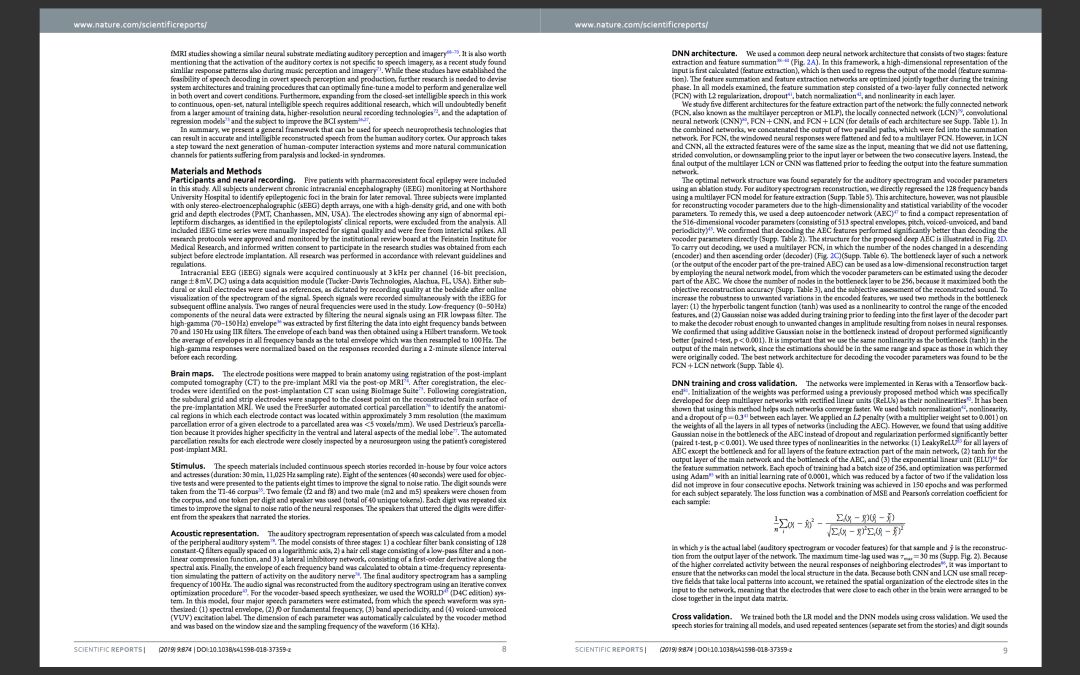

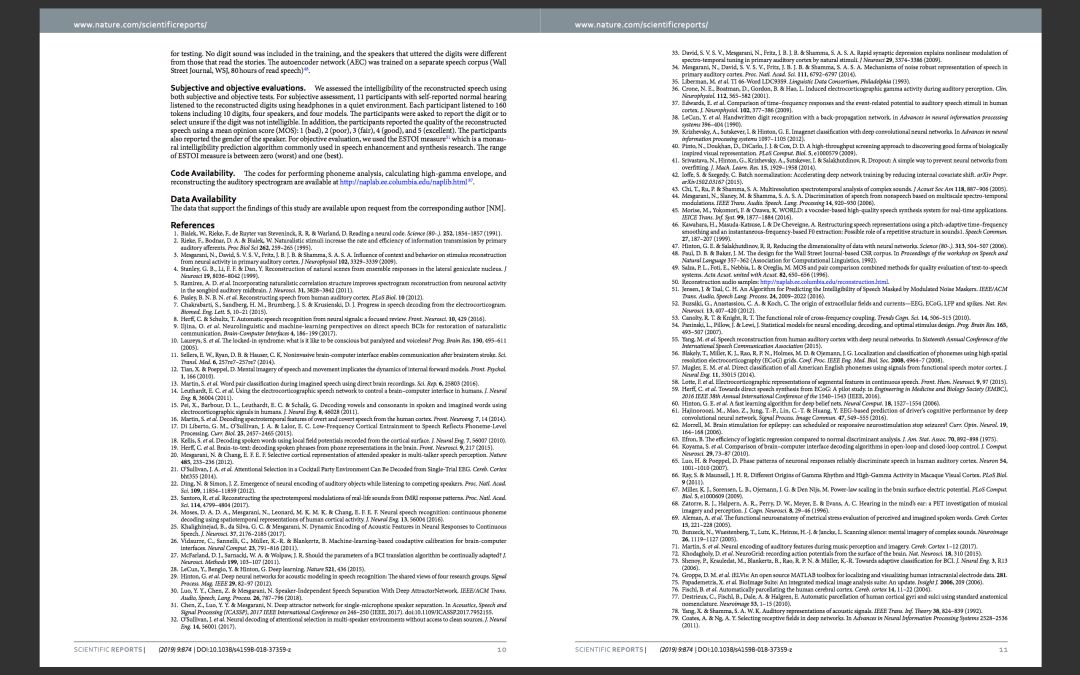

这组研究人员使用神经网络,努力推进名为听觉刺激重建的技术。首先,利用80小时长的语音录音内容来训练自动编码器,将音频信号转换成声谱图,详细描述声音中的不同频率。

接下来,研究人员将电极直接搭在五名因癫痫接受脑部手术的参与者的脑部上。他们的听力都很正常。他们都听了30分钟的短篇小说朗诵。故事随机暂停,这五名参与者被要求朗诵最后一句话,以训练音码器。音码器可以将特定的脑电波模式对应成可听见的语音。

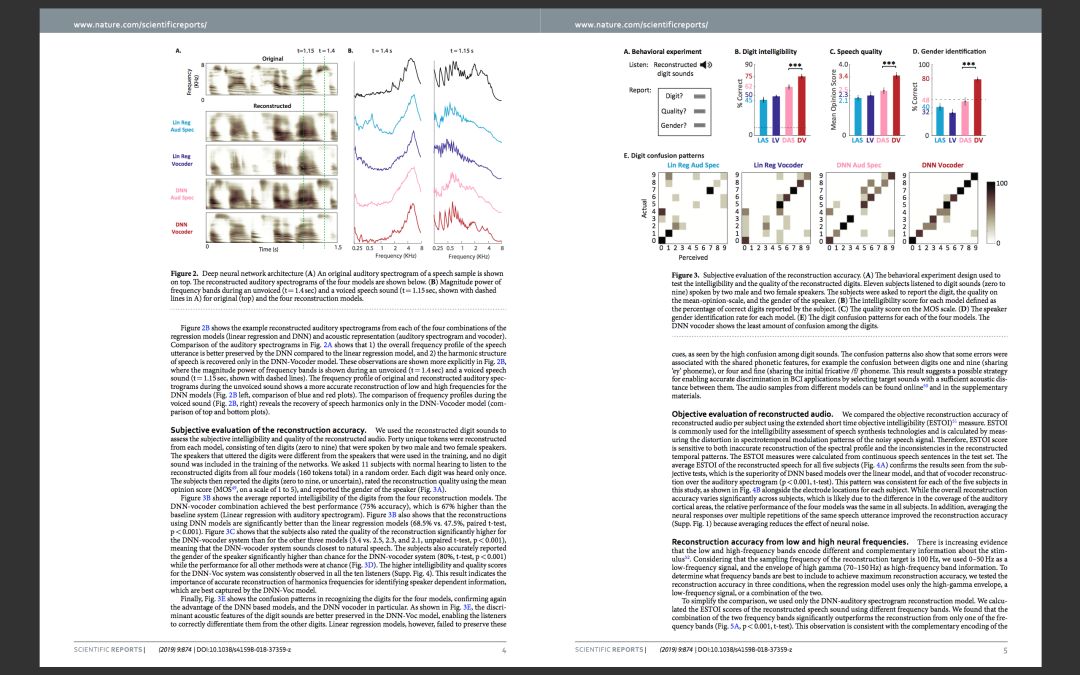

参与者听了朗诵的一连串40个个位数字(0到9)。记录下来的脑信号通过音码器以生成音频信号,然后这些样本反馈回到自动编码器进行分析,那样系统可以重复被重建的数字。

你听下面这段例子:

它有点像机器人发出来的声音,细声细气,重复的只是0到9。

Mesagarani说:“我们发现,这些人在大概75%的时间内可以理解并重复声音,这远远超过任何以往的试验。灵敏的音码器和强大的神经网络呈现了患者最初听到的声音,准确性高得出奇。”

虽然这个实验很有趣,但仍然很简单。系统只能重建听语音的参与者发出来的信号,所以这不是他们自己的想法。此外,它只是朗诵个位数字,而不是朗诵完整的数字或甚至句子。研究人员希望用更复杂的单词来测试系统,看看能否通过让人说话或想象说话来达到同样的效果。

Mesagarani说:“在这种场景下,如果测试者想‘我需要一杯水’,我们的系统可以接受这个想法生成的大脑信号,并将它们转换成合成的口头语音。这将是改变游戏规则的技术。它有望让任何丧失讲话能力(无论受伤还是生病)的人重新有机会与周围的世界联系。”

论文: