字节跳动智能创作团队研发了业内首个通用视频转场推荐方案 AutoTransition。目前,AutoTransition的衍生技术已经成功落地于字节跳动多项智能编辑业务中。

随着短视频的迅猛发展和普及,每天都有海量用户通过视频来记录和分享生活。对于缺乏专业剪辑和视频编辑知识的普通用户而言,视频的制作和剪辑却具有很高的门槛。近期,字节跳动智能创作团队研发了业内首个通用视频转场推荐方案 AutoTransition,致力于解决目前视频剪辑中存在的学习成本高,编辑效率低等问题,该项成果目前已入选计算机视觉领域顶会 ECCV2022(European Conference on Computer Vision)。

AutoTransition 兼顾灵活性与高性能,面向转场这一视频剪辑中最常使用的编辑元素,通过将转场推荐任务建模为多模态匹配和检索问题,从大量视频数据中自动学习转场匹配关系,实现了对任意视频和音频输入推荐高质量的转场效果。借助 AutoTransition,用户可以快速一键生成优质转场视频,使剪辑效率得到显著提升。相比人工剪辑和第三方软件方案,AutoTransition 有如下显著优势:

相比于基于一系列预定义的策略或随机选取的剪辑方式,能够有效地从海量数据中学习到专业的剪辑知识,并基于对视频和音频的理解推荐高质量转场。

相比于人工剪辑,模型能够在极短时间内完成推荐,显著提升编辑效率,并且推荐结果可媲美甚至超越专家剪辑的效果。

得益于优秀的扩展性,AutoTransition 可以方便地和其他的视频处理技术结合(例如视频高光提取、视频聚类和排序等),以实现更全面的视频剪辑能力,帮助视频工作者进一步提升视频编辑的效率。

目前,AutoTransition的衍生技术已经成功落地于字节跳动多项智能编辑业务中。团队表示:首个视频转场数据集和 AutoTransition 代码均已开源,以期吸引更多同行关注这一新领域,共同推动智能视频剪辑的快速发展。

![]()

论文链接:https://arxiv.org/abs/2207.13479

在介绍具体的方法之前,先来体验几组 AutoTransition 实际生成的转场效果。

可以看到转场类型能够完美匹配视频和背景音乐,视频观感自然,顺滑,整体效果不输专业人员的剪辑结果。注:打开声音播放体验更好哦!

![]()

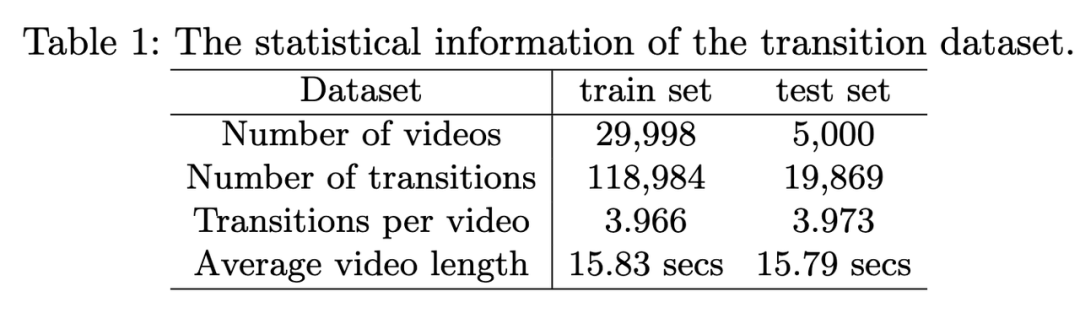

为使 AI 模型学习通用的转场添加的技巧,需要从构建高质量的视频转场数据集开始。由于人工对数据进行标注需要耗费大量的时间和精力,成本较高,为此,团队首先选择了利用网络上公开的视频转场结果。例如,剪映 app 中有大量的用户剪辑脚本和对应的成片视频,天然就包含了丰富的视频转场和相关时间信息。团队以此为基础搜集了一个大规模的训练数据,包含近 35000 条视频和近 140000 转场效果。数据集统计信息见下表。而对于不同的用户群体,还可以拓展更多的类似数据来应对不同的剪辑风格和习惯。

![]()

为了实现 “推荐” 合理的转场效果,需要给每一个转场类型打分,评判和当前视频衔接位置的契合度。为此,团队将转场推荐建模为一个多模态检索问题,通过计算输入的视频 / 音频模态和转场特效之间的特征相似度来获取不同转场类型的排序。而为了实现这一步,首先需要具有一系列能够代表各个转场类型的特征向量。

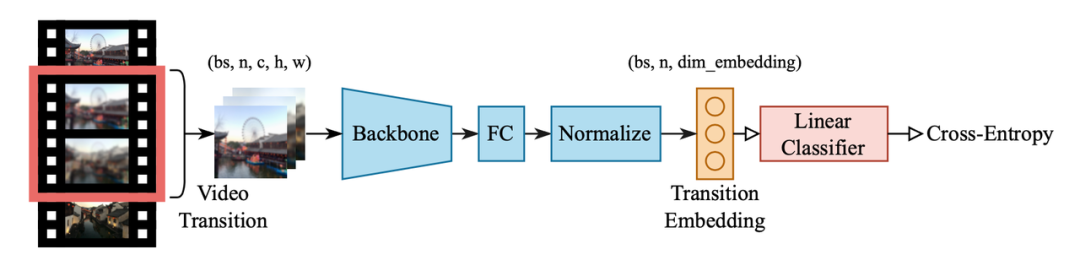

如何获取这样的一系列特征?为此团队训练了一个对视频转场进行分类的网络来实现这一点:

![]()

视频转场类别分类网络,训练 Transition Embedding 作为转场的特征表示。

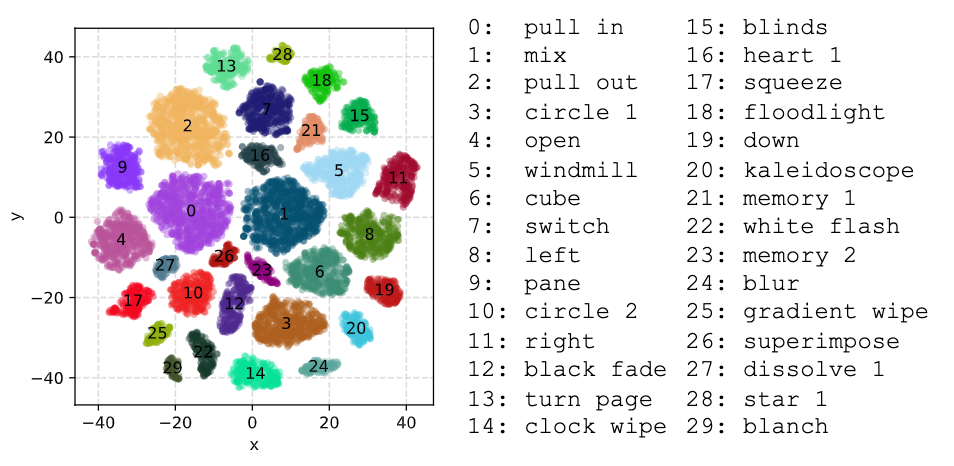

团队用线性分类器的前一层网络输出作为各转场类型的特征嵌入表示(即 Transition Embedding)。通过对这些特征进行 t-SNE 可视化,可以观察到转场之间视觉效果的差距符合特征空间的分布,即越是相似的转场,特征之间越相近,如下图中的左滑,右滑,下滑三类转场(类别标号分别为 8,11,9)彼此接近。这说明团队方法学习到的转场表示具有很好的语义特征和判别性。

![]()

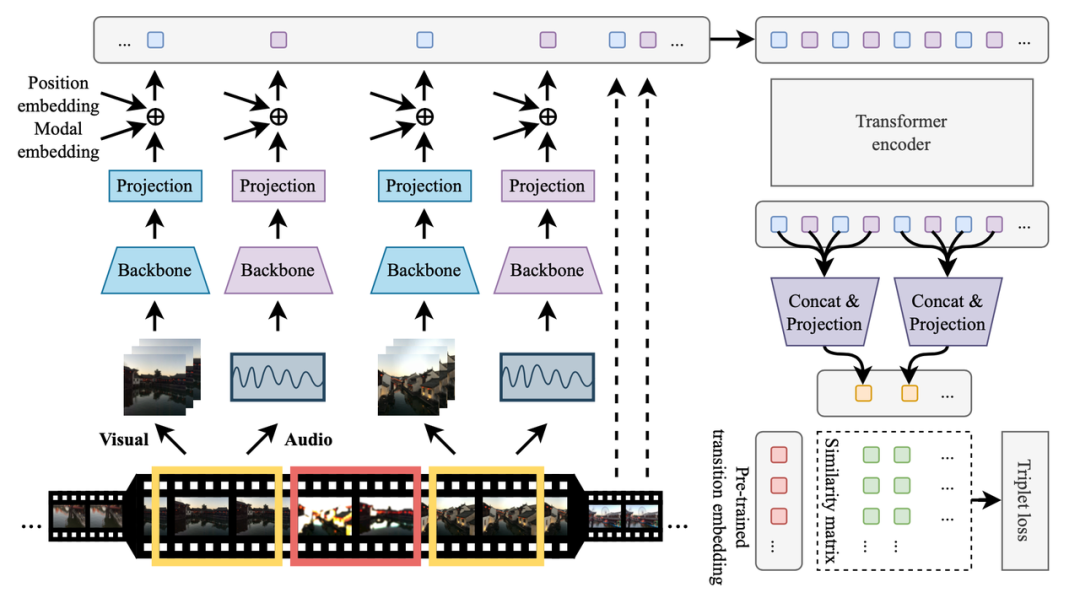

随后团队提出了一个多模态转场匹配网络,端到端完成提取原始的剪辑素材特征和对以上的学习到的转场特征的检索。视频中转场的使用需要借助对于画面内容的理解以及对于视频美感的判断,以保证画面能够丝滑地衔接起来,不显得突兀。为了让模型能够理解视频中复杂的元素,团队将视频的图像、音频两个模态,以及一整个视频中多个转场的上下文信息结合了起来,一起通过 Transformer 进行建模融合。

具体的,首先团队提取图像和音频各自的特征。采用 SlowFast 和 Harmonious Filters 作为视频和音频各自的骨干网络,也可以方便替换为其他网络提取对应特征的模型。同时,同一视频中的多个连续转场一起输入到网络中进行训练,以更好地建模各个转场间存在的相互依赖关系。

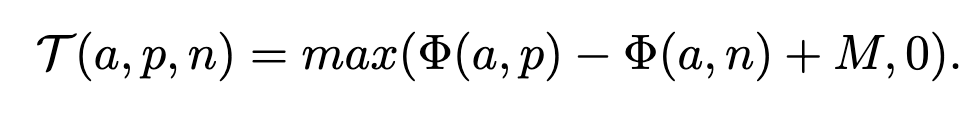

最后为了缓解对于数据中噪声的过度拟合,在训练中团队采用基于 margin 的 triplet loss 优化转场特征与视频衔接处特征之间的相似度关系。

![]()

其中,M 是预设的 margin 参数,a,p,n 分别代表当前样本,正样本和负样本对应的归一化特征。\Phi(,)是相似度度量函数,在实验中取向量内积形式。

![]()

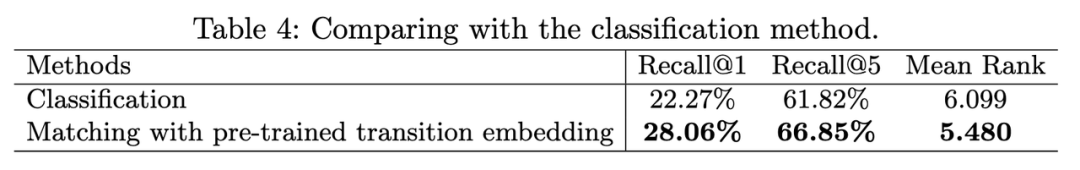

通过详尽的客观和主观评测充分验证了 AutoTransition 的有效性。下表是和这一方法和基于分类模型方法的对比,结果显示新方法在 Recall 和 Mean Rank 等指标上显著优于对比方法。

![]()

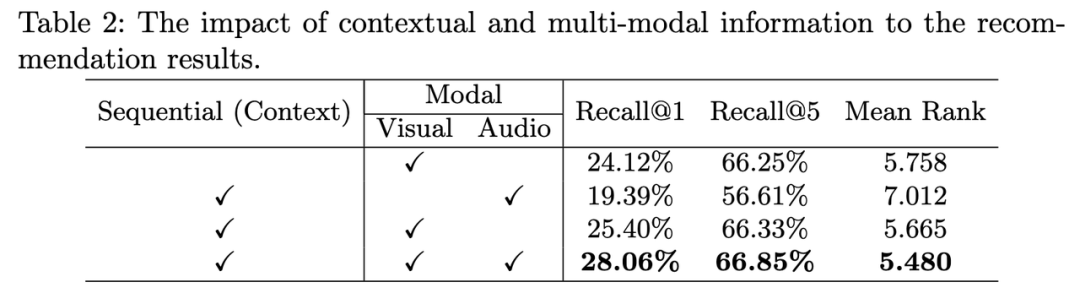

同时团队也分析了不同模态的输入对于转场推荐的效果的影响。通过下表中对比可知,对视频,音频两种模态综合建模以及考虑转场的序列上下文对结果均有助于提升推荐性能。

![]()

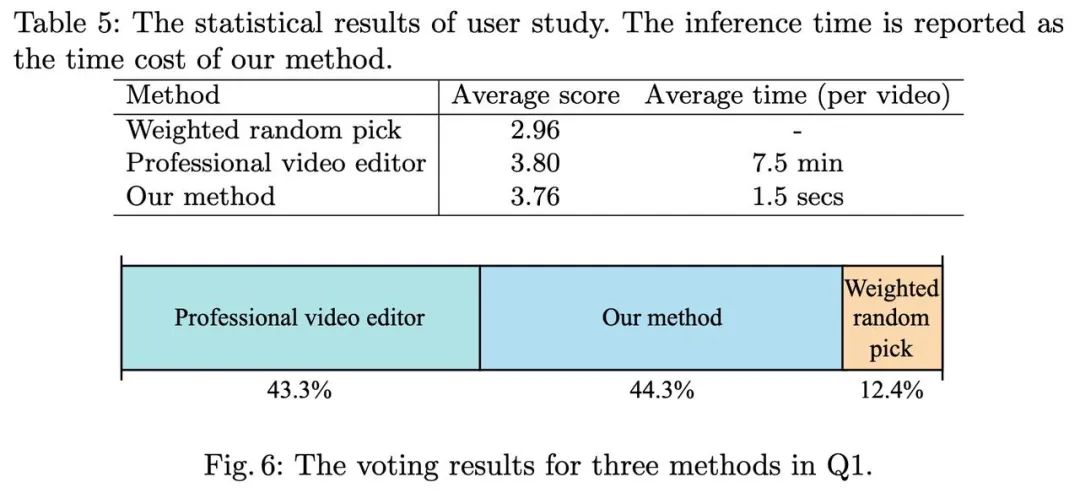

在主观评测方面,团队邀请了多位视频剪辑专家和普通用户分别对基于专家剪辑以及随机的转场结果进行对比。从下图的统计结果中可以看到,模型推荐的结果的平均得分和专家结果的得分相当,在最优结果的得票率上甚至超过专家结果。在编辑时间上,模型推荐的平均用时只需要 1.5 秒,和人工剪辑相比大大提升了编辑效率(300 倍)。以上结果充分显示了 AutoTransition 在效果和性能上的优势。

![]()

字节跳动智能创作团队提出的通用视频转场推荐方案 AutoTransition 可以高效自动生成媲美专业剪辑师的视频结果。AutoTransition 的优秀表现彰显了智能视频剪辑的巨大潜力,未来,团队准备将本方案扩展到更多的视频剪辑元素,包括但不限于视频动画,视频贴纸和裁剪变换等,同时还将尝试和其他视频处理技术结合,以实现更全面视频剪辑功能。

![]()

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:content@jiqizhixin.com