正态分布的前世今生(一)

神说,要有正态分布,就有了正态分布。

神看正态分布是好的,就让随机误差就服从了正态分布。

创世纪-数理统计

一、正态分布

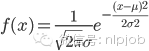

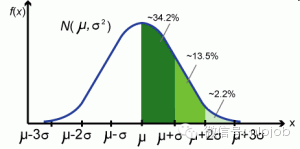

学过基础统计学的同学大都对正态分布非常熟悉。这个钟型的分布曲线不但形状优雅,其密度函数写成数学表达式

也非常具有数学的美感。其标准化后的概率密度函数

更加的简洁漂亮,两个最重要的数学常量 $ \pi, e$ 都出现在了公式之中。在我个人的审美之中,它也属于 top-N 的最美丽的数学公式之一,如果有人问我数理统计领域哪个公式最能让人感觉到上帝的存在,那我一定投正态分布的票。因为这个分布戴着神秘的面纱,在自然界中 无处不在,让你在纷繁芜杂的数据背后看到隐隐的秩序。

正态分布又通常被称为高斯分布,在科学领域,冠名权那是一个很高

的荣誉。去过德国的兄弟们还会发现,德国的钢镚和10马克的纸币上都留有高斯的头像和正态密度曲线。正态分布被冠名高斯分布,我们也容易认为是高斯发现了正态分布,其实不然,不过高斯对于正态分布的历史地位的确立是起到了决定性的作用。

正态曲线虽然看上去很美,却不是一拍脑袋就能想到的。我在本科学习数理统计的时候,课本一上来介绍正态分布就给出密度分布函数,却从来不说明这个分 布函数是通过什么原理推导出来的。所以我一直搞不明白数学家当年是怎么找到这个概率分布曲线的,又是怎么发现误差服从这个奇妙的分布的。直到我读研究生的 时候我的导师给我介绍了陈希儒院士的《数理统计简史》这本书,看了之后才了解了正态分布曲线从发现到被人们重视进而广泛应用,也是经过了几百年的历史。

正态分布的这段历史是很精彩的,我们通过讲几个故事来揭开她的神秘面纱。

二、邂逅,正态曲线的首次发现

第一个故事和概率论的发展密切相关,主角是棣莫弗(De Moivre) 和拉普拉斯(Laplace)。

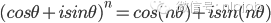

拉普拉斯是个大科学家,被称为法国的牛顿;棣莫弗名气可能不算很大,不过大家应该应该都熟悉这个名字,因为我们在高中数学学复数的时候都学过棣莫弗定理

古典概率论发源于赌博,惠更斯、帕斯卡、费马、贝努力都是古典概率的奠基人,他们那会研究的概率问题大都来自赌桌上,最早的概率论问题是赌徒梅累在 1654年向帕斯卡提出的如何分赌金的问题。统计学中的总体均值之所以被称为期望(Expectation), 就是源自惠更斯、帕斯卡这些人研究平均情况下一个赌徒在赌桌上可以期望自己赢得多少钱。

有一天一个哥们,也许是个赌徒,向棣莫弗提了一个和赌博相关

的一个问题:A,B 两人在赌场里赌博,A,B各自的获胜概率是$p, q=1-p$,赌 n 局,若 A 赢的局数 $X > np$, 则 A 付给赌场 $X-np$ 元,否则B 付给赌场 $np-X$ 元。问赌场挣钱的期望值是多少。

问题并不复杂, 本质上是一个二项分布,最后求出的理论结果是

其中 $b(n,p,i) = \binom{n}{i}p^iq^{n-i}$ 是常见的二项概率。但是对具体的 $n$, 要把这个理论结果实际计算出数值结果可不容易, 因为其中的二项公式中有组合数.这就驱动 De Moivre寻找近似计算的方法计算。

与此相关联的另一个问题,是遵从二项分布的随机变量 $X \sim B(n,p)$, 求X 落在二项分布中心点一定范围的概率 $P_d = P(|X - np| \le d)$

对于 p=1/2 的情形, 棣莫弗 做了一些计算并得到了一些近似结果,但是还不够漂亮,幸运的是 棣莫弗 和 Stirling 处在同一个时代, 而且二人之间有联系,Stirling 公式是在数学分析中必学的一个重要公式(事实上Stirling 公式的形式其实是棣莫弗最先发现的,但是 Stirling 改进了公式)

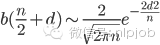

1733 年,棣莫弗很快利用 Stirling 公式进行计算并取得了重要的进展。考虑 n 是偶数的情形,令二项概率

通过 Stirling 公式做一些简单的计算容易得到,

于是有

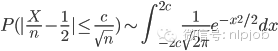

使用上式的结果,并在二项概率累加求和的过程中近似的使用定积分代替求和,很容易就能得到

看,正态分布的密度函数的形式在积分公式中出现了!这也就是我们在数理统计课本上学到的二项分布的极限分布是正态分布。

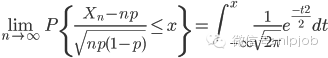

以上只是讨论了 $p=1/2$ 的情形, 棣莫弗也对 $p \ne 1/2$做了一些计算,后来拉普拉斯对 $p \ne 1/2$ 的情况做了更多的分析,并把二项分布的正态近似推广到了任意 $p$ 的情况。这是第一次正态密度函数被数学家勾画出来,而且是以二项分布的极限分布的形式被推导出来的。熟悉基础概率统计的同学们都知道这个结果其实叫棣莫弗-拉普拉斯中心极限定理。

[De Moivre-Laplace 中心极限定理]

设随机变量 $X_n (n=1,2,\cdots)$ 服从参数为 $p$ 的二项分布,则对任意的 $x$, 恒有

我们在大学学习数理统计的时候,学习的过程都是先学习了正态分布,然后才学习中心极限定理。而学习到正态分布的时候,直接就描述了其概率密度的数学 形式,虽然数学上很漂亮,但是当时很容易困惑数学家们是如何凭空就找到这个分布的。读了陈希孺的《数理统计学简史》之后,我才明白正态分布的密度形式首次 发现是在棣莫弗-拉普拉斯的中心极限定理中。数学家研究数学问题的进程很少是按照我们数学课本的安排顺序推进的,现代的数学课本都是按照数学内在的逻辑进 行组织编排的,虽然逻辑结构上严谨优美,却把数学问题研究的历史痕迹抹得一干二净。DNA 双螺旋结构的发现者之一 Waston 在他的名著《DNA 双螺旋》序言中说:“科学的发现很少会像门外汉所想象的一样,按照直接了当合乎逻辑的方式进行的。”

棣莫弗 出他的发现后40年(大约是 1770), 拉普拉斯建立了中心极限定理较一般的形式,中心极限定理后续又被其它数学家们推广到了其它任意分布的情形,而不限于二项分布。后续的统计学家发现,一系列 的重要统计量,在样本量 N 趋于无穷的时候, 其极限分布都有正态的形式, 这构成了数理统计学中大样本理论的基础。

棣莫弗在二项分布的计算中瞥见了正态曲线的模样,不过他并没有能展现这个曲线的美妙之处。棣莫弗的这个工作当时并没有引起人们足够的重视,原因在于 棣莫弗 不是个统计学家,从未从统计学的角度去考虑其工作的意义。正态分布(当时也没有被命名为正态分布) 在当时也只是以极限分布的形式出现,并没有在统计学,尤其是误差分析中发挥作用。这也就是正态分布最终没有被冠名 棣莫弗分布的重要原因。那高斯做了啥工作导致统计学家把正态分布的这顶桂冠戴在了他的头上呢?这先得从最小二乘法的发展说起。下回分解:-)

注:本文为旧文重发,关注AINLP公众号,后台回复"rickjin"获取正态分布前世今生全文索引。