小样本也能增量学习?CVPR 2020 Oral最新干货:小样本类增量学习

点击上方“CVer”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文作者:洪晓鹏

https://zhuanlan.zhihu.com/p/136823964

本文已由原作者授权,不得擅自二次转载

本文首次从计算的角度关注了小样本深度类增量学习问题并提出了相应的解决方案,已被CVPR 2020接收为Oral展示文章。

文章作者:陶小语、洪晓鹏、常新远、董松林、魏星、龚怡宏

文章简介:

实现对新类别进行持续增量学习的能力对于现实世界人工智能系统的发展至关重要。目前的类增量学习(CIL,class-incremental learning)研究往往提供了较为充足的带标签新类别样本,而在诸如智能相册等实际应用中,用户可能只有兴趣提供极少量有标签的新类别样本。因此研究小样本深度类增量学习迫在眉睫。在本文中,我们着重研究这个面向实际应用但极具挑战性的小样本类增量连续学习(FSCIL,few-shot class-incremental learning)问题。FSCIL要求CNN模型从少量的带标签样本中增量式地学习新的类别,而不会忘记先前学习的样本。

传统的深度类增量学习研究通常使用知识蒸馏(knowledge distillation)方法。它们通常存储一部分旧类别的样本,通过蒸馏损失函数来维持分类模型在旧类别样本上的输出。尽管在某种程度上有效,这种基于蒸馏损失的方法也存在一些问题。首先,其面临严重的类别不平衡问题,即分类器输出会严重偏置(baised)到拥有较多样本的类别上;其次,它们往往面临在新旧类之间进行性能折衷(trade-off)的困境。由于在极少样本情况下,需要认为增大学习率以及增强新类损失的梯度才能使新类别的学习变得有意义,而一旦这样做,对旧类别知识的维持就会更加困难。因此这种性能折衷困境在小样本类增量环境下会更为严重。

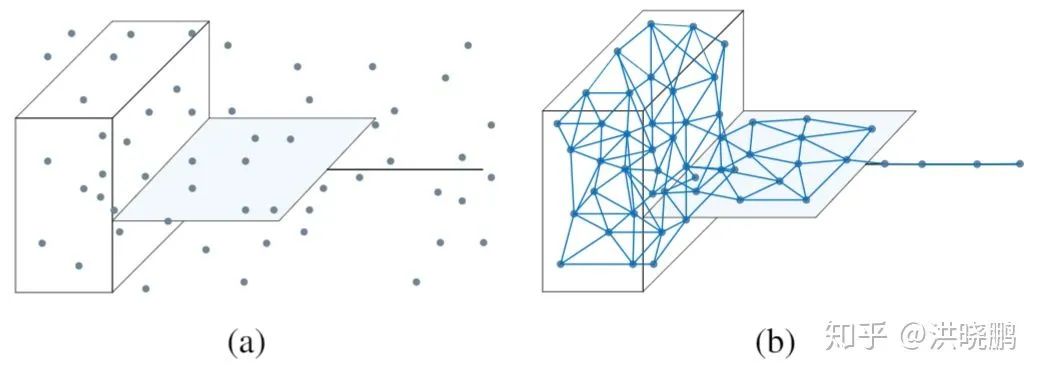

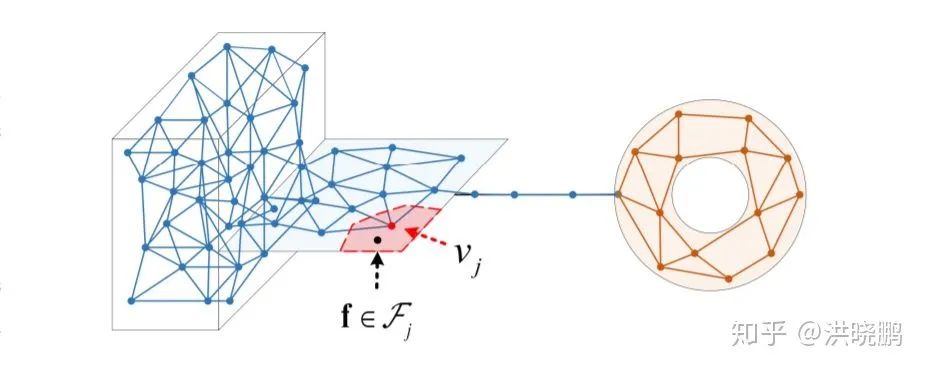

为此,我们尝试从一种新的认知启发的角度来解决小样本类增量学习问题。近期的认知学研究表明,物体的拓扑对维持已学知识的记忆非常重要。一旦记忆的拓扑特性发生改变,会导致人类对已见过物体视觉刺激的再认出现大幅退化,这直接导致了灾难性遗忘(catastrophic forgetting)的产生。为此,我们认为,保持住旧知识空间的拓扑结构,是解决灾难性遗忘的关键。因此,我们提出使用神经气体(NG,neural gas)网络来对已学知识进行抽取和表示。该网络可以学习并保留由不同类别形成的特征流形的拓扑。在此基础上,我们提出了拓扑保持知识增长器(TOPIC,TOPology-Preserving Knowledge InCrementer)框架。TOPIC框架一方面通过稳定神经气体网络NG的拓扑结构缓解了旧知识的遗忘,另一方面通过使NG成长并适应新的训练样本来改进在少量新类别样本上的表征学习。

神经气体网络可以被定义为一个无向图

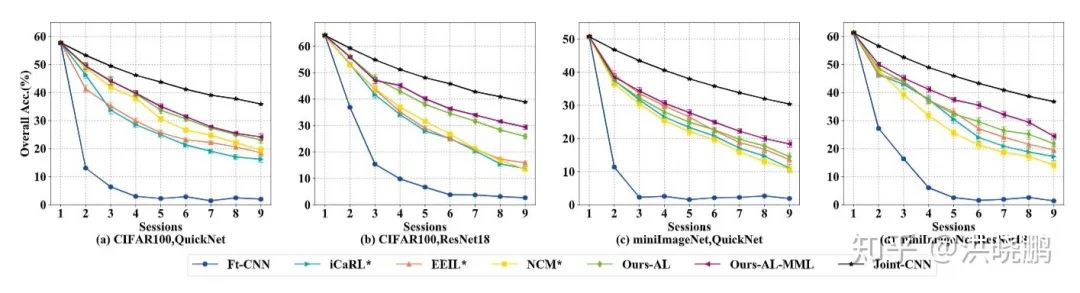

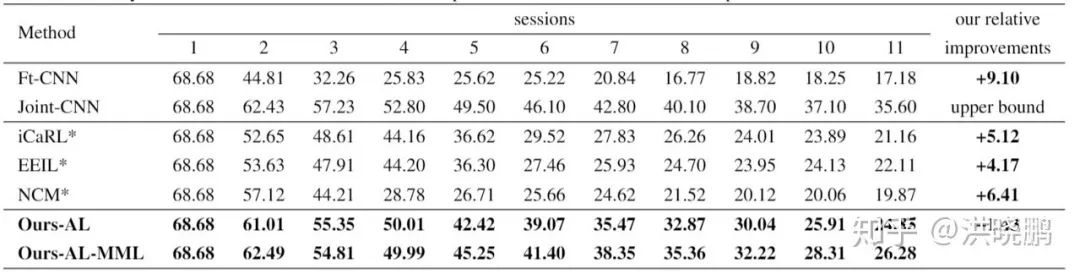

我们在CIFAR100,miniImageNet和 CUB200数据库上进行了全面的测试。部分实验结果如下图表所示,可以看出在实验中所提方法最接近理论性能上界(即将所有任务阶段训练样本混合进行批量学习),这充分证明了在小样本增量学习环境下所提方法的性能优势。另外,我们还进行不同损失函数项的对比实验,对NG网络节点和随机取样本方式进行了对比,评估了训练样本数目影响。

小结一下,本文的贡献主要在于:1. 意识到了小样本深度类增量学习的重要性,并提供了相应的实验设置以推动小样本深度类增量学习的发展;2. 提出了一个受脑认知科学启发的基于神经气体网络的小样本类增量学习框架TOPIC。3. 我们通过全面的实验结果表明,在CIFAR100,miniImageNet和CUB200数据集上,所提出的TOPIC方法明显优于其他最新的类增量学习方法。

更多的细节请移步论文:

https://arxiv.org/abs/2004.10956

我会稍后抽空进行补充介绍。若对文中方法有问题或者感兴趣,欢迎致信 洪晓鹏老师 hongxiaopeng@mail.xjtu.edu.cn 或 陶小语同学txy666793@stu.xjtu.edu.cn

引用信息

Xiaoyu Tao, Xiaopeng Hong, Xinyuan Chang, Songlin Dong, Xing Wei and Yihong Gong. “Few-Shot Class-Incremental Learning.”Proceedings of the IEEE International Conference on Computer Vision and Pattern Recognition, CVPR, 2020.

BibTex:

@inproceedings{tao2020fscil, title={Few-Shot Class-Incremental Learning}, author={Tao, Xiaoyu and Hong, Xiaopeng and Chang, Xinyuan and Dong, Songlin and Wei, Xing and Gong, Yihong}, booktitle={Proceedings of the IEEE International Conference on Computer Vision and Pattern Recognition}, year={2020} }

主要参考文献

[1] Martinetz Thomas and Schulten Klaus. A ”neural-gas” network learns topologies. Artificial Neural Networks, 1991.

[2] Francisco M Castro, Manuel J Marın-Jimenez, Nicolas Guil, Cordelia Schmid, and Karteek Alahari. End-to-end incremental learning. In Proceedings of the European Conference on Computer Vision (ECCV), pages 233–248, 2018.

[3] Saihui Hou, Xinyu Pan, Chen Change Loy, Zilei Wang, and Dahua Lin. Learning a unified classifier incrementally via rebalancing. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 831–839, 2019.

[4] Sylvestre-Alvise Rebuffi, Alexander Kolesnikov, Georg Sperl, and Christoph H Lampert. icarl: Incremental classifier and representation learning. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pages 2001–2010, 2017

论文下载

在CVer公众号后台回复:TOPIC,即可下载本论文

重磅!CVer-论文写作与投稿 交流群已成立

扫码添加CVer助手,可申请加入CVer-论文写作与投稿 微信交流群,目前已满1400+人,旨在交流顶会(CVPR/ICCV/ECCV/ICML/ICLR/AAAI等)、顶刊(IJCV/TPAMI/TIP等)、SCI、EI等写作与投稿事宜。

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch和TensorFlow等群。

一定要备注:研究方向+地点+学校/公司+昵称(如论文写作+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加微信群

▲长按关注CVer公众号

请给CVer一个在看!