论文题目

Model Cards for Model Reporting

论文摘要

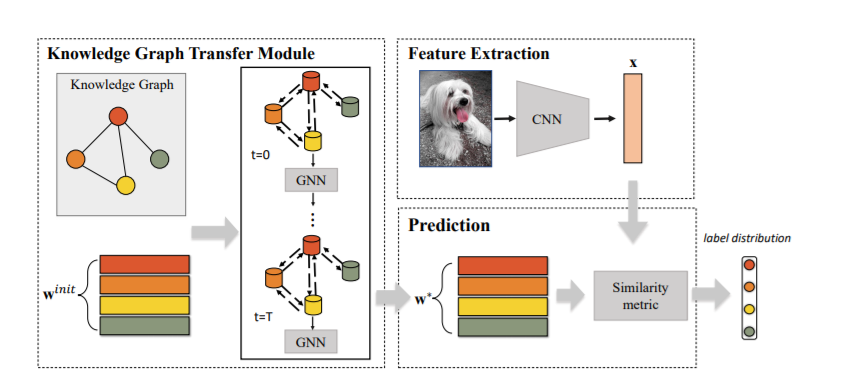

在给定一些具有足够训练样本的基本类别上,少镜头学习的目的是从很少的样本中学习新的类别。这项任务的主要挑战是新的类别容易受到颜色、纹理、物体形状或背景背景(即特异性)的支配,这对于给定的少数训练样本是不同的,但对于相应的类别则不常见。幸运的是,我们发现基于范畴可以帮助学习新概念,从而避免新概念被特定性所支配。此外,结合不同类别之间的语义关联,可以有效地规范这种信息传递。在这项工作中,我们以结构化知识图的形式来表示语义关联,并将此图集成到深度神经网络中,利用一种新的知识图转移网络(KGTN)来促进少量镜头的学习。具体地说,通过使用对应类别的分类器权重初始化每个节点,学习传播机制以自适应地通过图来探索节点间的相互作用,并将基本类别的分类器信息传递给新类别的分类器信息。在ImageNet数据集上进行的大量实验表明,与当前领先的竞争对手相比,性能有了显著提高。此外,我们还构建了一个涵盖更大尺度类别(即6000个类别)的ImageNet-6K数据集,在该数据集上的实验进一步证明了我们提出的模型的有效性。

论文作者 陈日泉,陈天水,许晓璐,吴鹤峰,李冠斌,梁林,中山大学达克马特人工智能研究所。

成为VIP会员查看完整内容

相关内容

知识图谱(Knowledge Graph),在图书情报界称为知识域可视化或知识领域映射地图,是显示知识发展进程与结构关系的一系列各种不同的图形,用可视化技术描述知识资源及其载体,挖掘、分析、构建、绘制和显示知识及它们之间的相互联系。

知识图谱是通过将应用数学、图形学、信息可视化技术、信息科学等学科的理论与方法与计量学引文分析、共现分析等方法结合,并利用可视化的图谱形象地展示学科的核心结构、发展历史、前沿领域以及整体知识架构达到多学科融合目的的现代理论。它能为学科研究提供切实的、有价值的参考。

专知会员服务

66+阅读 · 2020年4月17日

专知会员服务

29+阅读 · 2020年4月17日

专知会员服务

60+阅读 · 2019年11月25日

专知会员服务

26+阅读 · 2019年11月23日

Arxiv

19+阅读 · 2019年11月20日

Arxiv

21+阅读 · 2018年12月25日