对比学习也会维度崩溃?LeCun和田渊栋团队新作,DirectCLR帮你解决各种崩溃!

新智元报道

新智元报道

来源:arXiv

编辑:LRS

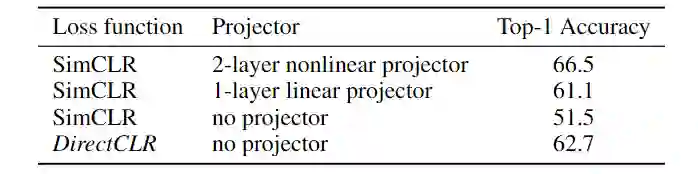

【新智元导读】自监督学习的一个弊端在于没有正负样例的修正,非常容易把所有输入映射到同一向量,从而发生崩溃问题。最近LeCun和田渊栋合作发布DirectCLR,能够极大缓解崩溃问题,在ImageNet的精度超越SimCLR 近10%!

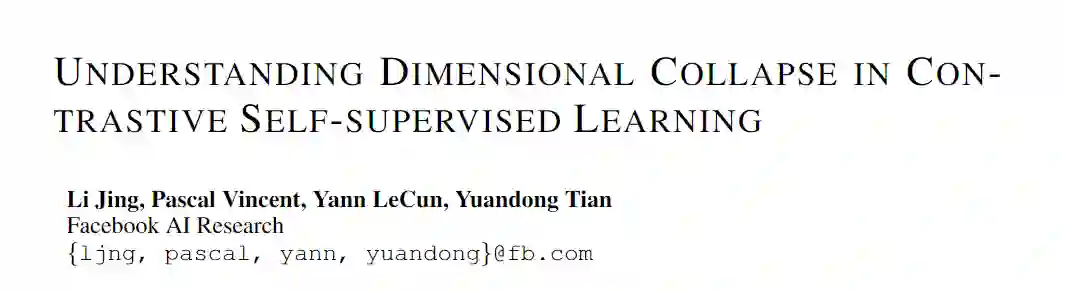

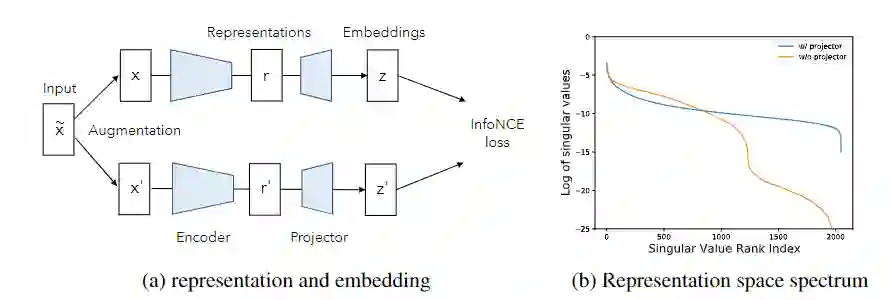

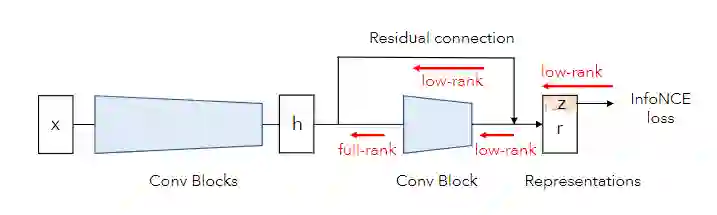

梯度将会驱动projector权重矩阵与编码器主干的最后一层对齐,因此projector 权重矩阵只需要是对角的(diagonal)即可。

projector 仅对表示的子空间应用梯度,因此权重矩阵只需是一个低秩矩阵。

固定的低秩projector:这时DirectCLR退化为一个带有固定线性、对角矩阵projector的SimCLR。实验结果观察到,当使用固定的低秩矩阵作为projector 时,它在ImageNet上的性能类似,从而达到62.3%的线性probe 精度。该低秩矩阵的奇异值设置为d0数为1,其余为0。该矩阵对应的奇异向量都是随机生成的。因此,它们唯一的区别是,这个固定的projector 有一个额外的固定正交矩阵。这表明表示空间(或相当于前一层)在训练期间已进化为与该正交矩阵对齐。

可训练的对角线projector:研究人员训练了一个SimCLR模型,该模型带有一个可训练的projector ,但仅限于对角线的数值。该模型在ImageNet上实现了60.2%的线性probe 精度,与带有1层线性投影仪的SimCLR相当。这也可以通过projector 与主干中的前一层对齐的对齐现象来解释。但研究人员怀疑初始化问题是该模型比具有1层线性可训练投影仪的SimCLR稍差的原因:随机矩阵的奇异值不同于均匀分布。

在子向量z上的线性probe:对于DirectCLR,研究人员仅在子向量z上执行线性probe,并在ImageNet上获得47.9%的精度。这表明即使r 没有看到直接来自损失函数的梯度,但它其余部分仍然包含有用的信息。

参考资料:

https://arxiv.org/abs/2110.09348?

登录查看更多

相关内容

Arxiv

1+阅读 · 2022年4月19日