团队新作 | AAAI2021自动化所入选论文速览(一)

01

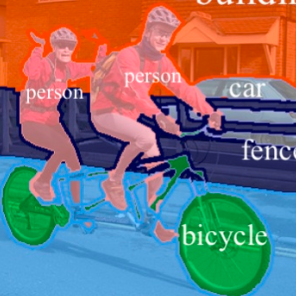

基于组间语义挖掘的弱监督语义分割

Group-Wise Semantic Mining for Weakly Supervised Semantic Segmentation

近年来,由于深度学习需要大量标注数据进行训练的特性,如何获取足量的标注数据来进行深度模型的训练已经成为了制约深度模型发展的关键瓶颈之一。在一些结构化预测的任务中,例如需要逐像素点的标注的语义分割任务中,这一问题更加严重。

本工作探讨弱监督的语义分割方法,即致力于解决从图像级的训练标注得到像素级的模型预测的问题。我们创新地利用对图像分组并显式建立组内图像间的依赖关系的方法处理该弱监督语义分割问题。具体地,将图像视为节点,并利用互注意机制表征图像间的关系,我们利用一个图网络模型来建立和挖掘这种图像之间的语义关系。为了避免模型只响应一些简单的共性语义,我们进一步提出了应用于图模型的 dropout 机制,设法使其通过互注意机制关联出互补的响应区域,从而得到总体更加准确和完整的目标响应。整个网络可以端到端地完成训练,并在 Pascal VOC 2012 和 COCO 数据集上取得了当前最好的性能。

Xueyi Li, Tianfei Zhou, Jianwu Li, Yi Zhou, Zhaoxiang Zhang:Group-Wise Semantic Mining for Weakly Supervised Semantic Segmentation. The Thirty-Fifth AAAI Conference on Artificial Intelligence (AAAI) 2021

02

基于动态渐进式稀疏正则的深度卷积神经网络压缩

DPFPS: Dynamic and Progressive Filter Pruning for Compressing Convolutional Neural Networks from Scratch

结构化剪枝方法得到的压缩模型不需要特定算法库或硬件平台的支持,可以直接在现有深度学习框架上运行,很容易部署到实际任务当中。然而,现有的剪枝方法由于仅使用稀疏和剪枝无法获得令人满意的性能,大多需要繁琐的过程,带来了额外的超参数和训练轮次。此外,部分工作没有考虑不同层间剪枝率的差异。

针对上述问题,视频内容安全团队提出了一种基于动态渐进式稀疏正则的深度卷积神经网络压缩方法。该方法从头开始直接训练一个满足预设剪枝率的结构化稀疏网络。在训练过程中,不同层的稀疏分配率被动态地更新,同时使用基于泰勒级数的通道敏感性准则确定预期稀疏参数。进一步地,通过对预期稀疏参数施加渐进式变化的组稀疏正则,结构化稀疏网络被逐渐学习出来。提出来的方法利用基于动态更新的迭代软阈值算法(ISTA)解决了基于剪枝率的优化求解问题。在训练结束后,直接移除冗余参数,可以获得满足预设剪枝率的压缩模型,不需要微调。实验结果表明,提出来的方法在大/小数据集均取得了可竞争的结果。具体来说,在模型压缩和加速方面,我们的方法获得了有意义的改善,甚至超过了一些多阶段剪枝方法。同时,在检测任务上也有很好的泛化性能。

a) 提出的模型压缩流程图

b) 动态渐进式稀疏示意图

图1. 基于动态渐进式稀疏正则的深度卷积神经网络压缩方法框架图

Xiaofeng Ruan, Yufan Liu, Bing Li, Chunfeng Yuan, Weiming Hu : DPFPS: Dynamic and Progressive Filter Pruning for Compressing Convolutional Neural Networks from Scratch. The Thirty-Fifth AAAI Conference on Artificial Intelligence (AAAI) 2021

03

对偶对抗图神经网络的多标签跨模态检索

Dual Adversarial Graph Neural Networks for Multi‐Label Cross‐Modal Retrieval

随着多模态数据规模的扩大,跨模态检索已成为一个活跃的研究领域。当前,大多数跨模态检索方法使用将多模态数据映射到统一的空间,在这个空间上,可以对不同的模态数据进行直接度量其语义相似性。但是,这些方法通常具有以下局限性:

1)他们试图通过设计统一表示空间中的损失来弥合模态间的差距,但这可能不足以消除统一空间中不同模态的潜在异质性。

2)他们常常将类别标签单独使用,忽略了标签之间的关系,而标签的关系对于在多模态数据之间构建语义关联非常重要。

我们提出了一种新颖的对偶对抗图神经网络(Dual Adversarial Graph Neural Networks, DAGNN),该网络由对偶生成式对抗网络和多跳图神经网络组成,可以在跨模态检索任务中学习具有模态不变和判别能力的特征表示。首先,我们构造了对偶生成对抗网络,将多模态数据投影到一个统一的表示空间中。其次,我们利用多跳图神经网络,提出了一种层聚合机制来利用多跳传播信息,捕获标签相关性依存关系和学习相互依赖的分类器。在两个多标签跨模态检索基准数据集NUS-WIDE和MIRFlickr上证明了其有效性。

对偶对抗图神经网络框架示意图

Shengsheng Qian, Dizhan Xue, Huaiwen Zhang, Quan Fang, Changsheng Xu : Dual Adversarial Graph Neural Networks for Multi-Label Cross-Modal Retrieval. The Thirty-Fifth AAAI Conference on Artificial Intelligence (AAAI) 2021

04

基于近端匹配网络的代理图匹配

Proxy Graph Matching with Proximal Matching Networks

图匹配是计算机视觉和模式识别的基本工具。传统上,人们把开发一个高效的匹配算法和寻找一个好的特征抽取器看作两个分离的问题。现有的算法采用不同的松弛策略,例如谱方法,概率方法,或直接处理整数优化问题。传统方法一般用到的都是手工特征,不具备可学习特性。

图1 近端图匹配方法

在这项工作中,我们介绍了一种基于近端算子的算法,称为可微分近端图匹配(DPGM)。具体地说,我们将图匹配的二次分配问题松弛并分解为一系列凸优化问题。整个算法可以看作是一个从图关联矩阵到节点对应关系预测的可微分映射。因此,该方法能够集成到一个端到端的深度学习框架中,以便学习到一个更好的、专门用于匹配任务的深层特征表示。此外,我们提供了一个理论保证,保证了所提出的方法在合理的迭代次数内收敛到一个稳定解。我们的算法在和深度模型端到端结合后,拥有很好的泛化能力,可以在合成图上训练后直接应用到实际数据上。数值实验表明,我们的框架在不同数据集的测试中均能达到很好的效果。

Haoru Tan, Chuang Wang, Sitong Wu, TieQiang Wang, XuYao Zhang, ChengLin Liu : Proxy Graph Matching with Proximal Matching Networks. The Thirty-Fifth AAAI Conference on Artificial Intelligence (AAAI) 2021

05

图到图:面向精确可解释的联机手写数学公式识别

Graph-to-Graph: Towards Accurate and Interpretable Online Handwritten Mathematical Expression Recognition

近年来的深度学习方法都将手写数学公式识别视作图像到LaTeX串生成的问题来处理。这种方法使用编码器-解码器模型将脱机图片或者联机轨迹端到端的转换为目标LaTeX表达式。但是由于数学公式有着复杂度二维结构:(i)这种方法没有显式利用公式中存在的层次关系;(ii)也不能显式的将公式中的数学符号检测或分割出来。

图1 图到图方法模型结构

为了解决端到端识别公式的同时显式解析符号的位置和层次关系的难题,我们提出了图到图学习方法来探索手写数学公式的层次结构建模和解析。具体的,我们将输入联机公式表示成笔画关系图,直接从数据中自动学习目标符号标签图的生成。我们设计了一种改进的图注意网络(Graph Attention Network, GAT)来自适应的建模源图笔画间的空间以及时间关系,再使用对不同层次关系独立传递信息的图卷积网络(Graph Convolutional Network, GCN)来学习目标符号标签图表示以及目标图与输入笔画关系图的对应关系。此外,我们还提出了一种新颖的子图注意机制,以对齐输出符号结点与对应输入笔画部件构成的子图。我们所提出的方法显著地提升了原有方法在多个公开数据集的精度,并且显式分割出了联机数学公式中的数学符号。

JinWen Wu, Fei Yin, Yanming Zhang, XuYao Zhang, ChengLin Liu: Graph-to-Graph: Towards Accurate and Interpretable Online Handwritten Mathematical Expression Recognition. The Thirty-Fifth AAAI Conference on Artificial Intelligence (AAAI) 2021

06

基于一致可分离特征表示的图像语义分割

Consistent-Separable Feature Representation for Semantic Segmentation

对于当前大部分语义分割模型,Softmax与交叉熵损失是最常用的监督方式之一。Softmax损失通常擅长优化类间的特征可分离性,并不擅长缩小类内的特征差异,这对于语义分割可能不是最优的选择。

本文提出一种一致可分离的特征表示网络,用来建模具有类内一致性且具有类间可分离性的特征。具体来说,我们提出一个一致性可分离特征学习模块,该模块利用标注信息来获得每个类别的特征语义中心,并针对每个类别预测一个松弛因子。通过语义中心和松弛因子,可以获得特征图中每个点到对应语义中心的距离。我们进一步提出类感知的一致性损失来优化距离,使得具有相同类别标签的特征距离更近,不同类别标签的特征距离较远,以此来获得一致可分离特征。除此之外,我们设计了一个特征自适应聚合模块用来融合一致可分离特征和来自主干网络的特征,以获得更好的语义分割结果。实验表明,将我们提出的方法应用于当前的一些语义分割基准模型,可以带来明显的性能提升。同时,我们的方法在多个语义分割的数据集上都达到SOTA的性能。Cityscapes测试集 82.6% mIoU,ADE20K验证集46.65% mIoU,COCO Stuff 验证集41.3%mIoU以及PASCAL Context 测试集55.9% mIoU。

Xingjian He, Jing Liu, Jun Fu, Xinxin Zhu, Jinqiao Wang, Hanqing Lu: Graph-to-Graph: Consistent-‐Separable Feature Representation for Semantic Segmentation. The Thirty-Fifth AAAI Conference on Artificial Intelligence (AAAI) 2021

07

基于多通道相关性的任意视频风格化算法

Arbitrary Video Style Transfer via Multi-Channel Correlation

本文由自动化所多媒体计算团队和吉林大学、快手Y-Tech共同完成

给定内容图像和引导的风格图像,风格化方法可以将以风格图像的色调和生动的笔画模式呈现到内容图像中,同时维护内容结构信息。虽然目前的图像风格化算法可以生成良好的视觉效果,但视频风格化仍是一项具有挑战性的任务,它不仅需要每帧产生良好的风格化效果,而且还要考虑视频相邻帧之间的连续性。

本研究提出了一种基于多通道相关性的任意连续视频风格化网络(MCCNet),如图1所示。网络计算内容和风格表示的多通道相关性,按照此相关性,重排风格特征使其适应内容结构。通过进一步合并重排的风格和内容表示,我们生成的特征可以被解码为具有清晰内容结构和生动的风格模式的风格化结果。MCCNet将生成的特征与内容特征对齐,因此相邻帧的微小变化不会导致风格化视频的闪烁。此外,连续帧间光照的变化会影响视频风格传输的稳定性。因此,我们在内容图像中加入随机高斯噪声来模拟光照变化,并提出光照损失来保证模型的稳定性和避免闪烁。实验表明,如图2所示,我们的方法可生成稳定的视频风格化结果。

图1 MCCNet网络框架

图2 本工作方法生成的图像与视频风格化结果

(点击图片阅读详细解读)

代码:https://github.com/diyiiyiii/MCCNet

Yingying Deng, Fan Tang, Weiming Dong, Haibin Huang, Chongyang Ma, Changsheng Xu: Arbitrary Video Style Transfer via Multi-Channel Correlation. The Thirty-Fifth AAAI Conference on Artificial Intelligence (AAAI) 2021

08

学习用于旋转目标检测的调制损失

Learning Modulated Loss for Rotated Object Detection

本文由自动化所多维数据分析实验室和上海交通大学合作完成。

随着目标检测在自然文本,卫星图,车牌,人脸等领域的应用,旋转目标检测成为了新的研究热点。但是现有的大多数旋转检测方法都是从水平目标检测直接修改得来,忽略了旋转目标检测本身的一些特性,从而导致了在一些特定的位置会发生损失跃变。

本文首先分析了导致这种损失不连续性的原因是:旋转框的定义方式以及损失函数之间存在某些矛盾。为了进一步分析本质原因,我们进一步提出这种不连续性在五点定义法和八点定义法中都会发生。针对于这两种情况,我们分别分析了不连续的损失会导致边框回归更加的不稳定以及降低对于某些边界位置目标的定位精度。

为了解决上述的问题,我们提出了调制的旋转目标损失,通过对于常规的损失函数增加了修正项以避免在边界位置的信息混淆。

基于MRloss我们还开源了第一份用于基于八参数回归的旋转目标检测代码:

https://github.com/Mrqianduoduo/RSDet-8P-4R

Wen Qian, Xue Yang, Silong Peng, Junchi Yan, Yue Guo : Learning Modulated Loss for Rotated Object Detection. The Thirty-Fifth AAAI Conference on Artificial Intelligence (AAAI) 2021