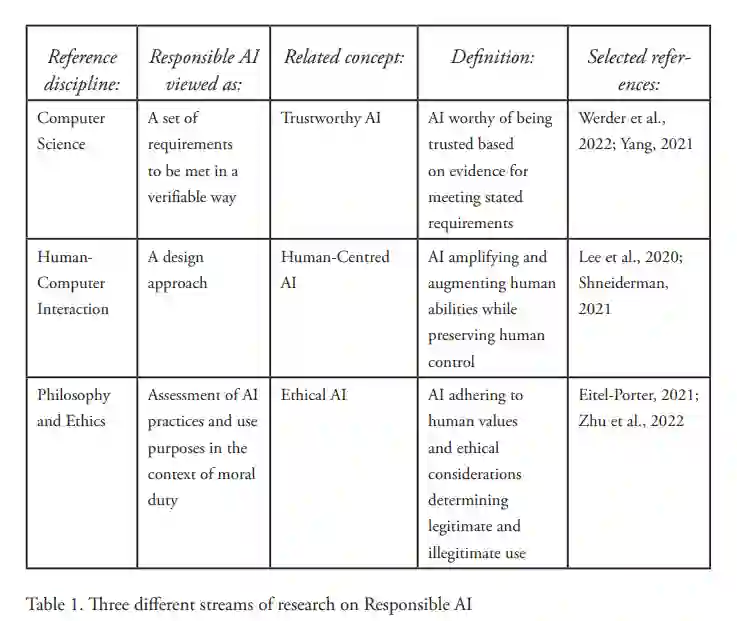

对人工智能(AI)负责,利用其力量,同时将个人和社会的风险降到最低,是我们这个时代的最大挑战之一。关于负责任人工智能的讨论正在学术界、政策制定和企业沟通中蓬勃发展。在这篇社论中,我们展示了不同的文献链是如何交织在一起的,但也有分歧,并提出了负责任人工智能的全面定义,即以人为本的方式开发、使用和管理人工智能,以确保人工智能值得信任并遵守人类的基本价值观。这个定义澄清了负责任人工智能并不是一类具有特殊属性或可以承担责任的人工智能人工制品,人类最终要对人工智能负责,对其后果负责,对控制人工智能的发展和使用负责。我们解释了本期特刊中的四篇论文是如何体现不同的负责任的人工智能实践的,并将他们的发现综合为一个综合框架,包括商业模式、服务/产品、设计过程和数据。我们建议IS研究可以为负责任的人工智能提供社会相关的知识,提供关于如何平衡工具性和人文性人工智能结果的见解,并为未来关于负责任的人工智能的IS研究提出主题。

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2023年3月8日