万字长文详解:人工智能系统可解释性要求的法律规制

摘要:当前,因“算法黑箱”而导致的人工智能系统的不透明与不可解释问题是人工智能信任与问责的一大困扰。在这样的背景下,国内外立法开始从权利、义务等不同角度对人工智能的可解释性进行规制,提出了算法解释权、算法说明义务等规则。但可解释性要求的有效落实仍面临着技术可行性、经济成本、法律规则和价值冲突、社会需求差异等多方面挑战。面向未来,人工智能可解释性要求的实现,需要法律、技术、市场、规范等多种力量共同发挥作用,侧重通过“算法说明书”、算法相关信息披露等方式增进算法透明、促进用户理解。

问题的引入

人工智能

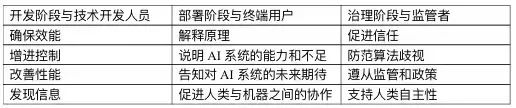

可解释性要求及其立法现状

人工智能

可解释性规制面临的问题分析

人工智能

可解释性规制的未来进路

结语

点这里👇关注我,记得标星~

登录查看更多

相关内容

Arxiv

11+阅读 · 2021年9月3日