【导读】计算语言学协会(the Association for Computational Linguistics, ACL)年度会议作为顶级的国际会议,在计算语言学和自然语言处理领域一直备受关注。其接收的论文覆盖了语义分析、文本挖掘、信息抽取、问答系统、机器翻译、情感分析和意见挖掘等众多自然语言处理领域的研究方向。今年,第58届计算语言学协会(the Association for Computational Linguistics, ACL)年度会议将于2020年7月5日至10日在美国华盛顿西雅图举行。受COVID-19疫情影响,ACL 2020将全部改为线上举行。本次ACL大会共提交了3429篇论文,共有571篇长论文、以及208篇短论文入选。不久之前,专知小编为大家整理了大会的图神经网络(GNN)相关论文,这期小编继续为大家奉上ACL 2020图神经网络(GNN)相关论文-Part 2供参考——多文档摘要、多粒度机器阅读理解、帖子争议检测、GAE。

ACL2020GNN_Part1、WWW2020GNN_Part1、AAAI2020GNN、ACMMM2019GNN、CIKM2019GNN、ICLR2020GNN

1. Leveraging Graph to Improve Abstractive Multi-Document Summarization

作者:Wei Li, Xinyan Xiao, Jiachen Liu, Hua Wu, Haifeng Wang, Junping Du

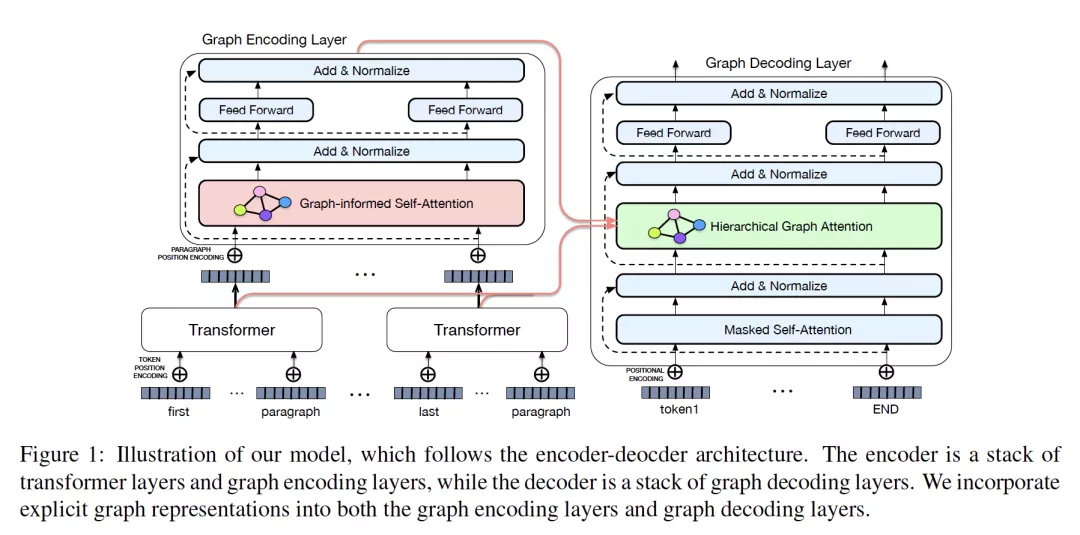

摘要:捕捉文本单元之间关系图对于从多个文档中检测显著信息和生成整体连贯的摘要有很大好处。本文提出了一种神经抽取多文档摘要(MDS)模型,该模型可以利用文档的常见图表示,如相似度图和话语图(discourse graph),来更有效地处理多个输入文档并生成摘要。我们的模型使用图对文档进行编码,以捕获跨文档关系,这对于总结长文档至关重要。我们的模型还可以利用图来指导摘要的生成过程,这有利于生成连贯而简洁的摘要。此外,预训练的语言模型可以很容易地与我们的模型相结合,进一步提高了摘要的性能。在WikiSum和MultiNews数据集上的实验结果表明,所提出的体系结构在几个强大的基线上带来了实质性的改进。

网址: https://arxiv.org/abs/2005.10043

2. Document Modeling with Graph Attention Networks for Multi-grained Machine Reading Comprehension

作者:Bo Zheng, Haoyang Wen, Yaobo Liang, Nan Duan, Wanxiang Che, Daxin Jiang, Ming Zhou, Ting Liu

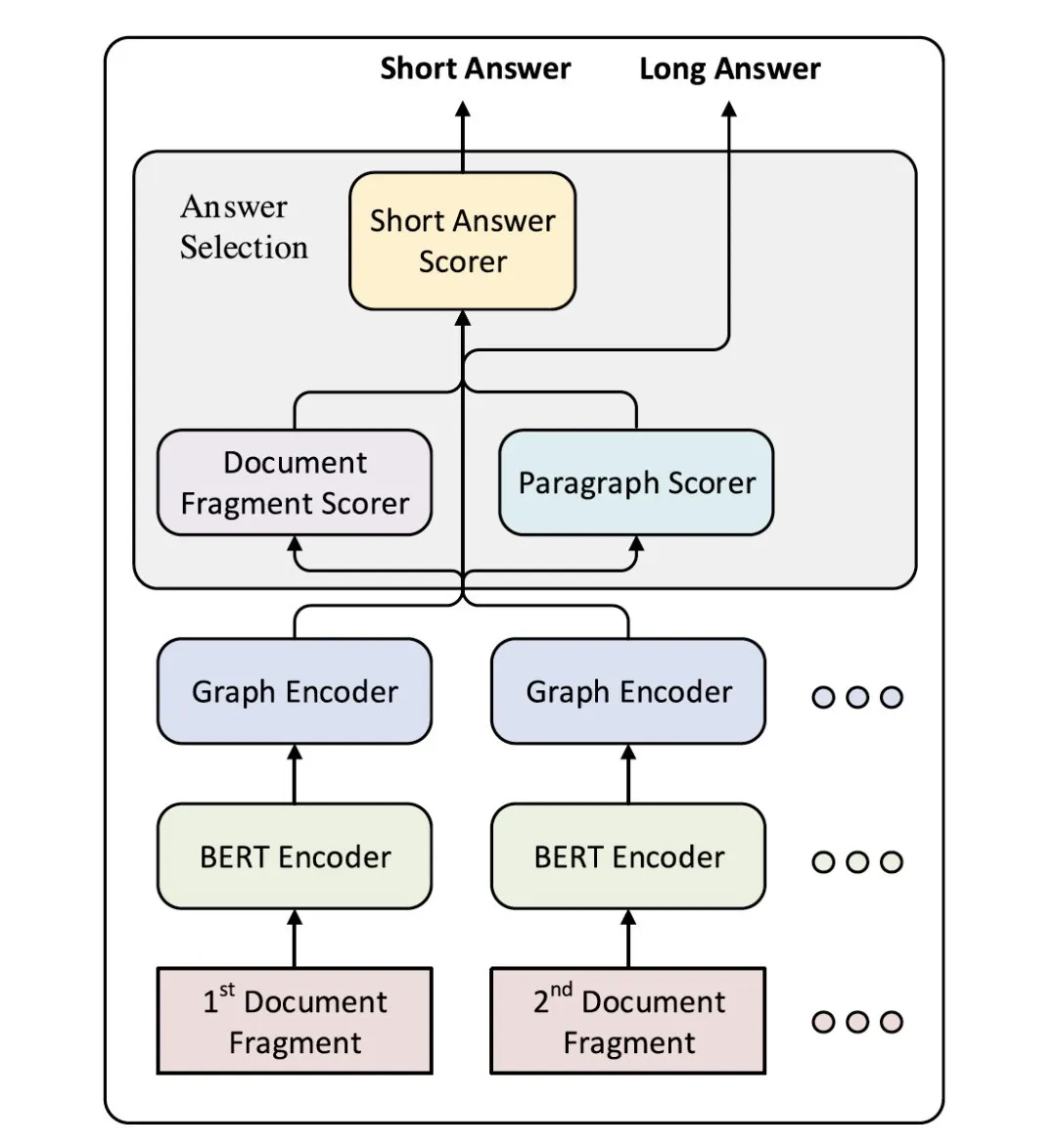

摘要:“自然问题”是一种具有挑战性的新的机器阅读理解基准,其中包含两个答案:长答案(通常是一个段落)和短答案(长答案中的一个或多个实体)。尽管此基准测试的现有方法很有效,但它们在训练期间单独处理这两个子任务,忽略了它们间的依赖关系。为了解决这个问题,我们提出了一种新颖的多粒度机器阅读理解框架,该框架专注于对文档的分层性质进行建模,这些文档具有不同的粒度级别:文档、段落、句子和词。我们利用图注意力网络来获得不同层次的表示,以便它们可以同时学习。长答案和短答案可以分别从段落级表示和词级表示中提取。通过这种方式,我们可以对两个粒度的答案之间的依赖关系进行建模,以便为彼此提供证据。我们联合训练这两个子任务,实验表明,我们的方法在长答案和短答案标准上都明显优于以前的系统。

网址: https://arxiv.org/abs/2005.05806

代码链接:

https://github.com/DancingSoul/NQ_BERT-DM

3. Integrating Semantic and Structural Information with Graph Convolutional Network for Controversy Detection

作者:Lei Zhong, Juan Cao, Qiang Sheng, Junbo Guo, Ziang Wang

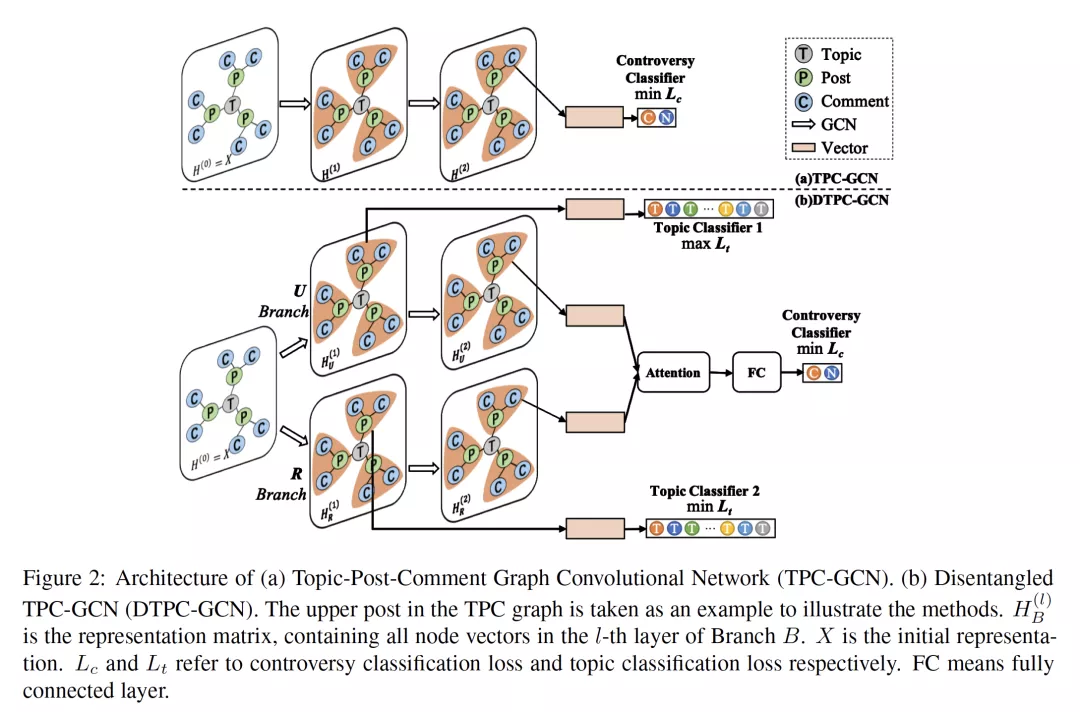

摘要:识别社交媒体上有争议的帖子是挖掘公众情绪、评估事件影响、缓解两极分化观点的基础任务。然而,现有的方法不能1)有效地融合来自相关帖子内容的语义信息;2)保留回复关系建模的结构信息;3)正确处理与训练集中主题不同的帖子。为了克服前两个局限性,我们提出了主题-帖子-评论图卷积网络(TPC-GCN),它综合了来自主题、帖子和评论的图结构和内容的信息,用于帖子级别的争议检测。对于第三个限制,我们将模型扩展到分离的TPC-GCN(DTPC-GCN),将主题相关和主题无关的特征分离出来,然后进行动态融合。在两个真实数据集上的大量实验表明,我们的模型优于现有的方法。结果和实例分析表明,该模型能够将语义信息和结构信息有机地结合在一起,具有较强的通用性。

网址: https://arxiv.org/abs/2005.07886

4. Knowledge Graph-Augmented Abstractive Summarization with Semantic-Driven Cloze Reward

作者:Luyang Huang, Lingfei Wu, Lu Wang

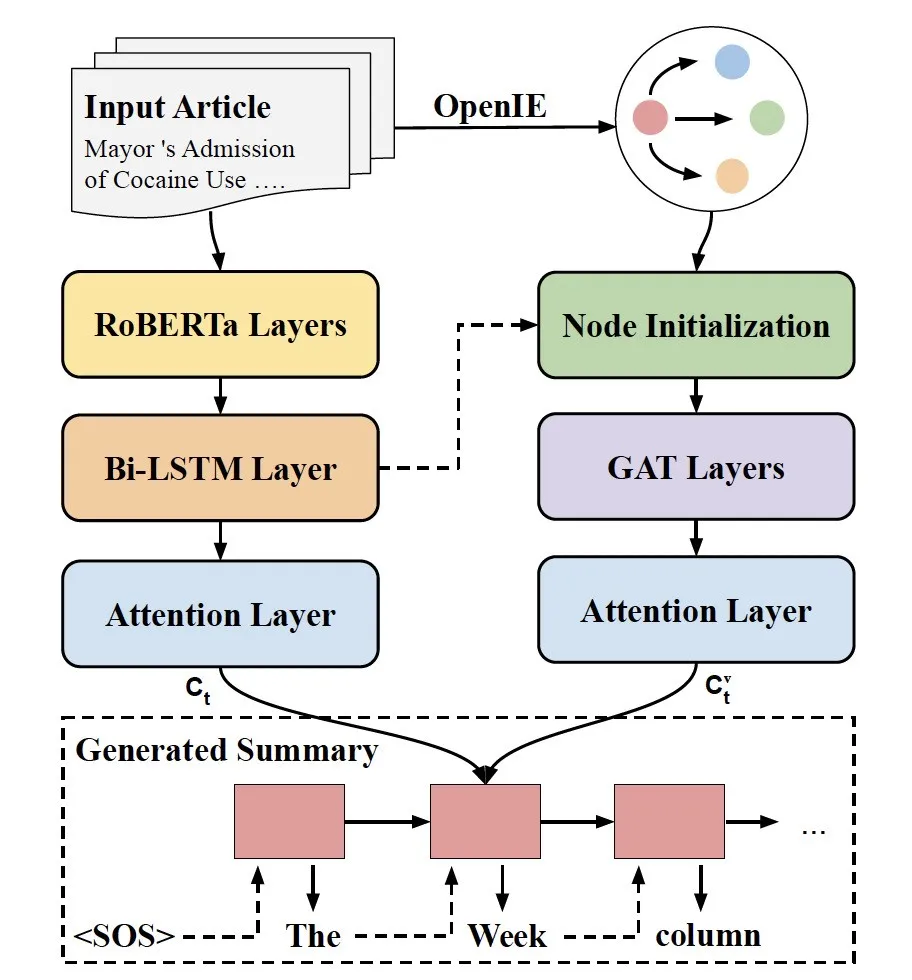

摘要:用于抽取摘要的序列到序列(sequence-to-sequence )模型已经被广泛研究,但是生成的摘要通常受到捏造的内容的影响,并且经常被发现是near-extractive的。我们认为,为了解决这些问题,摘要生成器应通过输入获取语义解释,例如通过结构化表示,以允许生成更多信息的摘要。在本文中,我们提出了一种新的抽取摘要框架--Asgard,它具有图形增强和语义驱动的特点。我们建议使用双重编码器-序列文档编码器和图形结构编码器-来保持实体的全局上下文和局部特征,并且相互补充。我们进一步设计了基于多项选择完形填空测试的奖励,以驱动模型更好地捕捉实体交互。结果表明,我们的模型在纽约时报和CNN/每日邮报的数据集上都比没有知识图作为输入的变体产生了更高的Rouge分数。与从大型预训练的语言模型中优化的系统相比,我们也获得了更好或可比的性能。评委进一步认为我们的模型输出信息更丰富,包含的不实错误更少。

网址: https://arxiv.org/abs/2005.01159

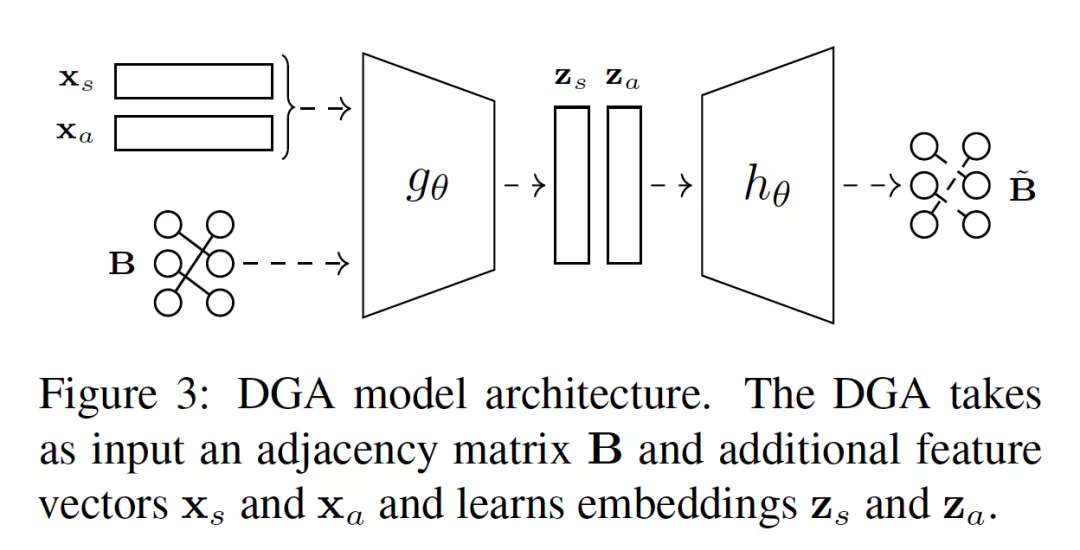

5. A Graph Auto-encoder Model of Derivational Morphology

作者:Valentin Hofmann, Hinrich Schutze, Janet B. Pierrehumberty

摘要:关于派生词的形态良好性(morphological well-formedness, MWF)建模工作在语言学中被认为是一个复杂而困难的问题,并且这方面的研究工作较少。我们提出了一个图自编码器学习嵌入以捕捉派生词中词缀和词干的兼容性信息。自编码器通过将句法和语义信息与来自心理词典的关联信息相结合,很好地模拟了英语中的MWF。

网址: http://www.phon.ox.ac.uk/jpierrehumbert/publications/Hofmann_etal_DGA_ACL2020.pdf