由于长期以来对 "黑盒"模型的担忧,许多临床医生对机器学习仍然保持警惕。"黑盒"是模型的简称,它足够复杂,人类无法直接解释。预测模型缺乏可解释性会破坏对这些模型的信任,特别是在医疗保健领域,因为许多决定都是生死攸关的。最近,可解释机器学习领域的研究激增,旨在解决这些问题。可解释机器学习的前景非常可观,但对于可能在临床决策支持工具或新的研究论文中遇到这些技术的心脏病专家来说,重要的是要对它们的优势和局限性有一个重要的了解。本文回顾了可解释机器学习领域的关键概念和技术,因为它们适用于心脏病学。回顾的关键概念包括可解释性与可解释性以及全局与局部解释。所展示的技术包括排列组合重要性、智能体决策树、局部可解释的模型-诊断性解释和部分依赖图。我们讨论了可解释性技术的几个局限性,重点是解释作为近似的性质如何可能忽略了关于黑盒模型如何工作以及它们为什么做出某些预测的重要信息。最后,我们提出了一条经验法则,即何时使用带有解释的黑盒模型。

尽管大多数食品和药物管理局和加拿大卫生部批准的ML算法都集中在大脑、肺部或乳房,但截至本文撰写时,至少有12种批准的算法应用于心脏病学。 然而,尽管如此,许多临床医生仍然对ML保持警惕,因为他们担心许多ML模型的 "黑盒"性质,这可以追溯到20世纪90年代人工神经网络在医学上的一些早期应用。对黑盒算法的担忧在著名医学期刊的评论中经常被强调,现在许多ML科学家承认这是医学中采用ML的主要障碍之一。

术语 "黑盒"是指那些足够复杂的模型,它们不能被人类直接解释。这与医学研究中经常使用的模型形成对比,如线性和逻辑回归,人类可以参考模型系数来解释模型及其预测。虽然不是所有的ML算法都是不可解释的(后面会有更多的介绍),但大多数产生最先进结果的ML算法(包括深度学习和集合模型)都有这个限制。

预测模型缺乏可解释性会破坏对这些模型的信任,特别是在医疗保健领域,许多决定实际上是生与死的问题。没有一个模型是完美的,所以临床医生对盲目相信一个无法提供任何关于其决定原因的模型的预测感到厌倦是完全合理的。随着经验性证据的积累,这些担忧只会增加,因为ML可以对观察性医疗数据集中发现的现有种族偏见进行编码,从而通过黑盒自动化使系统性种族主义永久化。

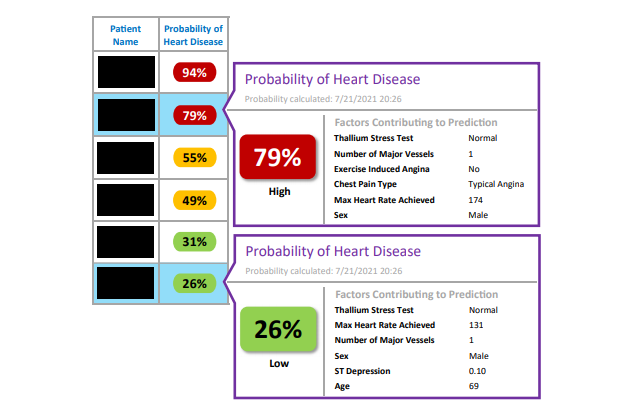

黑盒也限制了模型预测的临床可操作性,这进一步削弱了它们对临床医生的作用。ML在医疗保健中的一个常见应用是用于预测临床恶化的早期预警系统。但如果这种系统只警告临床医生有恶化的风险,而不说明原因,不进一步评估就可能不清楚警报的原因,这在时间敏感的情况下会延误治疗,在假阳性的情况下会浪费临床医生的宝贵时间。

为了应对黑盒模型带来的重大挑战,近年来在可解释ML领域的研究激增。这些研究的重点不是使黑盒模型具有内在的可解释性,而是对模型如何工作以及它为什么做出特定的个别预测做出可理解的解释(关于可解释性与可解释性之间的区别,下文有更多介绍)。这些解释中的许多都集中在确定最能推动模型预测的变量,或将模型的工作原理转化为更接近基于证据的临床推理的透明设计(如决策树)。这两种方法都被证明对提高临床医生对ML模型的信心很重要。可解释ML的承诺是相当大的:有机会从深度学习等技术的最先进的预测能力中获益,而没有黑盒子的缺点。然而,这种承诺也带来了一些重要的限制。

本文回顾了可解释ML领域的关键概念和技术,因为它们适用于心脏病学。我们的目标是为心脏病专家和心血管研究人员提供对可解释ML技术的好处和局限性的重要理解,以便他们在遇到这些技术嵌入临床决策支持工具或新的心脏病学研究结果时,可以成为知情的消费者。