可解释机器学习

·

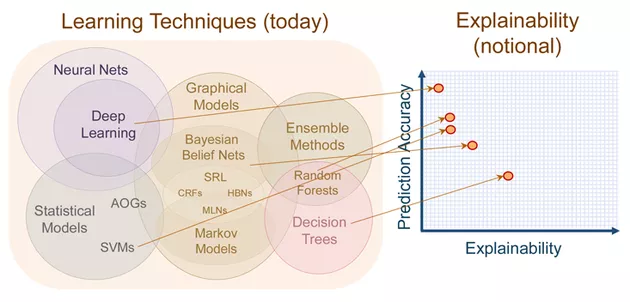

近年来,可解释机器学习(IML) 的相关研究蓬勃发展。尽管这个领域才刚刚起步,但是它在回归建模和基于规则的机器学习方面的相关工作却始于20世纪60年代。最近,arXiv上的一篇论文简要介绍了解释机器学习(IML)领域的历史,给出了最先进的可解释方法的概述,并讨论了遇到的挑战。

当机器学习模型用在产品、决策或者研究过程中的时候,「可解释性」通常是一个决定因素。

可解释机器学习(Interpretable machine learning ,简称 IML)可以用来来发现知识,调试、证明模型及其预测,以及控制和改进模型。

研究人员认为 IML的发展在某些情况下可以认为已经步入了一个新的阶段,但仍然存在一些挑战。

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2020年12月2日